У заказчика более 20 тысяч пользователей корпоративной почты в нескольких регионах. Все эти люди пользуются Exchange-серверами, и чаще всего — разными Outlook’ами. Пользователей большой объём базы почти никогда не беспокоит, если не считать поиска: он идёт медленно и выдаёт сотни писем, по сути, без возможности нормальной фильтрации.

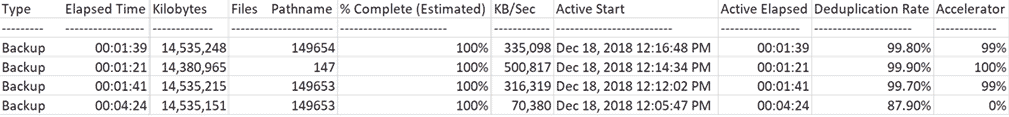

Админов не устраивает, что эта база начинает пухнуть. Добавить ещё 20 ТБ дискового места в сервера не всегда так просто, потому что это будет по факту 40 ТБ: раздел по 20 ТБ должен выдаваться каждой ноде DAG, и их у заказчика две. И ещё бэкап. Полный бэкап должен делаться за ночь раз в неделю в воскресенье, и, если он выходит за окно, то это проблема.

Плюс сама по себе база Exchange —

это поле костылей довольно медленная и не поддерживает дедупликацию, только обычное сжатие внутри письма. То есть когда бухгалтерия опять отправит смешную пятимегабайтную гифку на всю компанию, она ляжет в базу ровно столько раз, сколько было получателей.

Мы предложили перенести старые письма в архивную базу с дедупликацией, чтобы на бою осталось только 10–20 % самых «горячих» писем. При этом на месте писем в Outlook показываются их заголовки и первые N символов письма, а архивная база имеет интеграцию с клиентом и подтягивает письмо за пару секунд при обращении к нему. То есть пользователь видит свои старые письма и почти так же удобно работает с ними.

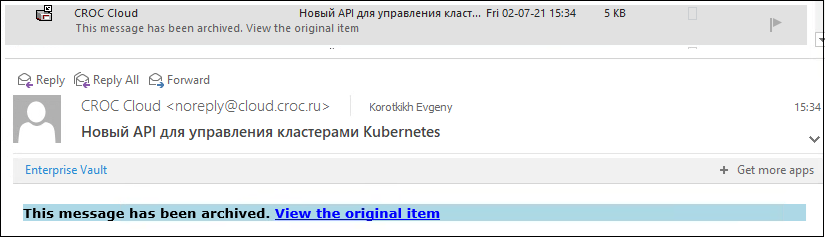

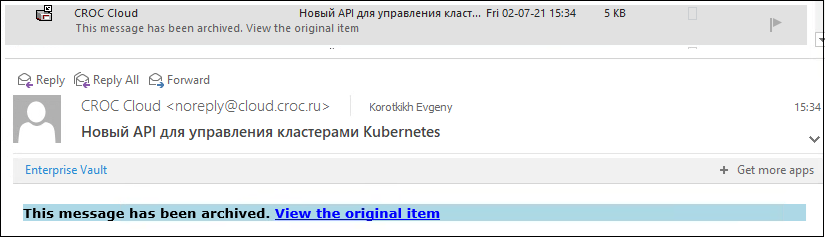

Вот так выглядит заглушка.

Вот так выглядит заглушка.

А ещё это очень упростило поиск (база с индексом) и подарило радость отделу ИБ.

Ниже я расскажу про оптимизацию почтовых баз.