Моральная сторона разработки роботизированного транспорта очень сложна. Разработчики твердо верят, что испытания нужно проводить на публичных дорогах, хотя они знают, что это подвергнет небольшому риску ни о чем не подозревающих участников движения. Автомобили, выпущенные после тестов, безусловно, будут попадать в аварии (в том числе с летальным исходом), и такое положение дел представляет собой пугающую и обескураживающую перспективу. В то же время успех сулит нам колоссальные улучшения дорожной безопасности и спасение жизней огромного числа людей, которые погибли бы, если бы не существовала возможность заменить более опасное человеческое вождение на поездку на беспилотном автомобиле.

Мы рассмотрим такие аспекты как:

- Понимание различных подходов к моральным рассуждениям людей в различных (или одинаковых) ситуациях

- То, как закон, общество и страховка относятся к рискованному вождению, авариям и несчастным случаям.

- Риски и потери при вождении (или обучении вождению), которые мы, похоже, охотно принимаем для получения небольших преимуществ.

- Как меняется наш взгляд на то, что «цель оправдывает средства» в зависимости от того, о чем идет речь: преднамеренные злодеяния или небольшие осознанные риски.

- Большие преимущества, которые мы получим, когда небольшой автопарк автономных автомобилей научится водить более безопасно, после чего их программное обеспечение будет скопировано в миллионы других машин – ситуация, которая невозможна в случае с водителями-людьми.

- Риски и принципы современных подходов к тестированию и разработке автономных автомобилей, и то, как Uber их нарушил.

- Огромная выгода, если мы сможем найти правильный подход.

Тот факт, что недавно в Темпе, штат Аризона был раскрыт случай аварии со смертельным исходом с участием автомобиля компании Uber только увеличивает необходимость понимания данной проблемы. Было написано много текстов и высказано множество мнений о том, как необходимо рассуждать о рисках и принципах морали в беспилотных автомобилях. В этой статье я надеюсь представить как чистый взгляд на эту проблему, так и руководство к рассуждению о ней.

Большинство аварий — это одиночные машины, и их можно предотвратить. И все же мы смирились с этим ужасным риском, не задумываясь.

Оказывается, что сочетание уроков, которые нам дает проблема вагонетки (именно с вагонетки, а не беспилотного автомобиля) и измерения действий, приводящих к рискам вместо трагедий, может помочь нам сформировать лучшее понимание и правовой режим для решения сложных вопросов о роботах, которые могут и спасать человеческие жизни, и угрожать им. Мы можем спасти миллионы жизней, если мы будем готовы принять те же риски, что и при обучении подростков перед тем, как они начнут водить (вместо подростков можете представить спешащих доставщиков пиццы). Почти все, кто работает над роботами, хотят, чтобы они спасали жизни, и чтобы они начали это делать как можно скорее, но для этого общественность должна понять и даже принять методики работы в этой сфере. Чтобы сделать это, мы должны понимать как наши моральные инстинкты и нашу внутреннюю математику, так и разницу между риском и трагедией.

Я осознал сложности в понимании этих проблем год назад, когда разговаривал дома за обедом со своим другом. Друг был весьма обеспокоен рисками, которые содержали в себе ранние прототипы. Я спросил его – была бы разумной ситуация, в которой при тестировании погибают 100 человек, но при использовании конечного продукта будут спасены миллионы жизней? Ему казалось очевидным, что это неправильно, и он не одинок в этом мнении.

Человеческая мораль сложна и хитра, и она может работать по-разному в зависимости от ситуации. Немногие из нас кристально чисты в своей принципиальности, и те принципы, которые мы используем в своих субъективных решениях могут отличаться от тех, который используются в коллективных решениях в обществе или в суде. Чтобы понять эту проблему и то, как прийти к лучшему решению, нам необходимо понять то, как люди рассуждают о подобной морали, и, возможно, изменить это мышление для того, чтобы добиться результата, который будет лучше по мнению большинства.

Ответ может заключаться в том, что, хотя мы не согласны с тем, что великие цели могут оправдать аморальные средства, оказывается, что мы готовы охотно признать, что даже скромные выгодные цели могут оправдывать средства с небольшими аморальными рисками.

Типы морали

Грубо говоря, философы выделяют два широких класса моральных систем. Первый требует кодекса правил и принципов, и определяет ошибку как нарушение этих самых правил и принципов вне зависимости от результата. Сложное название таких систем – «деонтологические», но мы будем называть их основанными на правилах. С другой стороны мы имеем системы, основанные на результатах, которые измеряют правильное и неправильное тем, что мы получаем в конечном итоге. Они также известны как консеквенциалистские. Одним конкретным подмножеством таких систем является утилитарная, следующая правилу добиваться наибольшего блага для наибольшего числа людей, либо же наносить наименьший вред наименьшему числу людей.

Иногда мы любим утилитарные моральные системы, особенно как общество в целом. Однако как личности, мы склонны не доверять им, поскольку они связаны с опасной идеей о том, что «цель оправдывает средства», а эта идея приводила к большому количеству моральных ужасов на протяжении всей истории. Большинство из нас не принадлежат строго к одной из школ. Как отмечалось ранее, наш подход меняется в зависимости от того, считаем мы себя отдельной личностью или обществом в целом, и мы меняем наш подход к рассуждениями исходя из наших личных взглядов сильнее, чем нам хотелось бы признать.

Чистый приверженец утилитарного подхода легко согласится на то, что машины погубят 100 человек для спасения миллиона – в случае утилитарной морали здесь даже не стоит вопроса. В то же время, многим будет нелегко это принять. Я подозреваю, что ответ заключается в том, чтобы понять, как мы, как отдельные лица, уделяем особое внимание инцидентам и трагедиям, в то время как в роли общества мы уделяем внимание оценке рисков и общественным благам.

Те, кто читал мои тексты, знают, что я терпеть не могу стандартное применение «проблемы вагонетки» к беспилотным автомобилям. В этом приложении люди представляют себе программное обеспечение в автомобиле, которое должно решить какую из двух разных групп людей убить в аварии. Мы болезненно охвачены идеей о том, что теперь машины решают кто должен умереть, хотя раньше это было полем деятельности богов. На самом же деле это исключительно редкая ситуация, и ее разрешение не входит ни в чей список приоритетов. Программисты и компании также не хотят писать алгоритмы, связанные с моральными выборами, они бы предпочли, чтобы политики отвечали на такие вопросы и писали законы, которым они с радостью будут следовать.

Однако у оригинальной проблемы вагонетки была реальная функция, которая может быть полезна в данной ситуации. Она была создана, чтобы помочь нам понять наше собственное мышление и помочь понять разницу между моральными системами, основанными на правилах, и теми, что ориентируются на результат, то есть в конечном итоге – с помощью проблемы вагонетки мы должны были лучше понимать философию. И она может помочь нам лучше разобраться в этой ситуации.

Как вы, возможно, помните, в исходной задаче, тележка мчится по рельсам со сломанными тормозами. Кто-то (действительно аморальный в этой ситуации) привязал 5 человек к основной дороге, и одного человека к ее ветке. Вы можете дернуть переключатель, чтобы убить одного человека, но спасти пятерых. До 90% людей выбирают утилитарный (основанный на результатах) подход и предпочитают дернуть рычаг, но некоторые отказываются. (На самом деле, эти люди скорее ведут себя таким образом в упражнении в классе. В шоу "Mind Field" на YouTube проводился эксперимент, в котором людей заставляли думать, что они действительно оказались в ситуации с несущейся вагонеткой и привязанными людьми. Внимание, спойлер: большинство испытуемых просто застыли в ужасе)

Мне нравится говорить, что инженерное решение этой задачи более простое – нужно починить тормоза вагонетки. Инженеры беспилотных автомобилей преимущественно будут работать над тем, чтобы их автомобили никогда не попадали в такие ситуации, пусть они и происходят очень редко.

Вариации проблемы вагонетки, которые придумали философы, гораздо интереснее оригинальной формулировки. В одном из вариантов вам нужно не дернуть переключатель, а толкнуть толстого человека на рельсы, чтобы остановить тележку — немногие пойдут на это, так как это преднамеренное убийство. В наиболее экстремальной версии у вас нет вагонетки, но есть 5 пациентов, которым срочно нужна пересадка органов. Вы можете схватить человека, идущего по улице, разрезать его и спасти пятерых человек – почти никто не согласен так поступить, хотя это та же самая проблема с точки зрения утилитарного подхода.

Почти никто так не поступит, потому что среди нас мало тех, кто строго принадлежит к той или иной моральной школе. Для нас сложнее изменить наше мышление. Чтобы понять и решить проблемы в области тестирования и выпуска беспилотных автомобилей, мы должны превзойти естественный и индивидуальный инстинкт, чтобы воспринимать различные случаи как «всего лишь» отдельные трагедии, которые они из себя представляют, и думать о том, какие риски приемлемы и могут быть разрешены как общество.

Кроме того, у нас гораздо более сильное отторжение вызывают трагедии, которые происходят со сторонними прохожими, хотя мы не возражаем настолько же сильно против того, чтобы подвергать этих людей меньшим рискам. Наконец, мы больше боимся того, что нам нанесут вред самостоятельные машины, а не люди.

Люди забавны в том, что хотя большинство боится смерти от роботов, скорее мы будем убиты нетрезвым преступником.

В основном люди считают, что убивать, чтобы спасать жизни, неправильно, это бесспорно. Реальный вопрос состоит в том, что на самом деле из себя представляет тестирование и выпуск беспилотных автомобилей на дороги – убийства для спасения жизней, или принятие рисков с той же целью. На самом деле, в большинстве случаев мы согласны на то, чтобы рисковать ради спасения жизней при условии хорошего результата.

Моральные аспекты вождения

Итак, какова связь между философией морали и автомобилями? Для того чтобы это выяснить, нам необходимо задуматься о моральном аспекте дорожных происшествий. Люди по отдельности и общество в целом по-разному относятся к этой проблеме. Общества в целом и закон в частности, предпочитают не описывать что-либо как безнравственное или злое, если только не было злого умысла, который в юриспруденции называют mens rea. Почти все уголовные преступления подразумевают злой умысел, а если его нет, то наказание (в большинстве случаев) смягчается. Из-за этого нередки ситуации, когда кто-то сбивает насмерть человека на машине и не несет за это уголовной ответственности. Водителю будет грозить финансовое наказание, но оно покрывается страховкой. Виновник выйдет из этой ситуации только с чувством вины за то, что произошло. Но все это верно только в том случае, когда убийство человека было совершенно непреднамеренным и фактически полностью противоречило намерениям водителя. Не может быть убийства (даже непредумышленного) без четкого намерения или серьезной и умышленной халатности за рулем.

В то же время, мы прилагаем все усилия, чтобы определить наличие злого умысла или халатности, потому что нас очень беспокоит тот факт, что что-то столь трагическое как смерть может остаться без ответа. Но если мы говорим о ситуации, в которой действительно произошел несчастный случай (под которым я подразумеваю, что он произошел в рамках обычных рисков осторожного вождения) – нет никаких юридических последствий, самое серьезное, что может произойти – последствия финансовые, которые полностью оплачиваются страховкой.

С другой стороны, рассмотрим превышение скорости. Превышение скорости незаконно, даже если оно часто совершается, но в некоторых местах наказывается редко. Когда вы ускоряетесь, вы знаете (или должны знать), превышаете вы или нет. При этом вы подвергаете дополнительному риску других людей, хотя, к счастью, как правило ничего страшного не происходит. Несмотря на то, что вы непременно получите штраф за превышение скорости, если это превышение привело к аварии, большинство штрафов выписывается за превышения, которые никому не навредили. Почти все из нас периодически превышают скорость, и мы делаем это по очевидной причине – мы хотим добраться куда-то немного быстрее. Это может противоречить интуиции, но преднамеренное превышение скорости в нашей системе более аморально и незаконно, чем случайное убийство, хотя мы как личности гораздо более терпимы к превышениям.

Я полагаю, что настоящая моральная проблема в вождении заключается в том, что мы умышленно подвергаем риску других людей. Или, для большей конкретики, неприемлемо высокому риску. Любое вождение подразумевает, что другие люди будут подвергнуты риску. На самом деле, вероятно, при вождении мы наиболее часто подвергаем других людей наибольшему риску. Все мы знаем ошеломляющее количество смертей, травм и случаев нанесения материального ущерба от вождения – в авариях погибло больше людей, чем суммарно на всех войнах и в результате терактов за всю историю Соединенных Штатов со времен войны за независимость. Все это пугающе рискованно, но для нас это так важно, что мы решили согласиться на этот относительно высокий риск для себя и людей вокруг. Мы делаем это намеренно, хотя и часто забываем об этом, и мы, безусловно, плохо помним математическую сущность этих явлений. Мы считаем этот базовый уровень риска «приемлемым» в наших законах и нашей жизни.

Общество решило, что неправильность и незаконность заключаются не в конкретных жертвах, а в преднамеренном и небрежном подвергании других людей чрезвычайному риску.

Мы написали законы, которые запрещают вам подвергать других людей исключительному риску, и вы получаете штрафы за превышение скорости, неправильную смену полосы движения и небрежное вождение. Мы считаем такие поступки аморальными, поскольку они совершаются умышленно или из-за халатности, хотя мы не считаем аморальным смертельный исход, который не был действительно непреднамеренным. Это не останавливает тех, кто видит в этом великую трагедию, и это абсолютно естественная реакция. Но как общество, которое пишет и исполняет законы, мы воспринимаем все иначе.

Мы считаем приемлемыми удивительное количество рисков, связанных с вождением:

- Вождение в плотном потоке

- Вождение в дождь, снег и ночное время

- Вождение в местах с большим количеством пешеходов и велосипедистов

- Вождение машины с небольшими механическими неполадками

- Вождение машин без автоматического экстренного торможения и других продвинутых технологий

- Вождение в сонном состоянии, даже когда мы засыпаем (в двух штатах есть законы, запрещающие сонливое вождение)

- Вождение беззаботных подростков, только недавно получивших права

- Вождение учащихся в сопровождении взрослых

- Вождение пожилых людей со сниженным восприятием и повышенным временем реакции

- Вождение с уровнем алкоголя в крови чуть ниже разрешенного

- Вождение в болезненном состоянии (несмотря на то, что это незаконно)

- Использование устройств и написание сообщений в процессе вождения (несмотря на то, что это незаконно)

- В США превышения скорости очень распространены, зачастую с большим отрывом от других машин

Давайте рассмотрим прототип беспилотного автомобиля. Когда команда разработчиков выводит такую машину на дорогу, они намеренно подвергают других участников движения риску. Разумеется, они не намерены вызвать какую-либо аварию, фактически они намерены ее не допустить.

В данный момент тестовые беспилотники, кроме нескольких исключений, всегда работают под контролем водителя-человека, готового взяться за дело в случае возникновения проблем. Почти всегда есть и второй человек, который следит за системами и время от времени поглядывает на дорогу. Это можно сравнить с ситуацией, когда водитель-тинейджер с ученической лицензией водит в сопровождении инструктора. У инструктора есть своя педаль тормоза, и он может перехватить руль, как и водитель в беспилотнике. Водители-подростки, сопровождаемые инструкторами, на самом деле имеют довольно неплохие показатели безопасности, как и почти все команды, занимающиеся беспилотными автомобилями – за исключением Uber, о котором я расскажу позже.

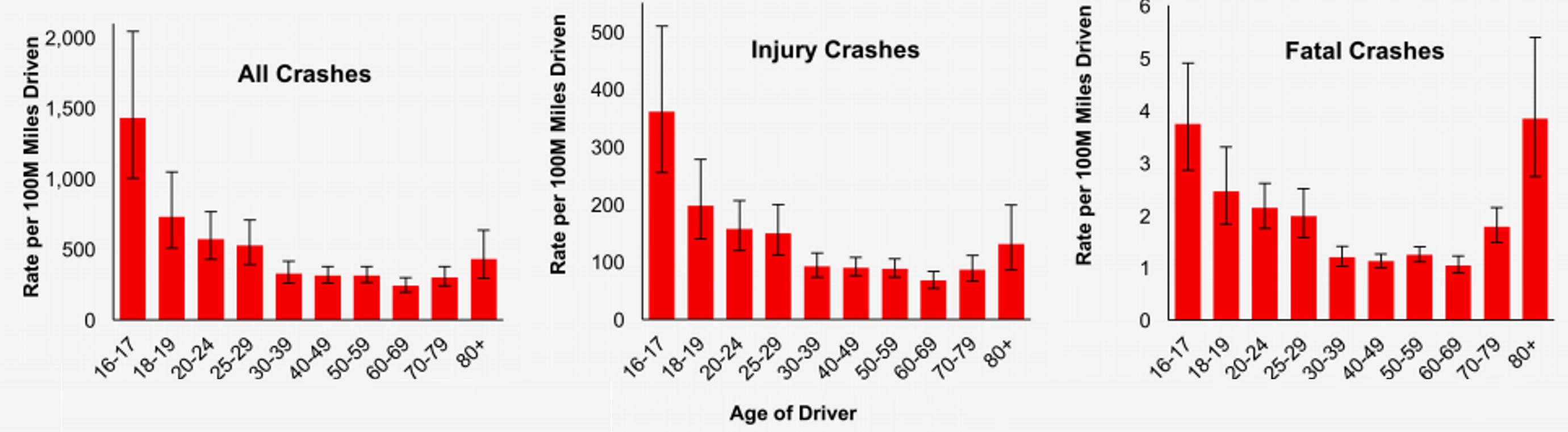

Эти подростки-водители, получив лицензию после прохождения минимального теста, становятся самыми опасными водителями на дороге. Мы выпускаем их на дорогу, чтобы дать им мобильность, на также потому, что это единственный способ сделать из них более осторожных взрослых водителей, которыми они станут в конечном итоге. Мы берем на себя риски, связанные с вождением водителя-подростка, в надежде в будущем получить более осторожного водителя. Из каждого рискованного подростка на дороге вырастает один взрослый, более осторожный взрослый (на самом деле чуть меньше одного, потому что не все подростки действительно достигают этого самого безопасного возраста).

Как отмечалось ранее, команда разработки беспилотных автомобилей подвергают людей вокруг некоторому риску, однако польза, которую приносит этот риск, огромна. Небольшая учебная поездка улучшит безопасность всех последующих автомобилей, которые будут созданы позднее, что в конечном итоге означает миллионы улучшенных автомобилей. Принимая первичные риски тестирования и разработки, мы получаем выгоду от значительного снижения рисков в будущем. Снижение рисков наступит тогда, когда машины начнут водить безопаснее, чем люди, а люди перестанут подвергать риску окружающих, выбирая поездку на беспилотном автомобиле вместо самостоятельного вождения. Это особенно верно, когда речь о людях, которые выпивали или связаны с каким-либо из пунктов списка выше.

Некоторые утверждают, что мы должны учитывать не просто чрезвычайные риски, а необходимые. Потому что может быть неверно подвергать людей обычному риску, если в этом нет необходимости. В частности, некоторые утверждают, что нынешние команды проводят больше тестов, чем необходимо, и что это неправильно. Возможно, это верный подход (хотя, конечно, необходимое количество тестов остается предметом споров). Тем не менее, если мы рассмотрим причины, по которым люди принимают рискованные решения на дороге – от доставки еды, до возвращения домой на минуту раньше, едва ли они удовлетворяют уровню необходимости, несмотря на то, что мы терпим эти риски.

Здесь мы должны рассуждать, отталкиваясь от результатов. Усилия команд, работающих над беспилотными автомобилями, снижает уровень риска по всему миру, и как общество мы должны относиться к этому положительно. Мы должны разочарованно покачать головой из-за того, что мы вообще допустили такие риски в человеческом вождении. Как и в случае водителя-подростка, мы можем заметить компромисс между принятием рисков в обучении и ранним началом водительской практики для снижения рисков в будущем. Подвергать риску других – неправильно, предотвращать его – правильно. Истина в балансе.

Измерение рисков

Очень хорошо, когда есть баланс. Мы можем позаимствовать термин из анализа рисков и сказать, что каждая миля автоезды производит 0.1 микроморт риска по всему миру. Микроморт – риск гибели, равный 1 к миллиону. В США это значение лучше среднего – около 0.013 микроморт на милю. Оказывается, что можно легко просчитать снижение рисков, связанное со скорым появлением безопасных беспилотных автомобилей. Необходимо вычислить насколько безопаснее будут эти автомобили в дальнем будущем – допустим, вдвое безопаснее, чем человеческое вождение в США, то есть 1/250 микроморт на милю. Затем вы умножаете это значение на мили человеческого вождения, которые накопятся за время, пока первичный выпуск беспилотных автомобилей будет откладываться. Таким образом вы учитываете предположение, что при задержке первичного выпуска беспилотных автомобилей на это же время задерживается и полная замена человеческого вождения на поездки на беспилотных автомобилях. Это не вполне точная оценка, но получается хорошее приближение. Таким образом, если вы отложите выпуск беспилотных автомобилей на год, то в результате вы получите более половины триллиона (это огромное значение) микромортов по всему миру, что равняется половине миллиона смертей. Задержка всего на один день принесет 1.5 миллиарда микромортов риска, которым будет подвергнут весь мир. Мы водим настолько много (по моим подсчетам около 1.7 световых лет каждый год), что только световые года могут быть единицей измерения человеческой активности.

Вы можете спросить, почему я пишу о «миллиардах микромортов», хотя проще написать о тысячах жизней? В этом весь смысл этого текста – научиться думать о тестировании как о миллионах небольших рисков, каждый из которых приносит все больше пользы, а не относиться к испытаниям как к обязательным сериям трагических смертей. Точно так же, как мы относимся к миллиардам доставок пиццы, которые представляют собой миллиарды крошечных рисков в обмен на миллиард простых ужинов.

Несколько тысяч прототипов роботизированных автомобилей создают риски, но их не настолько много. Если бы мы предположили, что они водят крайне небезопасно (а это совсем не так), то мы получили бы около 100 000 микромортов за все время их существования. Сравните это с 1.5 миллиардами за каждый день задержки выпуска беспилотных автомобилей. Эти цифры трудно игнорировать. 100 000 единиц риска против триллионов – с учетом осторожных предположений, которые учитывают порядка 10 миллионов миль тестирования и создание и выпуск на 2-3 года раньше.

Тем не менее, у нас все еще есть проблемы. В одном из вариантов проблемы вагонетки людям говорят, что если дернуть переключатель, то поезд не переедет только одного человека, привязанного к рельсам, а скорее сойдет с рельс и слетит с холма прямо в дом спящего человека, убив его. Люди гораздо более неохотно дергают переключатель. Предполагается, что это происходит потому что человек, привязанный к рельсам, непосредственно «вовлечен» в ситуацию, а спящий является сторонним наблюдателем. Будучи моральными личностями, мы не готовы взять на себя смерть кого-то, кто не имеет никакого отношения к этой ситуации. Но, похоже, мы легко готовы подвергать небольшому риску посторонних людей во время нашего вождения.

Насколько хорошо безопасное вождение?

Насколько велик риск? Ведущей компанией в этой сфере является Waymo. Я работал над их проектом 7 лет назад, когда он принадлежал Google. Их машины проехали более 10 миллионов миль и лишь один раз произошло незначительное повреждение имущества. У них было больше аварий по причинам, отличным от тех, которые мы обычно ожидаем услышать, но даже с учетом этих происшествий они добились очень хорошего показателя безопасности – лучше чем у среднего водителя, и конечно лучше, чем у подростка, который только недавно получил права. Весьма вероятно, что любая сеть пиццерий подвергает людей большему риску в соотношению на милю чем машины компании Waymo, при это все, что мы за это получаем – доставка вкусной еды, а не огромное снижение рисков, которое нам обещает выпуск роботизированных автомобилей. И в случае с пиццериями, мы не получим развития молодых водителей в зрелых и надежных.

Tesla публикует информацию о расстоянии, пройденном между авариями с машинами Tesla на автопилоте и на ручном управлении. Последними опубликованными цифрами были 4.3 миллиона миль в случае с автопилотом и 2.7 миллиона миль при выключенном автопилоте. Tesla не уточняет какой именно была авария, поскольку автопилот почти полностью является продуктом для шоссе, количество аварий будут ниже в тех местах, где он используется, но эти цифры хороши даже с учетом этих факторов. Они предполагают, что риск наличия только одного необученного потребителя в роли водителя, обеспечивающего безопасность (который находится за рулем во время работы автопилота) на шоссе находится в рамках допустимого риска, что подтверждает, что двух хорошо обученных водителей безопасности достаточно с большим запасом. Как ни странно, непонятно, что означает для необученных водителей-одиночек ситуация, в которой система становится настолько хорошей, что водитель становится самоуверенным, или же что это означает для езды по городским улицам. Однако, Tesla вскоре расширит предлагаемые услуги и добавит в автомобили информацию об улицах города, а также поможет ответить на различные вопросы, связанные с нашей темой. На эти вопросы уже есть ответы для опытных водителей безопасности, но большим исключением является компания Uber.

Uber

В марте 2018 года автомобиль компании Uber сбил насмерть Элейн Херцберг, жительницу Темпе, Аризона, которая пересекала пустую дорогу за пределами пешеходного перехода. Большинство людей в этой отрасли поражены тем, что автомобиль не обнаружил женщину и не затормозил с большим запасом времени. Причины этого отказа широко обсуждались, но в результате Национальный совет по транспортной безопасности, я сам, и многие другие пришли к выводу, что это была на 99.9% человеческая ошибка. Uber сделали очень плохое решение при выборе и обучении водителей, отвечающих за безопасность, и решили оставить только одного водителя вместо двух по каким-то глупым причинам, при этом они не следили за тем, насколько внимательно водители относились к безопасности. В результате водитель, отвечавшая за безопасность, проигнорировала все протоколы и, как заявляется, смотрела телешоу на своем смартфоне, в то время как система автопилота Uber, будучи плохо спроектированным прототипом, не смогла обнаружить пешехода, когда это было необходимо, и из-за еще большего количества глупых причин не смогла подействовать в момент, когда пешеход был обнаружен в последний момент. Работа водителя безопасности заключалась в том, чтобы следить за дорогой и вручную тормозить и поворачивать в случае таких неисправностей. Она этого не сделала, и результат оказался трагическим. Неудача была связана с водителем безопасности, ее подбором и обучением — у всех команд есть сбои в системе, которые требуют вмешательства, особенно в первые годы — но было и множество других обвинений. Uber прекратил тестирование и лишь спустя 18 месяцев компания вернулась к ограниченным испытаниям в Питтсбурге, хотя они надеются вернуться к большему.

Есть веский аргумент, что водитель безопасности была небрежна и подвергла общество совершенно неприемлемому уровню риска, пытаясь смотреть телешоу, в то время, как ее задачей было следить за дорогой и работой автомобиля. Если это так, она должна быть наказана за это. Люди утверждают, что компания Uber пользовалась плохими методами во многих областях и делала это либо преднамеренно, либо по халатности. И если это правда, то это за это компанию необходимо наказать, либо пытаться предотвращать подобные ситуации. На самом же деле из-за того, что жертва была бездомной, а также переходила дорогу в неположенном месте, суд не приговорил Uber к каким-либо тяжелым наказаниям, однако ответственность перед обществом и правительством была велика. Компании Uber запретили работать в штате Аризона на долгое время.

Для того чтобы отрегулировать безопасность испытаний и выпуска беспилотных автомобилей на дорогу, мы должны научиться оценивать величину риска, которому команды разработчиком могут подвергать других людей. Нам хочется, чтобы местные правила мотивировали команды держать риски ниже приемлемого уровня. Но было бы по меньшей мере глупо требовать, чтобы эти риски были значительно ниже тех, на которые мы согласны для получения гораздо меньших выгод. На самом деле, награда настолько велика, что мы должны мириться с тем, что тестирование беспилотных автомобилей является одной из самых рискованных вещей, который мы допускаем на дорогах, хотя мы не хотим и не должны соглашаться на неприемлемые ранее уровни риска. Но если мы собираемся позволить миллионам водителей путешествовать сонными по ледяным дорогам с содержанием 0,07% алкоголя в крови для получения очень малой выгоды, то было бы разумно согласиться с уровнями риска тестирования беспилотных автомобилей, которые намного ниже, чем в описанной ситуации.

Не то чтобы компании хотели брать на себя такой уровень риска. Фактически, многие из них вложили в эти проекты миллиарды долларов и свою репутацию. Еще до того, как Uber были вынуждены свернуть все работы (возможно навсегда), команды знали, что любой такой инцидент может быть губительным для их проекта, компании, а также для их собственной совести. Подавляющее большинство старается держать уровень риска настолько низким, насколько это возможно. Это не означает, что всем компаниям можно доверять – это невозможно. А также это не значит, что мы не хотим устанавливать хорошие принципы безопасности и создавать дополнительные средства сдерживания, которые уберегут нас от использования плохих методов. Но мы не должны упускать из виду то, что наши регулирующие органы могут рассказать компаниям о том, как изобрести совершенно новые способы повышения безопасности. Потому что каждый день отсрочки выпуска беспилотных автомобилей равен 3 миллиардам микромортов.

Заключение

Некоторые из нас рассуждают с позиции системы морали, основанной на правилах – мы хотим предотвратить любую возможную смерть, особенно в случае с посторонними наблюдателями. Но есть и часть людей, которая пользуется системой морали, основанной на результатах, особенно когда речь идет об оценке уровней рисков, а не трагедий. Мы одновременно поражаемся любой смерти, которую могли бы предотвратить, но все же стремимся пойти на небольшой риск для себя и других, когда речь идет даже об умеренном вознаграждении.

Мы можем сказать, что нам не нравится план, в котором 100 человек могут погибнуть ради создания того, что спасет миллионы жизней. В то же время, мы можем сказать, что мы не против того, чтобы пойти на множество небольших рисков, чтобы значительно уменьшить уровень нашего риска в будущем.

Мы смешиваем наши личные и общественные реакции, когда происходит настоящая трагедия. Наши суды и законы пытаются продвигать то, что лучше для общества, но в то же время наши моральные инстинкты означают, что даже на малейший дополнительный риск — тот, который обычно остается безнаказанным — охотятся и реагируют экстремальными способами. Нарушения правил, вроде превышения скорости, которые допускаются людьми каждый день, наказываются сурово в тех случаях, когда происходит что-то серьезное, и превышение скорости имело место, даже если оно не было причиной происшествия. Мы не хотим, чтобы закон был таким капризным, но мы также не можем допускать трагедии.

Страховые компании думают об общей картине, как и мы, когда мы покупаем их полисы. Правительства думают так же. Мы должны научиться рассуждать таким образом и принять позицию с согласием на допуск небольших рисков, если мы хотим разобраться с настоящей трагедией, которая является результатом плохой истории человеческого вождения.

О компании ИТЭЛМА

Мы большая компания-разработчик automotive компонентов. В компании трудится около 2500 сотрудников, в том числе 650 инженеров.

Мы, пожалуй, самый сильный в России центр компетенций по разработке автомобильной электроники. Сейчас активно растем и открыли много вакансий (порядка 30, в том числе в регионах), таких как инженер-программист, инженер-конструктор, ведущий инженер-разработчик (DSP-программист) и др.

У нас много интересных задач от автопроизводителей и концернов, двигающих индустрию. Если хотите расти, как специалист, и учиться у лучших, будем рады видеть вас в нашей команде. Также мы готовы делиться экспертизой, самым важным что происходит в automotive. Задавайте нам любые вопросы, ответим, пообсуждаем.

Мы, пожалуй, самый сильный в России центр компетенций по разработке автомобильной электроники. Сейчас активно растем и открыли много вакансий (порядка 30, в том числе в регионах), таких как инженер-программист, инженер-конструктор, ведущий инженер-разработчик (DSP-программист) и др.

У нас много интересных задач от автопроизводителей и концернов, двигающих индустрию. Если хотите расти, как специалист, и учиться у лучших, будем рады видеть вас в нашей команде. Также мы готовы делиться экспертизой, самым важным что происходит в automotive. Задавайте нам любые вопросы, ответим, пообсуждаем.

Читать еще полезные статьи: