Comments 733

Можно писать исключительно на typescript и быть fullstack

- Сложно найти технологию, которая везде считается приемлемой.

- Я писал про фуллстек, а вы мне про сеньор бекенд. Ок.

2. В статье же об этом речь. И, пожалуй, требование знать sql ко всем бэкендщикам относится.

- Python, Go, Java отличные технологии, но тоже не всея руси.

- Я не спорю, что чем больше технологий знаешь, тем лучше. Но использование SQL тоже не обязательно. Есть ORM, есть NoSQL базы данных.

Мой первый комментарий не ставит под вопрос другие технологии, но NodeJS + TypeScript (JavaScript) впервые дали возможность быть FullStack и писать только на одном ЯП. Тем самым упрощая процесс профессионального роста.

Поправьте меня если я неправ, но Razor — это по сути шаблонизатор. На нем клиентскую логику вы не напишете.

сеньором во фронте не станешь

А каким критериям должен удовлетворять уровень человека что бы можно было именовать его сеньором?

Наверно, надо уметь писать асемблерные вставки :)

Обычно сеньор отличается от мидла лучшей проработанностью решения (на тестировании всплывают только миноры) и понятностью мышления (поскольку человек знает предметную область он использует наиболее простые и логичные методы решения, следовательно код легко понять в целом, а часто и в нюансах).

Мидл же может наворотить пачку костылей. Просто потому, что хуже знает систему и предметку, плюс часто хочет показать что «я вот так умею».

Ну и сеньор менее заметен в офисе, но более заметен в баг-трекере)

Хотя фулстеком того кто пользуется только ими назвать сложно.

Во-2, сеньор бэкенд программист обязан знать как минимум sqlb ещё одну технологию, например, java или python.

Зачем сеньору-то знать другую технологию? Он же не джун.

Не все приложения требуют использования триггеров. Я и не писал, что typescript на все случаи жизни.

Любой триггер можно реализовать программно вне СУБД. Естественно будут потери.

Так можно до бесконечности продолжать. Например у вас в проекте должен быть ИИ, а нейросеть вы строить не умеете. Вы уже не fullstack.

Насколько я понял статья именно об этом. Что люди которые считают себя всемогущими FullStack разработчиками в большинстве случаев просто не знают, что данную задачу (например, триггер) грамотнее реализовать при помощи СУБД, а не «программно» наступая на все грабли. Или я неправильно понял суть статьи?

При решении любой задачи можно использовать различные подходы. Можно использовать решение проверенное временем от профессионалов (например, реализация триггеров Oracle Database), а можно взять и реализовать их самостоятельно. Можно и Web-серверы и СУБД реализовывать самостоятельно.

Люблю, да. Особенно вижу категоричные суждения или оперирование общими оценочными категориями типа "грамотней" без указания критериев :)

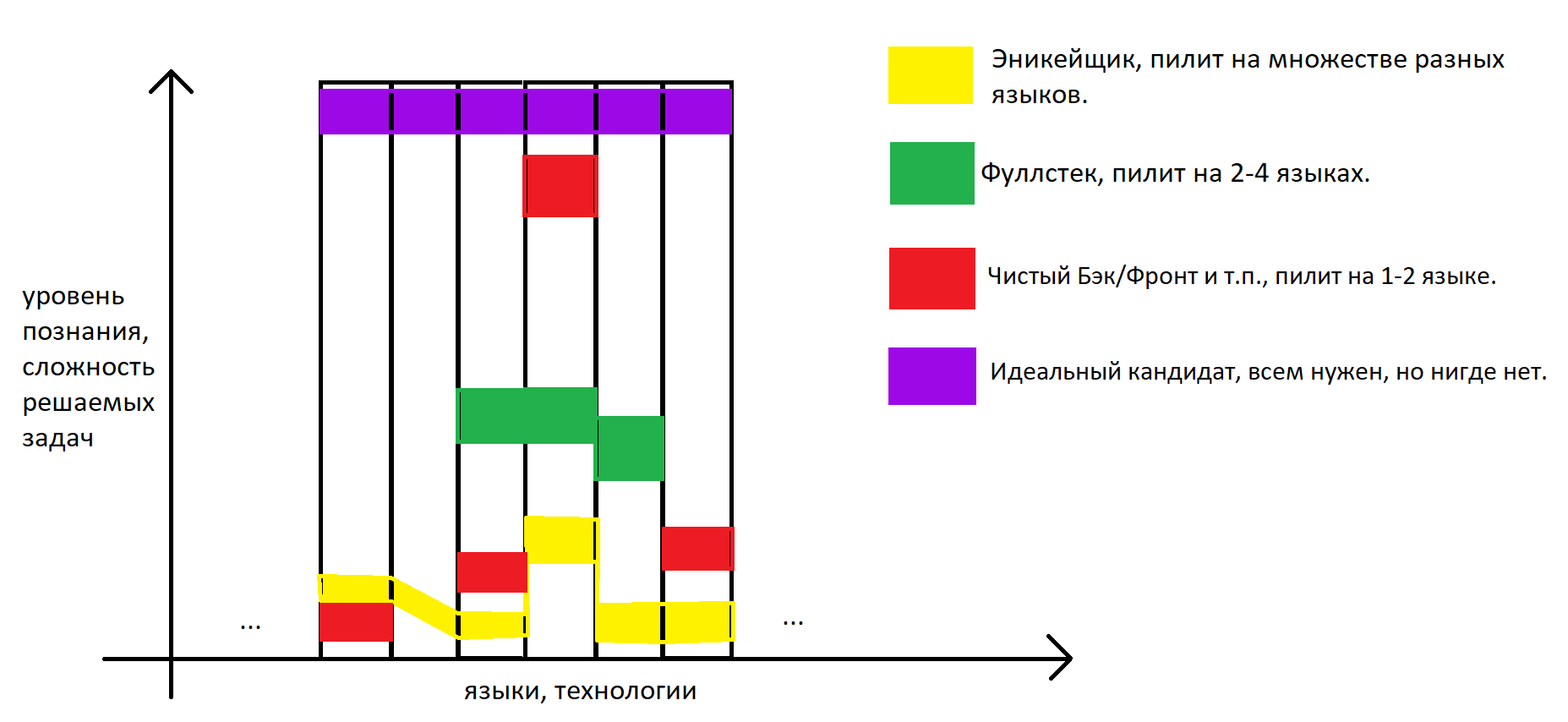

Когда бизнес молодой и развивается, ему важно как можно быстрее и проще провалидировать жизнеспособность своей модели. В этих условиях, человек-оркестр, способный в одиночку запилить и бэк, и фронт, намного выгоднее двух крутых специализированных бэк/фронт разработчиков.

Другое дело — когда бизнес уже захватил основную часть аудитории, и начинается борьба за оптимизацию и увеличение конверсии. Тут нужен тюнинг перформанса и все остальное в таком духе, и нужны узкие спецы.

Проблема узких спецов на старте — часто они сходу начинают оптимизировать под будущий «хайлоад», когда вообще не факт что бизнес вообще взлетит.

Но всё решают зависимости. В триггере мы можем обработать данные из той же БД, довольно шустро и без особых рисков.

Но если, при изменении записи, нам надо взять данные не из DB, и как-то их по хитрому обработать… Тут возможно имеет смысл спроектировать слой над базой данных, а консистентность сохранить за счёт транзакционности и прямых рук. Это может оказаться, быстрее, надёжнее и даже проще реализовать.

Но, кмк, нам намекают, что то, что можно сделать в триггере, лучше сделать в триггере. Например записать лог изменения записи, или поддержать волшебным образом денормализацию «на лету». И плодить хитрое решение на технологии, которую лучше знаешь, а не на той, на которой от тебя ждут решение… По моему это подготовка будещего мазохизма, притом не своего, а того, кто будет поддерживать твою систему «если что».

Если от тебя ждут решения на конкретной технологии, то надо его как-то делать или сообщать, что не можешь. Но часто такие нюансы как реализация логирования остаются в лучшем случае на усмотрение команды, а и одного разработчика.

В триггере мы можем обработать данные из той же БД, довольно шустро и без особых рисков.

Проблема же в цене поддержки. Если бизнес-логика размазана по триггерам и хранимкам дб — это очень печально. Просто sql очень плохой язык с точки зрения промышленного программирования, вот и все.

Ну тут есть вариант: бизнес логика собрана в триггерах и хранимках. И на это может быть много причин. До сих пор.

Кроме того, на триггер можно возлагать стандартные процедуры. Я уже упоминал логгирование, также принудительная генерация ключей в оракле, что бы исключить косоруков вручную ставящих id. Вообще да, триггер место для выстрелов в ногу, и много чего можно выносить на уровень приложения или хранимок.Но это не значит, что от триггеров надо отказываться принципиально.

И опять же начало спора было о том, что для разных случаев разные инструменты. И знание вариантов инструментов нелишне.

PS. Sql в богатых расширениях(транзакт sql, pl/sql) это отличный язык для промышленного программирования. Просто нужно понимать какие, задачи решать на нём. Вы же не будете для построения статистики тащить 50 таблиц по миллиону записей на клиент) И пре и, пост обработку данных для некоторых операций проще делать хранимкой

Можно ведь и не в СУБД хранить, а в файлах и всю логику держать на клиенте (вообще всю базу сразу отправлять на клиента, включая данные всех пользователей, а уж клиент будет делать выборку). Вполне можно реализовать, но мало кто назовёт это правильным.

FullStack хорош для запуска первой версии продукта или для небольших фирм. Когда требуется не "грамотная реализация", а реализация в принципе. По мере роста проекта уже требуются более узкие специалисты.

А статья, если честно, ни о чем. Типа, если вы будете изучать технологии А, Б, В, то никогда не изучите технологию А также глубоко, как человек, который изучает только технологию А. Это очевидно.

Вот с этим абсолютно согласен. Уверен, что множество разработчиков в принципе никогда не станут Senior разработчиками даже если будут изучать хоть всю жизнь одну технологию.

Код проще тестировать и поддерживать. Да и случаи замены базы, хоть и довольно редки, но все-равно случаются.

pgxn.org/dist/plv8/doc/plv8.html

не совсем ts, но можно его при желании сбоку прикрутить :)

А можете привести пример триггера в какой-нибудь СУБД (SQL Server, MySQL, PosgreSQL, Oracle Database) на TypeScript?

Есть же достаточно распространенное мнение, что использование триггеров (и вообще дергание скл руками) — code smell. В такой парадигме неумение использовать тригеры — конкурентное преимущество.

Уметь в SQL проще и продуктивнее чем уметь в ORM, разве нет?

Зависит от ситуации.

SQL, конечно, хорош в плане перформанса, но:

- не всегда в принципе скорость запросов — бутылочное горлышко.

- код на SQL, мягко говоря, не слишком удобен в плане поддержки.

В общем, как и всегда — есть разные задачи, есть разные инструменты, а серебряной пули нет.

код на SQL, мягко говоря, не слишком удобен в плане поддержки.просто надо использовать нужные инструменты для его поддержки. Если использовать хранимки, то в коде не будет запросов, все запросы в хранимках на сервере, к примеру для mysql есть интсрумент как DbForge, который позволяет писать, отлаживать, сопровождать хранимки. делать рефакторинг, и много ещё чего.

не всегда в принципе скорость запросов — бутылочное горлышко.трудно не согласиться, но если есть возможность — надо ей пользоваться — к примеру поля даты можно уже в запросе привести у нужному виду, числа сформировать с нужными разделителями разрядов.

Если использовать хранимки...

Если она будет ровно одна, то, возможно, не стоит.

к примеру поля даты можно уже в запросе привести у нужному виду, числа сформировать с нужными разделителями разрядов.

… однако, если у вас уже есть подсистема, которая форматирует данные, в том числе полученные не из БД, то этого делать не нужно. Особенно если там все по-взрослому, с подтягиванием настроек пользователя, определением региона, учетом смещений часовых поясов и всего такого.

ИМХО, спор про то, на чем правильно делать то или это в абстрактном проекте — беспредметный.

- Как язык SQL плох, но без него никак. Он динамический, имеет громоздкий синтаксис и на 90% состоит из весьма нудного бойлерплейта. Читать — легче. Понимать — ещё легче.

- Переписывать всю БЛ на хранимки, как предлагают некоторые горячие головы, равносильно отстреливанию себе в упор всех конечностей.

- Хорошие ОРМ значительно удешевляют разработку. Но чтобы уметь ими пользоваться, нужно по мимо ОРМ знать SQL.

- Даже с самой хорошей ОРМ писать SQL всё равно придётся.

- Использовать nosql только потому, что лень учить SQL или разбираться с ОРМ — такая же дичь, как и писать всё на хранимках, чтобы не учить условную java. Нужно учить CAP теорему и разбираться, когда использовать nosql 1) допустимо 2) приемемо 3) оправдано. Вопросы не тривиальные практически всегда.

Я сам вообще стараюсь хранимки использовать по минимуму. Понятное дело, что иногда они дают важный буст производительности, особенно учитывая, что ORM не серебрянная пуля и часто генерят диковатые запросы. Спросил не с целью «о, если мне еще юнит-тестов там подвезут, все буду на скулях писать», а с вопросом в духе «а чо, в мире есть проекты, где хорошо уживаются CI/CD, TDD и хранимки?» Потому что у меня на проекте они уживаются, но с очевидностью первое берет верх.

просто надо использовать нужные инструменты для его поддержки. Если использовать хранимки, то в коде не будет запросов, все запросы в хранимках на сервере, к примеру для mysql есть интсрумент как DbForge, который позволяет писать, отлаживать, сопровождать хранимки. делать рефакторинг, и много ещё чего.

Я в эти сказки не верю после того, как столкнулся с развитием продукта построенного в основном на SQL. Боль заключается в том, что если на типичном бекендском языке можно разбить 2000 строк на 40 групп по 50 строк с дополнительным оверхедом в 200 строк, то на sql оверхед составляет ближе к 500-1000 строк. И это делает нецелесообразным попытки написать хороший код. Соблюдать DRY почти невозможно. Увы, SQL не имеет средств для нормального реюза кода. Т.е. развивать код на SQL можно только до определенных пределов.

В другой продукте использовались хранимки на SQL, но гораздо меньшие и более конкретные. И это было счастьем. За исключением того, что все хранимки стали выглядеть автоматизируемыми. Туда явно напрашивалась абстракция. Но существующие инструменты (ORM) слишком сильно были заточены под паттерн «хуяк-хуяк» и были малопроизводительными. Хранимки оказались наименьшим злом на тот момент.

SQL-скрипты не версионируются в Git?

и дамп и восстановление.

слияние — в ide -выбор в меню, выбор базы источника, выбор базы приёмника — сравнение — галочками отметить что слить — enter, итого секунд 30.

из практики — ни о каких сотнях в день речь не идёт…

дамп делается не всей базы а только выбранного -структуры, данных или отдельных выбранных элементов.

каждому разработчику лучше иметь свой экземпляр базы, (лучше на своей машине) со своим набором даннх(они могут быть элементарно перенесены как с базы продакшена, так и с любой базы разработчиков)

при слиянии отображается разница между базами-по каждому элементу как структуры так и данных.

отладка также происходит в ide, хранимки можно отлаживать по шагам (запрос в хранимке -это один шаг).

написали хранимку сохранили — выполнили — увидели результат. можно отдельно отлаживать запрос тогда и сохранять не надо просто написать — запустить — увидеть результат. и уже потом вставить в хранимку.

А сотня изменений в команде из десяти разработчиков за день создаётся легко.

— скорость разработки

— возможность параллельной (или псевдопараллельной) работы над десятками фич или над несколькими фичами, затрагивающими много одних и тех же таблиц

— автоматическое разворачивание и обновление локально и на удалённых серверах

Причём даже с только с таблицами возникают ситуации, когда приходится предупреждать всех разработчиков, что собираешься, например, переименовать поле.

Я не чураюсь хранимок или триггеров, но для переноса в них части логики мне нужны очень веские основания. Главное — неперенос сделает работу какой-то конкретной фичи неприемлемо медленной для пользователей или заказчика. Но перенос для меня всегда оптимизация, которая делает систему быстрее за счёт уменьшения скорости разработки, её удорожания, ухудшения поддерживаемости и масштабируемости.

Причём даже с только с таблицами возникают ситуации, когда приходится предупреждать всех разработчиков, что собираешься, например, переименовать поле.это будет в любом случае, если есть необходимость изменить структуру базы. Но используя IDE субд это делается просто — везде где надо поле переименовывается а в зависимых запросах можно добавить as «старое_имя» и в коде никаких изменений вносить не надо…

в этих ide и прочий рефакторинг делается просто.

Я не чураюсь хранимок или триггеров, но для переноса в них части логики мне нужны очень веские основания. Главное — неперенос сделает работу какой-то конкретной фичи неприемлемо медленной для пользователей или заказчика. Но перенос для меня всегда оптимизация, которая делает систему быстрее за счёт уменьшения скорости разработки, её удорожания, ухудшения поддерживаемости и масштабируемости.Из практики — возможности хранимок увеличивают возможности, к примеру хранимки могут возвращать несколько результсетов, при добавлении записи в одну из связанных таблиц сразу добавляется и в другую… что сокращает обращений к базе. ну и, не маловажный фактор, защита данных, и полная защита от инъекций. Если не использовать специализированные ide для работы с базами — то это трудно и накладно, но ведь и никто не пишет проекты в блокноте…

я принял как стандарт — даже простейшие запросы оборачивать в хранимки — самое огромное преимущество — огромная быстрота быстрота их написания любой сложности и огромная быстрота отладки. написал — запустил — увидел результат. ни компиляции кода, ничего. даже в том же хибере, даже если ide помогает написанием запроса — то увидеть результат — надо сделать кучу действий. как минимум запустить какой-нибудь тест. В ide субд — только запустить на выполнение…

А вы правите код непосредственно хранимки или какого-то скрипта CREATE OR REPLACE…?

try (Connection con = dataSource.getConnection(); CallableStatement proc = con.prepareCall("{call хранимка1(" + param + ")}");) {

rs = proc.executeQuery();

rs.next();

userSession.getBasicRemote().sendText(rs.getString("av"));

} catch (SQLException | IOException ex) {

ex.printStackTrace();

}я написал вызов и обработку, в param набор передаваемых данных(вариантов прередыи несколько — выбор — повкусу и месту), на этом работ с java закончена.Открываю ide dbFogge и работаю с нужной хранимкой.

Я работаю непосредственно с хранимкой, всю остальную работу за меня делает ide. при запуске она спрашивает о сохранении хранимки и формочкадля ввода параметров(достаточно ввести один раз, в дальнейшем просто подвердить), иногда мне это надоедает я открываю запрос из храники (в том случае если хранимка состоит из одного запроса) в новой вкладке и просто запускаю его (предварительно организовав входные параметры(если они нужны :) )

добившись правильной и быстрой работы хранимки — сохраняю её. Всё. Никакой синхронизации.

если кто-то изменил что-то в базе, в огромном большинстве случаев в коде ничего менять не надо. Достаточно открыть хранимку она закричит о несоответствии чего-либо, просто её поправить, главное чтоб она возвращала «правильные» названия полей и их количество. Ну а — правильность данных в этом случае — это уже по месту. Чисто теоритически хранимка может представлять (на какомто этапе разработки) из себя заглушку, которая просто делает такое

select 0 as поле1 1, 'xxxx' as поле2 from table

union

select 3 as поле1 1, 'rrr' as поле2 from table;этого достаточно чтоб отладит код. а специалист по субд может отладить хранимку(добавив к имени префикс)

И как быть, если в базе что-то поменялось (например, таблица переименована кем-то), а хранимку не открывал? Или переименование таблицы реплицируется на все базы всех разработчиков и не только таблицы, но и её использование в хранимках? IDE для той же Java начнёт ругаться об ошибках с тем что-то не так вызывается, как только получит код, а не дожидаясь его закрытия или, тем более, запуска.

Как минимум нужно синхронизировать параметры и результат. Переименовали столбец (или что там) av в хранимке, нужно переименовать его и в Java коде.ничего подобного делать не надо, достаточно использование алиас (as ) и всё. у вас в коде будет постоянное имя поля.

И как быть, если в базе что-то поменялось (например, таблица переименована кем-то), а хранимку не открывал?я говорю о ide dbFogre (Devart, у этой фирмы есть ide для популярных субд) при переименовывании возникает вопрос о применении рефакторига — и изменения вносятся во все места где встречается место для смены имени таблицы, хранимки, вью, функции, использование as избавит от смены имен полей в коде.

можно использовать каждому свой экземпляр базы, и по завершению работы над куском задачи сливать в «общую».

этот процесс наглядный, простой, удобный…

при сливании показываются все отличия, так что сделать ошибку трудно.

хранимки поддерживают комметарии в коде.

больше напоминает какую-то крутую админку к базе,не просто крутую, а ОЧЕНЬ КРУТУЮ да, это не инструмент разработки приложений, а инструмент разработки запросов, функций, вьюшек, хранимок. Инструмент полноценной работы с базой

Слияние баз, о котором вы говорите — это генерация нового дампа, в котором можно посмотреть отличия с предыдущим, генерация скрипта миграции или реальное слияние, типа подключились с дев-машины к проду и запустили синхронизацию локальной базы с продуктовой?это всё в одном. Есть два пункта «слияния» -для структуры и для данных. как результат — генерируется скрип, который можно посмотреть, а можно и запустить.

подключаете ide к проду и к свой базе, сливаете необходимые данные и тестируете у себя на реальных данных.

можно делать «резервную копию» — я так резервировал базу с клиента — 14гиг в зипе.

все запросы можно строить в гуи,

не идеальный, но отличный редактор для написания, с подстановкой, подсветкой кода, есть форматирование кода.

есть «проводник» в котором перечислены все элементы, можете выбрать таблицу и увидите что от неё зависит, выбираете хранимку и видите от чего она зависит.

наверно единственно чего не хватает — это работы с гит, но у них есть глосовалка и этот пункт набирает голоса.

Ребята активно развивают продукт, активно откликаются на замеченные баги.

Так вот, BigDflz прав (а вы все же зря спорите) в той части, что он про tool for database — это вполне можно назвать «IDE для базы данных» либо «сильно крутая админка».

Да, весь функционал по работе с БД присутствует.

www.jetbrains.com/datagrip/features

P.S. Конечно, BigDflz вел речь о «другом» продукте, но они из одной ниши.

P.P.S. Про саму концепцию «как писать» — я вмешиваться не хочу… у меня лично позиция, как и у вас, но BigDlfz я так же понимаю.

Всему свое место )))

Можно ведь делать в пару кликов выгрузку того же ddl и «в базу» лить скрипт. По крайней мере JetBrains гордится своим продуктом (на пустом месте?).

дак вопрос в чём?

в преимуществах работы с хранимками или то что работа с базой «плохо версионированна»?

если у вас текст запроса в коде, то при изменении имени поля в базе, разве не надо искать все вхождения этого поля по всем файлам проекта? Тогда как инструмент рефакторинга в IDE это сделает во всех хранимках, а чтоб не копаться в коде достаточно использовать алиасы в коде хранимке.

Повторюсь несколько. Я использую все обращения к базе через хранимки, в запросах(которые в хранимках, я использую алиасы, это позволяет избежать зависимости от названия полей, таблиц в коде основного софта. если кто-то внешний изменит имя поля, в IDE есть рефакторинг, который найдёт все использованные имена и предоставит возможность их переименовать и сделает это автоматом в всей базе. в коде все останется по прежнему. Это как бы «подобие json» для обмена данными между базой и кодом. Чего нет при использовании запросов написанных в коде софта. когда я занимаюсь отладкой хранимки (в большинстве случаев — это простой селект) я правлю только текст хранимки и проверяю его работу, какие данные он выводит, как работает, смотрю план запроса. Это происходит быстро. Код софта при этом не трогается. Я могу проверить как работает код сделав хранимку-заглушку. Отладив хранимку(запрос в ней) проверяю как работает всё вместе и код и выборка данных. Ни каких 100+ вариантов хранимки мне не нужно. в хранимке можно комментировать любой фрагмент, в любом месте.

если надо хранить варианты, для этого есть команда продублировать. и в базе будет сделана копия элемента(хранимки, вью...)

для нормальной разработки лучше иметь у каждого свой экземпляр. базы.

Обычно использование хранимок воспринимают как перенос бизнес-логики в базу, но это не всегда так, хранимки — это разделение работы.

Вы написали вызов хранимки, перечень параметров, список возвращаемых полей, и этого достаточно что специально обученный DBA сделал оптимальный вариант обработки данных. Чего нельзя сделать при написании кода запроса в основном коде. DBA делает своё дело — вы своё. Это как разделение фронт-енд — бэк-енд, только добавляется бэйз-енд.

P.S. я как раз фронт и бэк не разграничиваю строго, даже если они в разных репах лежат.

Я знаю контору в которой в одном проекте 900+ хранимок mssql, и все работает, развивается.

900+ хранимок — это проект уровня гостевой книги по размерам, такой можно разрабатывать как угодно и на чем угодно, проблем не возникнет.

Что если хранимок будет 900+ сотен?

Что если хранимок будет 900+ сотен?тут уже нет разницы 900 или 900 сотен, они не запариваются над их количеством. только и всего.

тут уже нет разницы 900 или 900 сотен, они не запариваются над их количеством. только и всего.

То есть проект не поддерживается? Написали и выкинули?

проекту уже более 10 лет.

900 хранимок за 10 лет? То есть, по сути хранимки в проекте практически не используются?

То есть, по сути хранимки в проекте практически не используются?Придирки не приветствуются! Если вы думаете, что за 10 лет только добавляются — значит вы не поддерживали проект длительное время, как правило большая часть подвержена изменениям, причём очень частым — требования и законы меняются постояноо. и добавление не столь сложная задача как изменение существующего.

```sql

PROCEDURE simpleproc (OUT param1 INT) BEGIN

SELECT COUNT(*) INTO param1 FROM t;

END

```

и какой-то вотчер, который любые изменения в этом файле «маппил» бы на базу, сам анализируя, какую команд(ы) конкретно запускать, например DROP при удалении файла и CREATE при создании. Ну и все прелести современной разработки типа навигации по именам, автозаполнения, обнаружения ошибок без обращения к базе и т. п. Чтобы поднимать базу мне приходилось только для тестов (так же в файлах лежащих) и отладки, а код мог спокойно писать без базы.

У меня нет ваших проблем, ваших страхов, я использую хранимые процедуры по-полной и наслаждаюсь их возможностями.

Не нравится — не ешь, но зачем кричать, что это не вкусно?

В целом зависит от задачи. И ОРМ придумали как раз для упрощения и увеличения продуктивности.

Конкретно по триггерам: blog.kloud.com.au/2018/01/30/cosmos-db-server-side-programming-with-typescript-part-4-triggers

А можете привести пример триггера в какой-нибудь СУБДДа мы уже поняли что вы обожаете триггеры в бд и везде их пытаетесь сувать, не думаю что это характеризует вас как «Senior developer»

могу попробовать уйти в управление

Вы знаете, то о чем Вы написали и есть путь в управление.ИТ Архитектор это и есть профессиональный дилетант.Знающий много технологий и "прокладывающий путь" проекту.

Конечно, если архитектор делает фичи сам а не делегирует их более узкоспециализированным разработчикам,- может получится лажа.Архитектор строительный я думаю тоже может заштукатурить стену… но профессиональный штукатур сделает это лучше. Но штукатур не сможет быть архитектором.

Только в крупных проектах есть и прораб и архитектор, в небольших все таки стараются совмещать (оттуда ноги и растут). И это не только в IT

Мне нравится разделение по уровню ответственности:

Джуниор — тот, кого нельзя оставить без присмотра. Задачу надо разжевать, код придирчиво отревьюить, время от времени узнавать, как дела и поправлять на ходу. Выхлопа от работы джуна ожидать не стоит (т.е. времени он не сэкономит, скорее потратит), но на него можно сгрузить рутину и через некоторое время он подтянется и выхлоп будет.

Миддл — работает работу сам. В задачах тоже разбирается сам, где не может, сам задаёт релевантные вопросы. Кроме ревью кода пригляда за ним не требуется, но и помощи в определении курса тоже не ожидается.

Сеньёр — автономная боевая единица. Если в него кинуть размытой формулировкой проекта, то он её сам уточнит, ещё и укажет на слабые места и покритикует, подберёт рабочий стек технологий (без оглядки на хайп) и сам в одиночку всё запрограммирует (и за джунами присмотрит). Ещё и заказчика пнёт (возможно, через прокладку-менеджера, если таковая зачем-то есть), что тот ему ещё вчера обещал уточнения к ТЗ прислать.

Насчёт «бизнесу нужны фуллстеки» — здесь есть нюанс. Бизнес разный бывает. И именно фуллстеки нужны обычно там, где человек по факту занимает несколько вакансий. То есть, в небольшом бизнесе или в стартапах. Не говорю, что там работать это плохо — это тоже может быть интересно, в особенности на начальных этапах, когда ты только познаёшь, чем хочешь заниматься.

Но если бизнес большой, а продукт сложный — здесь нужны достаточно узкие специалисты. И, к сожалению, просто нельзя одновременно быть сениор разработчиком фронта, бэка, мобилки, девопсом и архитектором СУБД (у меня был такой опыт, но я не могу покривить душой и сказать, что я был хотя бы миддлом сразу во всех областях сразу). Просто потому что технологии сейчас развиваются с большей скоростью, чем человек может их освоить. Опять же, «освоить» это не значит «прочитать анонсы». Это значит — попробовать вживую. Да, можно хорошо разбираться в 2-3 технологиях, но дальше начинается деградация знаний, и ты действительно становишься универсальным миддлом. Я от этого в какой-то момент устал и ушёл. И очень доволен таким решением.

Хотя я не говорю, что соседние стеки знать не нужно. Я считаю, что сениор должен обладать как минимум полноценным пониманием взаимодействия компонентов своего продукта и умением его отладки — хотя бы чтобы знать, где возникают проблемы, а не вопить, что они «на другом конце». Но понимать тонкости — уже излишне и слишком трудоёмко. Нужно честно признать, что ты развиваешься в конкретном направлении, а в остальных ты в лучшем случае миддл. Затем принять это и не комплексовать. Всегда найдутся люди, которые в чём-то разбираются лучше — поэтому мы и работаем не в одиночку, а командой.

У нас узкая специализация. Один пришивает карман, один - проймочку, я лично пришиваю пуговицы. К пуговицам претензии есть? И они — не портные, они — подмастерья.Узкие специалисты нужны редко и ненадолго. Если нужен человек по конкретному интерфейсу SoС — его можно позвать на конкретную задачу. А нужны именно full-stack — спроектировать схему, развести её, спаять, отладить электрически, запустить SoC, потом RTOS, потом приложение.

Это должна быть очень крупная фирма, чтобы позволить себе держать специалиста по RS-485 или RS-232. И очень много разных платформ, чтобы у него был фронт работы.

Ну и потом, узкий специалист не может нормально отлаживаться. Ио работу кода мы отлаживаем осциллографом, а проблемы в железе ищем кодом.

Так что сеньор — это full stack, а «мастера по пришивке пуговиц» — джуны. Для того и было придумано разделение труда и узкая специализация — чтобы заменить десяток сеньоров сотней джунов.

А ещё у меня сложилось предвзятое мнение, что чем лучше человек понимает схемотехнику и внутренности МК, тем хуже у него код для этих самых МК

Хуже — это по каким параметрам? По количеству ошибок, по читаемости, по стабильности кода за 10 лет? Когда у вас для отладки только светодиод и осциллограф — есть смысл писать надежно и просто. То есть весьма-весьма дубово. Но это достоинство, а не недостаток.

Хуже — по поддерживаемости. В основном я видел спагетти код. При этом после двухмесячного перерыва в работе автор кода не мог понять что, как работает. SOLID, DDD, что это такое?

Если код надёжный и просто — то это замечательно, вот только для меня простота — это не отсутствие работы с указателями или каких-то хитрых вещей, а возможность прочитать совершенно незнакомый код и понять, как он работает. И в этом как раз помогает и SOLID, и другие идеи.

А на стороне софта… у RS-485 есть терминаторные резисторы. Ну как настраивает резисторы обычный программист? Посмотрел осциллографом, поставил — и тест на сутки. Если больше одного сбойного байта за сутки — менять номинал. А узкий специалист сразу ставит нужный резистор.

SOLID — это все-таки С++. Простой и читаемый код — это обычный Си, близкий к ассемблеру. См. драйвера linux — они довольно хорошо написаны.

P.S. У нас в конторе есть всего один узкий специалист — это технический писатель по ГОСТ.

Зачем вы в каждое обсуждение пихаете свою предметную область с отсылкой к "а у нас вот так, и поэтому весь мир должен думать так же"?

BTW, SOLID — это не про С++ и принципы можно и нужно использовать и в не ОО-языках тоже.

А про SOLID в не ОО-языках — расскажите или ссылку дайте.

Все принципы, кроме подстановки Лисков можно применять к процедурным и функциональным языкам, просто надо думать в чуть более широком смысле. Например, SRP — функция должна иметь конкретную зону ответственности. Interface segregation — подразумеваем интерфейс в широком смысле, не ключевое слово, а API. И так далее.

Принцип подставки Лисков говорит об отношениях между типами и подтипами, как это вы его используете в Си?

onexit — это обычные коллбеки.

Очевидные вещи:

1) очевидны не всем;

2) очевидны по-разному;

Что и демонстрирует ваше непонимание очевидных другим вещей.

Функции, которые используют базовый тип, должны иметь возможность использовать подтипы базового типа, не зная об этом.

Вот на callback и на weak-функциях оно и делается. Базовый тип — вывести информацию Специализации — вывести на RS32, на RS32 через ПЛИС, на CAN, на MIL-STD-1443b…

onexit — как раз нормальный пример. Базовый тип — выполнить финализацию. А специфические подтипы делают конкретные вещи.

В принципе группа weak-функций или callback дает вполне функциональную замену ООП. Даже с наследованием (можно выставить свою функцию на callback и в ней вызвать то, что было на callback раньше.

Короче вы спорите со мной непонятно о чём. Если вы сделали в Си псевдо-наследование — честь вам и хвала. И это даже больше подтверждает моё утверждение. Если вам просто хочется поговорить, так и скажите, а не прыгайте с темы на тему.

JFYI, постоянные упоминания деталей ваших реализаций не делает вас круче, равно как и не даёт дополнительной информации собеседнику.

Инженер: Если работает так как надо, то дальнейшие улучшения не требуются.

Программист: Если результат не оптимален, то не будет работать как надо.

У первого цель — рабочая программа.

Цель второго — не ломающаяся программа.

Другое дело когда проект большой, сложный и массовый. Вот у меня сейчас проект — это кодовая база на несколько миллионов строк для МК и сотни людей. Попробуйте это поотлаживать светодиодом и осциллографом. Поэтому тут и SOLID, и юнит тесты, и blackbox тесты, Software-In-the-Loop, Hardware-In-the-Loop, Continuous Integration и т.д. Скажи такие слова человеку из мира железа, он и не поймет что это.

Все-таки разделение труда — это главное достижение человечества.

Разделение труда (в пределе — конвейер) придумано, чтобы привлечь к работе низкоквалифицированный персонал. Брукс хорошо доказал, что увеличение численности не ускоряет разработку (если 9 беременных женщин собрать вместе, ребенок через месяц не родится), наоборот, в его конкретном случае, увеличение численности в 10 раз разработку замедлило.

Поэтому вопрос в экономике. Нужна эффективность производства — делаете конвейер с сотней программистов. Нужно качество — обходитесь всего несколькими сеньорами.

несколько миллионов строк для МК и сотни людей. Попробуйте это поотлаживать светодиодом и осциллографом.Поржал. Зачем это отлаживать на МК? Разработка и отладка 99.9% идет на windows. Да, приходится делать имитаторы и писать переносимый код. Но на windows отлаживается все, кроме очень специфичного для МК кода. Потом перенос на linux, потом — на МК.

У меня был проект с доступным временем на отладку на реальном стане — 2 часа в месяц (130 тысяч строк кода). Ничего, справился без отладки.

Software-In-the-Loop, Hardware-In-the-Loop, Continuous Integration и т.д. Скажи такие слова человеку из мира железа, он и не поймет что это.Ну и я таких терминов как SIL и HIL не знал. Но мы их применяли почти 20 лет назад. Как-то не сложно было независимо их изобрести.

Так вот этот товарищ усиленно не хотел разбираться в том, чем будет управлять програмирумый им ПЛК и как этот ПЛК, собственно, функционирует. Типа, мое дело писать код, ваше дело предоставить мне алгоритмы и заставить железо работать, либо алгоритмы вытрясайте у технологов.

И вот настал тот последний проект, который мне в той фирме посчасливилось доводить до конца, от конструкторской документации и почти до пусконаладки. Система ответственная, для нефтехимпрома, контроллеры отказоустойчивые, вероятность отказа 0.(0)1%. Нарисовал схемы, собрали шкафы на сборочном участке, собрали стендики-эмуляторы сигналов, закупили калибратор за бешенные бабки для настройки аналоговых каналов. Начался этап тестирования софта, я подаю сигнал 4...20 мА, имитируя работу датчика, программист смотрит, что пришло, подгоняет единицы измерения — ток в паскали, мм, кубометры и прочее. Подаю я, значится, сигнал, яжпрограммист ждет, что там будет уровень в емкости 1 метр, а уровень то скачет немного, шумит младшими битами 12-битный АЦП в ПЛК. И тут возникает «шум АЦП» со стороны яжпрограммиста: ты что это, подлец и диверсант, делаешь, я ж прошу выставить уровень в емкости 1 м, а ты какого рожна выставляешь то 0.99, то 1.01 м, ты мне вынь да положь 1.000м, как я с буду программу отстраивать на работу с такими данными? Чуть я заикнуля про необходимость фильтрации, аппартаной или программной, как «шум АЦП» начал усиливаться, что это я лезу не в свое дело, мое дело должно быть маленькое, обеспечить нормальное функционирование техники, а не учить программистов работать, что это за препирания с начальством, да и вообще таким специалистам тут не место.

1. В ТЗ учесть всех нюансов невозможно, много интересных моментов вылазит на следующих этапах, а ТЗ уже утверждено заказчиком и переделке не подлежит.

2. ТЗ пишется исполнителем (да, те самые отделы технических и программных средств), поэтому относятся к нему, как к формальности — отдельному пункту бюджета поекта. Таким образом, утвержденное заказчиком ТЗ является, прежде всего, документом, который в дальнейшем отсеивает необоснованные притязания заказчика к исполнителю по функциям и задачам системы. И уж во вторую очереди исполнитель обращается к собственноручно составленному ТЗ, чтобы посмортеть, а как же на самом деле надо реализовать ту или иную вещь. Возможно, в других отраслях заказчик приходит к исполнителю с готовым ТЗ, но у нас все наоборот.

3. Фильтрация сигналов таки была прописана, это стандартный шаблонный пункт (да, мы используем предыдущие наработки в дальнеших проектах, не пишем «код» каждый раз с нуля).

4. В модулях AI фильтр встроенный есть, на этапе работы с железом (в момент испытаний же!) стало ясно, что его возможности не удоволетворяют требованиям точности. Если железячники о причинах проблемы догадались сразу и тут же предложили метод решения, то яжпрограммист пошел по пути наименьшего сопротивления. Зачем создавать себе работу, если можно свалить проблемы на соседний отдел?

Да черт с ним, с АЦП, это одна из историй, создавшая проблемы ровно на 2 рабочих дня, с учетом совещания у начальства (любую незначительную проблему выноси на повестку дня на планерке — n-ое правило ватокатства).

Еще одна история из этого же проекта. Алгоритмы, по которым должна функционировать система, разрабатывались в одном ЭнскГИПроКакойтотампромышленности, разрабатывались в виде, так сказать функциональных диаграмм (дикая смесь FBD и LAD), но в отрыве от соответствующих стандартов. Возможно, авторы листали лет 30 назад справочную литературу по Ремиконтам. Ну не суть, в принципах работы создаваемой системы разобраться можно — что контролировать, что, когда и с какими задержками и блокировками включать. На изучение этой документации техотдел потратил 2 месяца, и потом все на пальцах объяснил программистам, описав алгоритмы в текстовом виде, заодно нашел множество нестыковок, косяков и прочего. Но, в ходе общения с Заказчиком, представителями ЭнскГИПроКакойтотампромышленности пришли к заключению, что «проект уже давно утвержден (лет 6 назад как), переделывать его никто не будет, это деньги и время, делайте как есть, на месте разберемся». ОК, раз есть такой приказ, яжпрограммист использует алгоритмы как руководство к действию, пишет программу.

Тут поджидает засада. Проектировщики алгоритма знать не знали о стандартах IEC, о том, какие контроллеры будут использваться, какие там есть билиотечные функции. Напоминаю, что в IEC имеются таймеры, типа TON, TOF, TP. Проектировщики алгоритма предполагали одно поведение таймера, стандарт предполагает другое поведение. Яжпрограммист реализует структуру программы в точном соответствии с алгоритмом (проект же утвержден, что я буду отходить от него?), в итоге программа не работает. ОК, копья ломаются, АЦП шумит, проблема решается не без крови (потребовалось добавить к таймеру дополнительно RS-триггер, но в алгоритмах, хоть и предполагается такое поведение, явно это не указано!).

Поехали дальше, следующая засада. Используются ПЛК двух типов, стандартные, для неответственной системы РСУ, и Safety для системы ПАЗ. Если стандартные контроллеры имеют широкую библиотеку функций, то Safety не дадут вам выстрелить в ногу, даже если очень нужно, поэтому библиотека функций урезана по самое небалуй. Проектировщики алгоритма этих тонкостей учесть не могли, т.к. им все равно, на каком железе это все будет работать. Программист об этом знает, но алгоритмы же утверждены! Итог? Опять неработающая программа.

И все это в условиях вяло текущего дедлайна, со спецификой особо опасного производства, где любое нарушение технологии — катастрофа.

Как ни странно, в российских реалиях обычно называют фуллстаком не того человека, который полностью знает один некий стек от фронта до бэкенда — а того, кто знает несколько стеков.

А насчёт необходимости узких специалистов «редко и ненадолго» — это просто неправда с потолка.

Где-то ненадолго нужен администратор Oracle 11g? Или, может, Java разработчик? Может, SQL аналитиков нанимают на месяц? Или где-то ищут одноразовых специалистов по машинному обучению?

«A Full-Stack Web Developer is someone who is able to work on both the front-end and back-end portions of an application»

Фулстэк — это тот, кто может работать как над бэкэндом так и над фронтэндом. Просто сейчас масса разработчиков, которые могут только angular, или только мобильные формы лепить, или только сервисы пишут последние 20 лет. Проблема с такими разработчиками, что комманду из таких невозможно нормально нагрузить работой. Всегда кто-то простаивает.

отладить электрически, запустить SoC, потом RTOS, потом приложение.

Вполне допускаю, что у вас не так, но из моего личного опыта разработчики такого широкого спектра «и железо и программы и жнец и на дуде игрец» пишут такой отвратительный код, что жалко глаза. Наблюдается какой-то поразительный шовинизм вида «мы тут Железку создали, что там какой-то код», из чего следует некоторая узость взглядов в сфере разработки ПО и отвратительный нечитаемый и неподдерживаемый код.

Я полагаю, схемы, сделанные программистами, тоже не без недостатков :)

Разумеется. Так о том и речь, что универсальная вещь делает всё, но делает всё хуже, чем специализированные по отдельности. Так и со специалистами — к вопросу о fullstack.

Конкретно с «железячниками» не раз сталкивался с отношением к вопросу — см. выше — «мы сделали железку, это 99% успеха, осталось только программку накидать, это фигня, за вечер управимся». Получается так себе. Лучше, конечно, чем если наоборот — написать программу, а потом «за вечер» накидать плату, но тем не менее. Т.е. здесь раз за разом встречаю отношение к программированию, как к игровой области, где нет никаких профессиональных стандартов, неважен опыт и навык, нет технологий разработки и этим может заниматься каждый с улицы. Да, порог вхождения, пожалуй, ниже, чем в «железо», но проблема остается.

Например, тут вон недавно механический map-reduce на перфокартах пролетал…

А уж багаж знаний творит и вовсе чудеса).

Программиста может погубить только возрастная болезнь мозга, все остальное трудно но преодолимо (даже отстуствие зрения к примеру =) )

Нормальный бэкендер знает и свой язык и SQL, и не сделает указанной вами ошибки.

Нормальный фронтендер не затащит на фронт то, что нужно делать на бэке.

Плохой разработчик сделает и то и то и другое вне зависимости от того, узкий он специалист или fullstack.

Нормальный бэкендер знает и свой язык и SQL, и не сделает указанной вами ошибки.Ключевое слово — Нормальный. Но таких ужасающе мало, и к сожалению, я таких не встречал. Хотя в своей «частной» области сеньёры…

Да и в своей области не всегда красиво выглядят. Есть примеры когда ругают код, а предлагают такое, что добавляет и кучу кода и время выполнения. Как яркий пример использование шаблонизации — да, чисто внешне вроде красиво, как копнёшь… нужно сделать то, сё, пятое, десятое… а в итоге за всем этим скрыто простое построение строки, которое можно сделать просто и наглядно в в несколько строк кода, а не в нескольких файлах. и будет работать а разы быстрее.

Если код работает, отвечает функциональным требованиям к системе — он уже не фигня объективно.

как правило один код может отличаться от другого на не большое время работы — но таких кусков кода может быть много — в итоге система может либо тормозить, либо быстро работать — выбор за тобой

Порой вполне оправданно. То что в бд делается через 9 джойнов на коде бэка можно сделать простым кодом — намного дешевле и по времени выполнения и по оперативке, даже на не самом быстром яп бэка.

Другой пример — когда для улучшения скорости бэк хранит часть данных базы в своих структурах данных чтобы не бегать в нее за каждым чихом. Очень важно если нам нужно отвечать на запросы не медленнее икс миллисекунд. В этом случае кстати бэк плюсовым.

Есть еще нюанс. Да, на стороне sql многое делается сильно проще и эффективнее (даже, когда надо 9 джойнов, то почему бы не задействовать кеши СУБД с отполированным годами кодом, написанным суровыми системными программистами вместо своих велосипедов, к тому же, можно materialized view или триггеры и поддержание +1 таблицы устроить).

Проблема как правило лежит в другой плоскости. Код бека легко покрыть тестами, он будет в рамках паттернов и ооп, он версионируется без костылей, он не требует миграционных скриптов, его проще переиспользовать. Кроме того, вариант "одна субд с мин нагрузкой + куча стейтлес воркеров" идеально масштабируется. Версии воркеров тоже можно обновлять нода за нодой. Также, если речь идет о лицензионном mssql/oracle, которые лицензиуются за ядра cpu, то может быть дешевле нагрузить 3 ядра на сервис хосте, чем одно на машине с субд;)

С другой стороны если грамотно построить структуру субд, грамотно написать запросы/хранимки — может и не потребоваться масштабируемость.

Это ведь один из достаточно логичных постулатов: работу с данными следует производить как можно ближе к данным. Именно поэтому в т.н. BigData описание вычисления присылают в хранилище данных, а не данные из хранилища присылают исполнителю вычисления.

Разве что в описанном случае запрос вышел очень неоптимальный, но при этом с крайне низкой кардинальностью по данным в итоге. Тогда да, обработка в лоб действительно может быть быстрее. С другой стороны, уверен, что перестроенный и оптимизированный запрос всё равно выиграет.

Это ведь один из достаточно логичных постулатов: работу с данными следует производить как можно ближе к данным.

Это больше на демагогический постулат походит. Ну или на "кодерско-оптимизаторский" (хотя не факт, что на практике будет быстрее, если СУБД у нас толком не масштабируется, а апп-серверы сотнями можно поднимать). Инженерный подход подразумевает не только техническое, но и экономическое обоснование.

hadoop.apache.org/docs/r1.2.1/hdfs_design.html

Уж поверьте, как кодер я был бы только рад унести логику обработки данных из «холодной, безразличной» и требующей многословных запросов базы данных (где, например, попытки переиспользовать код обычно натыкаются на ощутимые тормоза ввиду переключения контекстов между SQL и PL) в уютный для меня любимый язык программирования. Но сетевой доступ к хранилищу не может происходить по путям бесконечной ёмкости, а значит, чем больше работы я сделал вдали от данных, тем больше данных было передано по сети. А это вещь ненадёжная и медленная.

Я не исключаю что в каких-то системах такой подход может не работать и сервер базы загружен на 98%, но с другой стороны, если мы можем поднять сотню аппсерверов (для чего, кстати? вручную делать join'ы и закат солнца до кучи?), то почему мы не можем поднять «клон» для чтения, к примеру? Или поделить данные между несколькими базами, для начала, а склеивать уже результат от полученный от одинакового запроса к разным базам?

Никакая не демагогия, вот отсюда беру, обратите внимание на пункт “Moving Computation is Cheaper than Moving Data”:

Там же никакой аргументации не приведено. Точно так же можно заявить, что лучше данные обрабатывать там, где они будут непосредственно использоваться, т.к. тогда мы сэкономим на передаче данных к клиенту.

Пример: рендер изображения в сетевой игре происходит на клиенте, а не на сервере

Плохой пример: если изображение это данные, то их совершенно правильно не передают с сервера, вместо этого клиенту передаётся описание вычислений, необходимых для получения правильных данных (поток событий в матче).

С другой стороны, в ММО, опять, же не передают все данные из базы на клиента, дабы клиент сам определился, какие из них ему действительно нужны и сделал необходимые вычисления. Переводя на язык СУБД, в таком случае вся фильтрация и join'ы произведены на сервере (в базе данных), клиенту приходит только проекция. Когда такая схема нарушается по любой причине, появляется возможность сжульничать — например, убрать «туман войны» в стратегии (применимо только для стратегий с сервером-арбитром правда, обойтись без дупликатов данных в P2P играх, насколько я знаю, пока не получалось ни у кого).

Так мы вроде и обсуждаем здесь случай, когда данных много? Иначе зачем для их хранения нужна база данных? Малые объёмы можно держать и в оперативной памяти где-нибудь.

А ваше «был бы только рад» намекает на то

… что я уже взвешивал несколько раз возможность "вытянуть всё и на месте разобраться в коде". И ни разу это не оказалось приемлемой стратегией. Более того — несколько раз мне приходилось такие подходы из кода вычищать калёным железом, так как в раунде PSR-тестирования выявлялось сильное падение отзывчивости системы, и причиной были именно, закаты солнца вручную на сервере вместо написания нормального запроса в базу данных.

В исходной формулировке с уточнениями, правда, выходит, что запрос «хавал» очень много ресурсов сервера БД, а малое количество данных так не делает.

Кстати, в C# запросы к данным в памяти и к данным в БД могут строиться одинаково и декларативно (см. linq).

Кстати, в порядке просвещения меня: может ли LINQ сделать такую отдельную загрузку для малых таблиц и потом использовать эти таблицы в проекциях без настоящего join'a на стороне БД? Хотя бы в теории?

Даже если они часть предиката, все равно варианты "подключить, проверить и забыть" и "подключить, проверить и запомнить" дают разные требования к памяти. Пренебречь им нельзя, потому что это целый дополнительный столбец в результатах запроса.

Кстати, в порядке просвещения меня: может ли LINQ сделать такую отдельную загрузку для малых таблиц и потом использовать эти таблицы в проекциях без настоящего join'a на стороне БД? Хотя бы в теории?

LINQ такого не может, ибо это всего лишь язык запросов. А вот Entity Framework нечто подобное умеет, если пару хелперов написать. Вот изменения трехнедельной давности (полсекунды выиграл, однако):

public static void AttachFromCache<T>(

this DbContext ctx,

IEntityCacheService cache

) where T : class

{

var set = ctx.Set<T>();

foreach (var item in cache.GetAllItems<T>())

{

set.Attach(item);

}

}Пренебречь им нельзя

Ну почему так категорично. Предикация и проекция — две операции, которые не так чтобы близко были связаны между собой. Для малых кардинальностей, логически, есть возможность оптимизировать запрос так, чтобы этот столбец был "Ленивым" и вычислялся вообще прямо перед "Show" каждой строки (в последний момент), что будет ценно как раз при ограничении по памяти, т.к. позволяет при вообще не хранить в столбце значения — только "рецепт" и кеш-таблицу. Оптимизация менее применима при наличии сортировки по такому столбцу, но не снимается полностью даже в этом случае.

Про LINQ: Там в картинке явно указывается в тексте запроса, что, что некие сущности следует брать из кеша.

Не то чтоб это было плохо само по себе, но требует телодвижений в каждом use-site. Впрочем, принципиальную возможность это уже доказывает, следовательно, где-то должен быть способ то же самое делать более централизованно. Благодарю за просвещение.

Это типичная ситуация когда в тяжелом запросе есть джойны с кучкой мелких справочников.такие справочники кэшируются в субд и подключаются результирующему select в самом конце. и нет никакой необходимости их загружать в код. Правильное написание селекта только и всего.

Вот и есть ответ на все претензии к работе с базой — прогер не может правильно записать/переписать select. Происходит попытка заменить возможности субд своим кодом, который явно не может быть лучше чем код обрабатывающий запрос в субд.

Что займет меньше места: 100 записей вида «число+строка» и 10000 чисел — или 10000 записей вида «число+строка»?

То, что запрос возвращает только нужные данные, еще не означает что они не дублируются.Странное утверждение — если требуется — будут и дубли, не требуется — дубли убираются — в селекте за это отвечает 1 слово.

А меньше займу место правильно выбранные данные. Зачем отправлять 10000 чисел? когда можно сформировать запрос, чтоб он вернул 100…

У меня справочник наименований товара содержит 100 000 наименований — по-вашему я должен все эти наименования держать в памяти? чтоб вывести накладную из 20 позиций…

Да вы можете сэкономить(только что сэкономить?) и держать в памяти этот справочник, и при формировании чего-либо для отправки клиенту подставить из мапы/листа/хэша, но это ни есть экономия ни памяти, ни времени работы. При подстановке нужны множественные обращения к этому хранилищу справочника, это код, это время…

и Ещё вопрос Запрос возвращающий 10 000 записей — это не правильно поставленная задача, соответственно и решение не верное. Если вы хотите отправить все 10 000 клиенту и чтоб он их сортировал, фильтровал — если вы так делаете…

это не означает дублирование записи, это только то, что некоторые поля имеют одинаковое значение

Один фиг если не пересылать по сети одинаковые значения — будет сэкономлена пропускная способность. Или вы и в это не верите?

но вы должны вернуть id этого значения, чтоб потом вывести юзеру не id а само наименование, а эти id также будут «дублироваться», если следовать вашему утверждению

id занимает намного меньше байт

У меня справочник наименований товара содержит 100 000 наименований — по-вашему я должен все эти наименования держать в памяти?

Я выше уже писал, что для разных объемов данных оптимальные решения — различные. У нас тот справочник о котором идет речь содержит меньше сотни записей и никогда не будет сильно расти.

Да вы можете сэкономить(только что сэкономить?) и держать в памяти этот справочник, и при формировании чего-либо для отправки клиенту подставить из мапы/листа/хэша, но это ни есть экономия ни памяти, ни времени работы. При подстановке нужны множественные обращения к этому хранилищу справочника, это код, это время…

Ну, вообще-то, у меня почему-то экономится и память, и время работы. Возможно, вы просто не умеете писать код.

и Ещё вопрос Запрос возвращающий 10 000 записей — это не правильно поставленная задача, соответственно и решение не верное. Если вы хотите отправить все 10 000 клиенту и чтоб он их сортировал, фильтровал — если вы так делаете…

Если дофига задач где требуются большие выборки. Как пример — экспорт данных или ETL. Если вы не только ни разу с ними не сталкивались, но и представить себе их не можете — вы не такой опытный админ СУБД как пытаетесь показаться.

Один фиг если не пересылать по сети одинаковые значения — будет сэкономлена пропускная способность. Или вы и в это не верите?пропускная способность гигабитной локальной сети?

Ну, вообще-то, у меня почему-то экономится и память, и время работы. Возможно, вы просто не умеете писать код.а у меня просто нет необходимости экономить — просто не требуется память.

Если дофига задач где требуются большие выборки. Как пример — экспорт данных или ETL. Если вы не только ни разу с ними не сталкивались, но и представить себе их не можете — вы не такой опытный админ СУБД как пытаетесь показаться.Согласен, но ваши же слова Я выше уже писал, что для разных объемов данных оптимальные решения — различные.

У нас тот справочник о котором идет речь содержит меньше сотни записей и никогда не будет сильно расти.но подставляя эти значения в коде — вы увеличиваете код. Мелочь, но я просто использую поле, которое мне вернула база — И нету даже этой мелочи, что вас.

та же субд может сделать ETL в нужном формате прямо в файл(при необходимости) или из результсета сразу выгружать по месту и для этого в 99% случаев нет необходимости доп обработки данных. Mssql может даже транспонировать данные… Даже если данных будет 1 000 000 нет необходимости выгружать их в память — субд организует правильную отправку результатов в код.

У меня справочник наименований товара содержит 100 000 наименований — по-вашему я должен все эти наименования держать в памяти?

Хранить 100 000 наименований (или даже 1000 000 наименований) в памяти намного эффективнее, чем каждый раз СУБД дергать.

При правильной настройке субд все нужное кэширует

Если субд что-то закешировало, то вам все равно придется делать запрос, а это обычно использование сети, а использование сети — очень затратная операция. Если ваши данные просто лежат в памяти, то к базе вообще не надо обращаться.

Кроме того, универсальный кеш субд заведомо менее эффективен чем конкретный кеш на клиенте.

Сетевое взаимодействие с базой никогда не будет быстрее прямого обращения к оперативной памяти.с одной стороны да, но с другой субд специально заточена на обработку данных, с использованием кэша, индексов и прочего. и ваша попытка эмулировать работу базы очень проигрывает.

база ищет по индексам — для этого у неё есть специальные таблицы, специальные механизмы, алгоритмы. в вашем же распоряжении мапы/хеши, они явно уступают методам баз.

использование сети — очень затратная операция.это было актуально в начале 90-х когда сеть была на BNCконнекторах, сейчас уже оптикой никого не удивишь даже в квартиру. у нас предлагают 500мбит во внешний инет, а уж в нормальных конторах локальный трафик есть 10Гбит.

Была статья про .stackoverflow.com как у них всё устроено — куча серверов, и ни одного упоминания про сетевые затраты.

и ещё есть много систем с хорошей памятью и достаточным количеством ядер — и все в одном места и приложение и субд — так вот там нет никаких затрат на сеть все через память.

Если ваши данные просто лежат в памяти, то к базе вообще не надо обращаться.смотря для каких целей. таблицы могут быть по 10+ гиг и вы всё это будете держать в памяти? Ещё раз — даже если у вас нет ограничения на память, то вы все равно не сможете конкурировать с по работе с данными ни с какой субд.

у любого приложения есть драйвер, который поддерживает пул соединений с базой, и любое обращение к базе стоит очень дешево.

Кроме того, универсальный кеш субд заведомо менее эффективен чем конкретный кеш на клиенте.кэш в базе не просто таблица, а также индексы, и поиск данных идет с помощью индексов(при правильной организации данных, их индексирования, правильного составления запроса)

если следовать вашим рекомендациям — для ускорения надо однажды из файла прочитать в память и работать с памятью, и никаких таблиц не надо, и всех разработчиков баз разогнать.

тут www.youtube.com/watch?v=HP1Sa2HtRPM&index=74&list=PLH-XmS0lSi_yn4pCZVOHqWaqQ9trMpyLI&t=5m22s

говорится, что засунуть 2ТБ в память — легко!

* это НЕ против Вашего комментария, а скорее — в дополнение))

я читал про систему, что для выключения которой требовалось 8 часов — всё шло на сохранения на диски…

mayorovp

Вынужден вас расстроить, но все эти «специальные механизмы» БД проигрывают обычной хеш-таблице в памяти.так тогда давайте исключим все субд как тормоз и всё будет летать. и само понятие субд запретим…

так тогда давайте исключим все субд как тормоз и всё будет летать. и само понятие субд запретим…

… и это будет даже правильным решением! При условии что данные неизменяемые и помещаются в оперативную память.

1. СУБД — универсальное решение, применяемое для данных, которые, в общем случае, в оперативную память не влезают;

2. СУБД рассчитаны на длительное и надежное хранение данных, да еще и ACID вынь да полож;

3. разработчики СУБД предполагают, что их решением будут пользоваться тогда, когда простые способы уже не помогают.

Вопрос: почему тогда разработчики субд не используют такое?

индексы как-бы примерно таким образом и работают.

Даже для сохранения в памяти они использую таблицы

Что удивительного в том что реляционная база использует реляции а не что-то другое? В целом нет никакой проблемы хранить данные в jsonb с ключем, будет та же хэшмэпа. Но только если вам прям в памяти нужно дешевле будет redis использовать. Он опять же может только ключи в памяти хранить, если вдруг у вас все в память не помещается.

А ещё разработчики SQL РСУБД активно используют хэш-индексы, которые при полной загрузки в память и индекса и таблицы, как думаете чем являются?

Вынужден вас расстроить, но все эти "специальные механизмы" БД проигрывают обычной хеш-таблице в памяти.

а уж в нормальных конторах локальный трафик есть 10Гбит

Сетевые задержки измеряются в милисекундах, а не в гигабитах

и ещё есть много систем с хорошей памятью и достаточным количеством ядер — и все в одном места и приложение и субд

Прощай, масштабируемость!

Что за механизмы в базе, что уступают получению указателя из хеш-таблицы в памяти процесса?

это было актуально в начале 90-х когда сеть была на BNCконнекторах, сейчас уже оптикой никого не удивишь даже в квартиру

Какая разница оптика или не оптика? Сама отправка запроса по сети уже работает дольше, чем запрос к кешу в памяти.

смотря для каких целей. таблицы могут быть по 10+ гиг и вы всё это будете держать в памяти?

Естественно, речь идет о случаях, когда вы можете себе позволить держать все в памяти.

кэш в базе не просто таблица, а также индексы, и поиск данных идет с помощью индексов(при правильной организации данных, их индексирования, правильного составления запроса)

Именно по-этому кеш бд и является настолько неэффективным.

Именно по-этому кеш бд и является настолько неэффективным.ты об это разрабам mssql, mysql, oracle скажи, научи уму-разуму, а то пишут всякую фигню, обманывают народ…

А ты хоть знаешь для чего индексы нужны?

Какая разница оптика или не оптика? Сама отправка запроса по сети уже работает дольше, чем запрос к кешу в памятиСама жизнь яяляется признаком смерти…

Естественно, речь идет о случаях, когда вы можете себе позволить держать все в памяти.гы-гы-гы

когда твоя «база» — один хэш и все — это твоя область деятельности?

ты об это разрабам mssql, mysql, oracle скажи, научи уму-разуму, а то пишут всякую фигню, обманывают народ…

Они-то в курсе обо всем, им ничего говорить не требуется.

гы-гы-гы

когда твоя «база» — один хэш и все — это твоя область деятельности?

Ну, какбэ выше и обсуждалось, что в таких случаях, когда (… оговорки… и можно делать выборку из памяти) то быстрее не общаться с сервером БД. Вы влетели со своими «разоблачениями» без учета оговорок.

Выборка из памяти — это не работа сданными.

если вы посмотрите планы выполнения запроса — то увидите, на что влияют индексы и во сколько раз они сокращают выборку данных.

и приплетать свои оговорки — это просто не профессионально.

Непрофессионально — не исходить из заданных критериев, чем вы и занялись.

если вы посмотрите планы выполнения запроса — то увидите, на что влияют индексы и во сколько раз они сокращают выборку данных.

Вы опять не учитываете указанные оговорки и спорите сам с собой о чем-то своем. Удачи.

со своей выборкой вы не опередите работу базы со всеми сопутствующими ей затратами.

Конечно же, опередит. Он получит результат еще до того, как ваш запрос до базы дойдет.

Я не об административном, когда решил заказчик или начальник. Собрались разработчики и решили, что c ОРМ проект быстрее запустится и проще его будет поддерживать и развивать. Ну или единственный разработчик, который хоть знает об альтернативах так решил :) А за использование всей мощи СУБД придётся заплатить усложнением поддержки, замедлением (ну или удорожанием) разработки, усложнением развёртывания. Конечно это всё можно обосновать красивыми словами, но с точки зрения кода (а не его эффективности) это глупо :)

За неиспользованием все мощи субд придется заплатить масштабированием

Можети привести пример как вы платите масштабированием за хабирнейт? Хабернейт это всего лишь дополнительная нашлепка, которая помогает замапить данные в объекты. Т.е. если у вас бэкэнд на жаве, с большой вероятностью вам и так придется это делать, а с хабернейтом код просто будет чище.

потому как для него надо много классов/файлов для простого изменения

Ну как бы нет, если у вас много кассов/файлов в изменении, то значит это уже не простое изменение. Т.е. опять если вы мапите результат квери в жава объекты без хабернейта, то изменения в базе спровоцируют изменения в коде, причем изменения как в коде мапинга так и в объектах, а с использованием хабернейта только в объектах.

P.S.

Понятное дело, что за использование универсальной библиотеки вы всегда немного платите производительностью, но если на этом зацикливаться так можно и на с++ все писать. Когда я только начинал с хабернейтом, я тоже от него плевался по началу. Но после того как я в нем разобрался он оказался не так уж и плох.

Для запросов и их результатов ORM подходит куда меньше, хотя бы потому, что не позволит просто так пойти и высчитать среднее, бегущую сумму или какой-нибудь изврат с оконными функциями — а это обычно самые интересные данные с точки зрения заказчика.

bulk import благо не самая распространенная задача. Да и для конкретного кейса можно придумать что-то поинтереснее.

В целом ORM нужны там где у вас OLTP (OnLine Transaction Processing). То есть берем чуть-чуть данных (агрегат, границы бизнес транзакции, DDD), делаем с ними что-то и записываем.

Чтение и т.д. — для этого проще делать отдельно выборки через SQL. Тут не только с точки зрения производительности сколько с той точки зрения, что модели данных для чтения и записи нужны обычно разные.

Собственно вы сами в конце про разделение представлений говорите.

прежде всего избегание vendor lock

то есть мы избегаем лока от одного вендора за счет лока на другого вендора (Надеюсь вы не пишите свои ORM).

Задача ORM не абстракцию от базы вам предоставить, а мэппинг данных организовать, из реляционной модели в ваши in-memory структуры. При этом у вас может быть тотальная завязка на нюансы конкретной СУБД. Дальше все больше про разделение ответственности (изменения персистенса не должны влиять на бизнес логику, но думать что при смене СУБД вам код не придется писать — глупо).

как версионирование и развертывание.

на самом деле нет. Все это тоже можно мигрировать и версионировать, и обратную совместимость схемы между деплоями никто не отменял (потому что вы не можете абсолютно одновременно, без даунтайма выкатить одинаковые версии схемы и кода)

Плюс требуют от разработчика дополнительных компетенций

Если подумать то объем знаний необходимых для работы с каким-нибудь nhibernate сопоставим с объемом знаний для работы с процедурами. Да, это сильно разный опыт, и стоит ориентироваться на рынок труда (а он такой что я ни тот ни другой вариант бы не доверил большинству)

в каких-то весьма высоконагруженных приложениях.

Обычно оправдание — тотальное разделение ответственности и контроль за данными, секьюрити политики и т.д. Производительность — сомнительный довод. Да и процедуры будут ограничивать вас по горизонтали (хотя кто его знает).

p.s. Если что — принципиально не использую процедуры/тригеры для бизнес логики и пока не встречался с юзкейсами где это все дает очевидные преимущества. Но полагаю такие кейсы есть. Не подумайте что я там фанат таких вещей.

но это внешний компонент

Почему? Можно ли воспринимать скажем версию JVM как "внешний компонент"?

У меня вещи типа база данных это внутренний компонент. Я поставляю код как готовую инфраструктуру (предположим через докер). И я регламентирую что нужно для того что бы код работал.

У меня был один кейс когда мне была выгодна смена субд прозрачная — у заказчика был тот самый вендор лок на оракл, и ничего другого они юзать не могли. И выяснилось это через 3 недели посте старта проекта. Но там и проект примитивный.

Так что нет, сегодня завязка на конкретную СУБД это данность на хоть сколько нибудь серьезном проекте.

Вы же не переживаете что выбрав определенный язык программирования вы как бы тоже создали себе вендор лок?

Задача ORM — реализовать слой абстракции в виде хранилища объектов с реляционными отношениями между ними.

Тогда было бы не O/RM (Object-relational mapping) а Object-Relation Abstraction какой. Задача ORM — исключительно мэппинг одного в другое. И при том что две эти модели данных (основанная на реляциях и ваши in memory структуры) сильно различаются, то и мэппинг мы можем сделать в ограниченном наборе сценариев (всему виной такая вещи как референсы, которые выражены сильно по разному)

Хм… я могу одновременно задеплоить разные версии воркеров, которые будут реализовывать разние версии API

это как UI, попробуйте такое с бизнес логикой провернуть. И не важно будет в тригерах она или в коде. Ну либо ваши две версии воркеров должны реализовывать совместимость на уровне бизнес процессов. Что как бы… можно провернуть и с тригерами.

но я не вижу способа задеплоить одновременно несколько разных версий SQL-триггрер.

Я не вижу необходимости в этом. Но вообще зависит от вашей СУБД. В PostgreSQL подобное можно хитро замутить со схемами.

А в чем тут проблемы с ORM? Вовсе не обязательно, чтобы все пользователи ходили к СУБД под одним пользователем.

Это больше про загоны с отслеживанием изменений. Ну знаете, есть задачи в рамках которых изменение одного символа требует проверки со стороны каких-то контролирующих органов. А потому вам хочется вот это что-то очень изолировать от всего дабы менялось пореже и не влияло на циклы релизов.

Такое можно и с кодом провернуть (здрасте микросервисы).

Тот же Highload

Я уже упоминал тут что в хайлоад врядли тригеры и процедуры хорошо ложатся ибо вы ограничиваете себя скейлингом по вертикали. Горизонтальный уже сложнее.

На всякий случай повторю, а то может быть вы не заметили — я НЕ использую тригеры и процедуры для бизнес логики и категорически против этого на своих проектах. Опять же я категорически против так же называть ORM "решением всех проблем", есть и другие способы дела делать.

Чем меньше зафиксированных зависимостей пришлось затащить в проект — тем лучше.

Меня не покидает ощущение что мы говорим о разных вещах. Что бы небыло недопонимания, давайте так.

Вы согласны что зависимость все равно есть? А это значит что мы не можем просто поставить "другую субд" и все будет гарантировано работать, то есть может потребоваться дополнительная работа.

Ну или расскажите про свои проекты. Ибо я не могу вспомнить ни одного проекта где мы гарантировали бы стабильность работы софта при смене скажем postgres на mysql.

У вас вообще нет контроля за окружением? Коробочные решения? Десктоп? Просто это довольно важно понимать, ибо задачи могут быть чуть другие.

Я просто не очень верю в волшебное "зависимости есть но я могу махнуть палочкой и вжух уже имплементация другая". То есть да, изолировать зависимость — понимаю и согласен. Но ORM — это не про "устранение зависимости от конкретной базы", это не ее первоочередная задача. Абстракцию вы уже сами делаете (шаблон Repository например).

Что мешает работать и тем и другим параллельно?

ничего, просто два процесса. И да — формирование email-а это представление. Независимый процесс. Запускайте сколько хотите. А вот если ваш "коркер" бизнес процессы будет разруливать, то вам уже важно что бы бизнес процессы реализованные в версии 1 и версии 2 были совместимы.

Что мне мешает запустить комплект новых воркеров

А что мешает добавить код в имеющийся воркер что бы тот сам стал считать в нужный момент по другому? У вас же по любому будет какой-то код который будет принимать решение какому из воркеров трудиться когда. Или вы руками планируете переключать?

Ради суперзадачи "использовать триггеры во что бы то ни стало?"

Нет, просто я не очень понимаю зачем может понадобиться две версии одного тригера одновременно выкатывать. Два тригера. Или две процедуры. Если очень хочется.

Пример со схемами — просто говорю что есть механизмы. Если говорить не про тригеры и процедуры, а просто про схему базы, то оно вам и с ORM поможет (удобно при zero downtime. Как пример можете глянуть как вот тут делают).

Вот как раз тут через ORM все чудесно решается.

речь идет не о тех изменениях. Это про изменения логики/кода.

Через Entity lifecycle events.

если вы вешаете на них бизнес логику — сочувствую тем кто будет поддерживать ваш код в будущем. Эти вещи предназначаются для персистенс логики всякой веселой.

т.к. отслеживание изменений в ORM обычно из коробки

Только если ваша ORM имеет внутри unit of work. Это маленький процент ORM и в целом они обычно очень сложные. Не ну как, если понимать что магии там нету и разбираться как оно работает)

Я в последнем проекте просто кидал сообщение в менеджер очередей

А у меня вообще event sourcing

в PostgreSQL в триггкре доступна информация о пользователе, выполнившем транзакцию

Тригер будет запущен из под того же пользователя, из под которого идет подключение. Ну то есть соответственно помимо тригера вам надо будет еще аутентификацию на пользователей СУБД перевести. А вот это уже оч херово скейлится.

Скажем у меня на проекте HIPAA и мне нужно не только трекать кто чего подправил, но и кто чего посмотрел. Настолько что мол мне надо трекать кто в какое время в результате поиска каких пользователей увидел.

Подобное я ни в коем случае не буду делать ни на тригерах ни на ORM. У меня сверху подсистема которая коллектит ивентики эти и потом балк инсертом записывает.

и можно ли к каким-то внешним службам обратиться, типа RabbitMQ или Redis?

Там есть notify через который можно замутить pub/sub. Например — штуки типа postgraphile используют для того что бы апдейты на клиент в сокеты пихать.

Но они что, правда не работают в кластерах и при шардинге?

Тут больше вопрос в бизнес логики и можно ли эту логику на шарды разбить.

Опять же, у меня опыта такого тоже нет, просто из всех проектов которые приходилось видеть основной юзкейс был именно в том что бы жестко ограничивать доступ к данным (когда самое критически важное лежит процедурами, все данные жестко разбиты какими-нибудь row based security и т.д.). Ну и те же микросервисы, где можно ввести те же ограничения, уже могут выйти дороже. Но опять же всякое бывает. Иногда критически важную подсистему можно выделить отдельно и будет как бы монолит + внешняя система которая не меняется без согласования с контролирующими органами (какие-нибудь PCI DSS)

Подозреваю что вы пользуетесь либо Доктриной либо Чем-то вроде гибернейта, ну тогда в целом мы используем одни и те же инструменты.

разница лишь в том что вот все эти «богатства» это про persistence а не про бизнес логику. И да, я помню как я сам завязывал на всякие вычисления чейнджсетов бизнес логику — это прямая дорога в ад на любом маломальски сложном проекте.

Ну и еще раз — вы сами предлагали посмотреть на вещи «по другому». Например — event sourcing вполне себе компромисный вараинт, который позволяет вам крутить вертеть вашей моделью данных как угодно.

ORM и DBAL не синонимы и не вложенные множества. Отсутствие vendor lock в случае универсальной ORM лишь бесплатній бонус, если вам нужен маппинг, и огромній оверхид если нужна абстракция от диалекта SQL.

Что опять же подразумевает сеньорские знания в случаях отличных от самых тривиальных :)

ORM — она (он?) такая же реляционная как СУБД под ней.

реляционная в смысле орудует реляционной алгеброй (ну там картежи данных, предикаты) или в каком смысле вы употребляете это слово?

Должен ли это понимать джун? Я думаю да.

Понимают ли? думаю нет. Для подавляющего большинства джунов ORM это волшебная коробка которая просто работает. Более того — это довольно распространенное мнение. Вот выше тоже вещают про то что ORM это абстракция от базы. А если оно абстракция — значит про базу знать не обязательно.

которые отрабатываются по уже загруженным данным

и джойны там есть? Или чисто проверка условий? Ну мол реляционная алгебра это все ж чуть интереснее чем фильтрация коллекции.

Опять же — главное пожалуй отличие — отсутствие ссылок и возможности однонаправленные one-to-many связи делать (у вас на стороне many fk что делает его зависимым от one)

Ну и за счет всех этих нюансов и появляются кучи плюшек по оптимизации. А так можно просто key-value хранилище сделать и индексы строить, никто не мешает. Объектно-ориентированные базы были, сейчас вот есть документно ориентированные (или мой любимый объектно/реляционный постгресс)

но это все через корень агрегата идет. То есть в целом — можно заменять реляционную базу на документно-ориентированную и получить в целом такой же результат.

> ну ORM — это все же не RDBMS

прикол то в том что если у вас есть RDBMS то ограничения этой модели будут просачиваться сквозь вашу ORM (если она общего назначения, типа гибернейта). Те же one-to-many там кастылем разруливаются, что бы эмулировать однонаправленность связи.

забавные штуки, которые позволяют строить запросы, которые отрабатываются по уже загруженным данным

Расскажите подробнее, пожалуйста. Какие группы запросов поддерживаются — произвольные, или только фильтрация по PrimaryKey? Если произвольные запросы, то чем обеспечивается доказательство, что из базы уже всё прочитано в память, и в базу лезть не требуется?

Просто если здесь только фильтрация по PrimaryKey, то такие штуки по факту являются банальным кэшем, и ввиду этого абсолютно не забавны. А вот если там поддержка произвольных запросов (и не просто кэширование результатов) — то это да, интересно неимоверно.

А если в запросе при этом есть сортировка по соседнему атрибуту, то кэш я вообще не имею права использовать (исключение — кеш содержит результаты запросов по ключу из текста самого запроса, и даже в этом случае не всегда).

Да, это может работать если клиенту возможно скармливать данные по кускам, как, например, Flux<T> в реакторе. Тогда при запросе можно быстро выдавать из кэша что есть, и если этого не хватило — выдать уже из базы данных. Так можно сильно уменьшить время первоначального отклика на запрос, если отклик на запросы клиентов часто содержит повторяющиеся данные.

К сожалению, плохо будет работать сортировка — в общем случае, в любой момент остаётся шанс, что в базе находится некий элемент, который по данному критерию ниже, чем начало кешированной страницы.

Промышленная разработка софта отличается от идеальной разработки софта. Решения принимаются в различных условиях и всегда с неполными данными. Грамотная архитектура недостижима, когда приходишь в проект в любом случае видишь говно.

Пример с БД и бэком может быть обусловлен тысячей причин, начиная с "спроектировали БД, потом появились новые требования" заканчивая "для возможности будущей миграции с SQL на NoSQL (или наоборот) принято решение вынести логику на уровень Бэка".

То же самое с фронтом: ВК например отправляет через AJAX на фронт сразу куски готового HTML, в то время как стандарт — это JSON. Даже если условия изменились, и сейчас какое-то решение выглядит глупым, вполне возможно что оно принято в других условиях и сейчас это тупо ДОРОГО переделывать.