Comments 12

Не пойму, а как собственно осуществляются стереосёмка. Всегда казалось, что для хоть сколь-нибудь приемлемого качества нужно два объектива хоть чуть да разнесенных ( а на расстояниях в десятки и сотни километров совсем не чуть). Или это не естественные (одномоментные) стерео, а лишь их их эмуляция за счет съемки в разные промежутки времени (не суть — на разных витках или просто с запаздыванием на одном).

P. S. Блиц-голосование!

Автору, конечно, респект, но кто понял больше половины слов типа «апо-тессаровский», «антиблюминговой» «или „хроматические абберации“- смело ставьте мне минус за коммент.

P. S. Блиц-голосование!

Автору, конечно, респект, но кто понял больше половины слов типа «апо-тессаровский», «антиблюминговой» «или „хроматические абберации“- смело ставьте мне минус за коммент.

+2

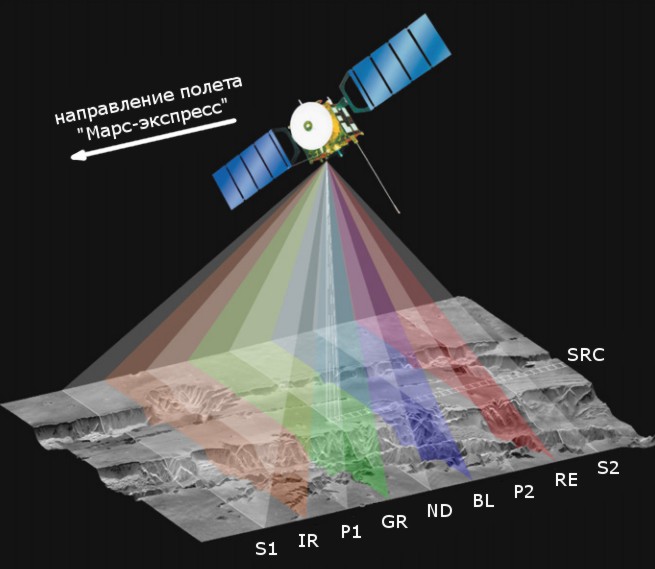

Стереосъемка получается за счет того, что одновременно считываются данные с разных сенсоров, обеспечивающих «разнесенность» картинки. Например, между S1 и S2 — почти 19°, что дает вполне себе стерео-картинку. В этом и уникальность камеры, в отличие от других, которые снимают на разных витках.

Что касается терминологии, то мне показалось, что в хабах «фототехника» и «робототехника» эти слова более или менее знакомы, поэтому разжевывать не стал :) Если есть конкретные вопросы — спрашивайте, разберемся.

Что касается терминологии, то мне показалось, что в хабах «фототехника» и «робототехника» эти слова более или менее знакомы, поэтому разжевывать не стал :) Если есть конкретные вопросы — спрашивайте, разберемся.

0

Еще раз внимательно перечитав и пересмотрев картинки — у этого ИСМ (есть такой термин? :), я понял так, разнесены оси наблюдения «камер» при практически одинаковом фокусе — грубо говоря, одна снимает вперед по движению, а другая сзади и стереоизображение формируется не по одновременным снимкам с разных точек, а с неким запаздыванием с разных точек орбиты, причем достаточно большим (далеко не миллисекунды).

Конкретных вопросов по терминам нет, поскольку есть гугл и вики :) Но если не сложно, то лучше в следующий раз давать ссылки хотя бы на некоторые. Например, на те, на которые знакомые обычные айтишники (не робототехники, и не фототехники, а просто будущим интересующиеся :) не могут сходу сказать что это.

Конкретных вопросов по терминам нет, поскольку есть гугл и вики :) Но если не сложно, то лучше в следующий раз давать ссылки хотя бы на некоторые. Например, на те, на которые знакомые обычные айтишники (не робототехники, и не фототехники, а просто будущим интересующиеся :) не могут сходу сказать что это.

0

Нет, там одна камера и 9 линий ПЗС, снимающих именно одновременно. На Земле проводилась калибровка векторов направлений для каждого из 5184 пикселей (правда измерения проводились на каждом четырехсотом для каждого сенсора). Точность позиционирования пикселей составляет около 1" для центрального пикселя и 2" для крайних. Именно разница (заведомо известная и откалиброванная) в векторах направления линий сенсоров обеспечивает получение стереоизображений.

UPD: Извиняюсь, это в ответ VolCh

UPD: Извиняюсь, это в ответ VolCh

0

То есть это, утрируя, очень близко расположенные глаза, глядящие в одну трубу? Что-то цифры не вяжутся, по-моему. Человеческие глаза замечают, насколько я знаю, разницу в минуту для создания стереократинки. На расстоянии в десятки и сотни километров они не различат объём. Может, все же, один луч съемки направлен вперед, а другой назад, чтобы «заметить» объём, пускай и не моментально, но имея в виду, что рельеф статичен? По картинке очень нпохоже, что сначала один объект снимает SR1 спереди, а потом по мере пролета по орбите, его же снимает SR2 с противоположного (относительно надира) ракурса.

0

То есть это, утрируя, очень близко расположенные глаза, глядящие в одну трубу?

Да, именно так.

Человеческие глаза замечают, насколько я знаю, разницу в минуту для создания стереократинки.

Все-таки ПЗС — это куда более точный инструмент, чем человеческий глаз. По крайней мере, с точки зрения разрешающей способности )

По картинке очень нпохоже, что сначала один объект снимает SR1 спереди, а потом по мере пролета по орбите, его же снимает SR2 с противоположного (относительно надира) ракурса.

Здесь дело немного в другом: стереоизображение — это реконструкция трехмерного положения объекта по трем точкам (SR1 — надир — SR2). Т.е. в один момент времени снимаются данные, по которым в дальнейшем встроенное ПО воссоздает трехмерную картинку. Для того, чтобы получить полноценное стереоизображение, разумеется, нужно вычислить все три координаты между S1 и S2, иными словами, нужно пройти всеми тремя сенсорами весь путь от S2 до S1. Мы с вами об одном и том же говорим? )

0

Все-таки ПЗС — это куда более точный инструмент, чем человеческий глаз. По крайней мере, с точки зрения разрешающей способности )

Извините, но голословное утверждение. Что у глаза, что у ПЗС реальная (внешняя) разрешающая способность зависит во многом от оптики, фокусирующей картинку на площадь «датчика» (будь то сетчатка, или кристаллы), ну и от площади. Вот, кстати, чем не нравятся многие обзоры дальнобойных оптических (или им подобных — ИК, УФ) систем, что не приводится цифр сравнения их разрешения с человеческим глазом, пускай и вооруженным. По-моему, авторам подобных обзоров было бы не сложно добавить что-то вроде «это соответствует невооруженному взгляду с N метров или 100500*M биноклю с данной орбиты» — лучше бы чувствовались достижения прогресса :) Не упрек, а совет, чтобы привлекать далеких от оптики и роботов людей к космосу и микромиру. Вот посмотрел характеристики и погуглил, вроде HSRC соответствует семикратному биноклю, а SRC -тридцатикратному.

Здесь дело немного в другом: стереоизображение — это реконструкция трехмерного положения объекта по трем точкам (SR1 — надир — SR2). Т.е. в один момент времени снимаются данные, по которым в дальнейшем встроенное ПО воссоздает трехмерную картинку. Для того, чтобы получить полноценное стереоизображение, разумеется, нужно вычислить все три координаты между S1 и S2, иными словами, нужно пройти всеми тремя сенсорами весь путь от S2 до S1. Мы с вами об одном и том же говорим? )

Я понимаю, что реконструкция. Но не понимаю её принцип, если точки проекции из оптики на матрицы практически совпадают. Я понял бы принцип реконструкции типа «сняли спереди, через 5 минут сняли сверху, ещё через 5 минут сняли сзади» — и реконструировали по трем снимкам. Но вот тупо болтаю башкой с одним закрытым глазом ( ивсем телом двигаюсь так чтобы глаз относительно неподвижен был, только угол зрения менялся) и не могу понять принцип реконструкции. И оптику пытаюсь вспомнить — тоже никак не складывается.

+5

Но вот тупо болтаю башкой с одним закрытым глазом и не могу понять принцип реконструкции.

Представьте себе, что мы хотим получить стереоизображение для линии ND. Сначала S1 снял ее с одной стороны. Потом спутник пролетел некоторое расстояие по орбите и S2 снял линию ND с другой стороны. Эти две фотографии одной линии отстоят на время полёта спутника. Но Марс за это время не поменялся, поэтому можно собрать из двух фотографий стереопару.

Такая процедура выполняется для каждого отснятого участка в поточном режиме.

+1

Все-таки ПЗС — это куда более точный инструмент, чем человеческий глаз. По крайней мере, с точки зрения разрешающей способности )

С точки зрения «разрешающей способности» надо сравнивать с глазом систему ПЗС+объектив, а не саму ПЗС. Саму ПЗС стоит сравнивать с сетчаткой ( сетчатка у человека содержит около 6—7 млн колбочек и 110—125 млн палочек)

0

Преклоняю голову перед конструкторами, которые проектируют и изготовляют такие воистину шедевры инженерного искусства!

+2

У Сфинкса на Земле нос отломали — туристы они везде такие. На сувениры куски от «лица» откалывали и испортили всю гениальную задумку скульптора.

+1

Sign up to leave a comment.

Articles

Change theme settings

10 лет первой камере для съемки Марса в высоком разрешении