Привет! Хочу рассказать о проекте, который наверняка окажется полезным многим разработчикам. В двух словах объяснить, зачем он нужен, достаточно сложно, но я попробую.

Uploadcare — сервис для приложений и сайтов, упрощающий получение файлов от пользователей, их хранение и передачу по сети.

Тот, кто хоть раз делал форму с

<input type="file">, знает, что ничего сложного в этом нет, но есть неприятные моменты, возникающие по пути. Вот только некоторые из них:

— нельзя сохранить форму с файлом по ajax;

— нельзя показать форму с уже выбранным файлом;

— если вы ожидаете картинку, нужно убедиться, что загружена картинка;

— сервер должен быть готов принимать большое тело запроса;

— в некоторых фреймворках загруженный файл является источником повышенной опасности;

— удобная загрузка нескольких файлов реализуется достаточно сложно;

— индикация процесса загрузки реализуется еще сложнее;

— на диске сервера может закончиться место;

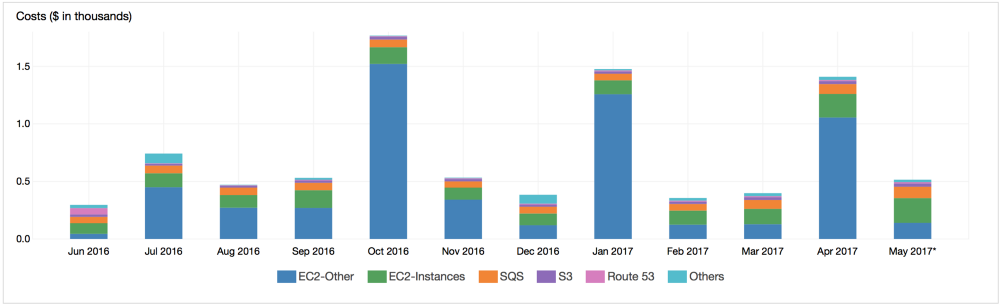

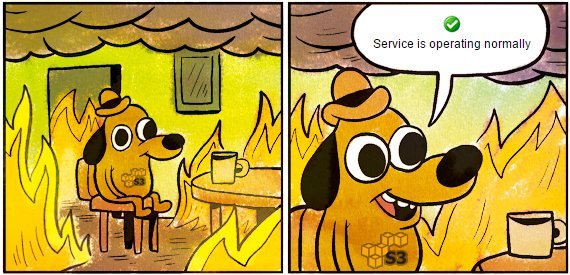

Примерно с 9 вечера до часу ночи по Московскому времени были перебои с работой облачного хранилища Amazon S3. Началось это с сообщения в твиттер «S3 is experiencing high error rates. We are working hard on recovering», хотя мир узнал об этом раньше: перестали работать (полностью или частично) сайты Medium, Slack, Coursera, Trello, Adobe и еще куча.

Примерно с 9 вечера до часу ночи по Московскому времени были перебои с работой облачного хранилища Amazon S3. Началось это с сообщения в твиттер «S3 is experiencing high error rates. We are working hard on recovering», хотя мир узнал об этом раньше: перестали работать (полностью или частично) сайты Medium, Slack, Coursera, Trello, Adobe и еще куча.