Comments 178

Как то под вечер туго пошло, кроме класного названия антинейрона не понял как он должен работать. А можно на пальцах объяснить функцию активации искусственного антинейрона, метод обучения? Или этого нет, а есть только идея, а вот бы оно так сработало?

0

Поддержу, сыровато.

+2

Увы, с математикой у меня всегда было туго, так что точно сказать, что, мол, «функция активации должна быть такая-то» и далее формула, я, к сожалению, не скажу. А вот методика обучения, как было сказано выше, такая же, как и у обычного нейрона — на примерах. Но, в отличие от этих самых обычных нейронов, примеры не «правильные», а «ошибочные». То бишь мы говорим НС не как надо делать, а, напротив, как делать не надо. Тем самым обозначая коридор возможных значений. Далее дело упирается в тот факт, каким образом НС должна дойти от X до Y (или, наоборот, от Y до X, так как соответствие при нужных ограничениях должно поддерживаться в обе стороны): либо определенной функцией активации (но в таком случае для каждого случая она должна быть своя), либо (что мне больше нравится) с помощью универсального алгоритма обработки сигналов. Про последнее я вычитала в одной интересной книжке, где проводилась параллель между строением коры головного мозга, где область мозга, отвечающая за, например, слух, могла быть «переучена» под зрение, и алгоритмом работы искусственных нейронов. Хотя, возможно, вместо функции активации можно использовать эдакий вариант аппроксимации функции по среднему значению в заданном коридоре… Тут вопрос остается открытым.

0

Случаем не «Об интеллекте» книга называется? Если нет, то очень советую почитать.

+2

Да, именно она самая. :)

0

Тоже почитываю(6 глава)… Есть несколько интересных моментов(тот же неокортекс, однотипный принцип работы всего мозга, поведение, как признак интеллекта и т.д.), но пока, в целом, она кажется мне, несмотря на обилие понятных примеров(крыса в лабиринте, например), малоинформативной с точки зрения описания именно интеллекта, учитывая что автор делает на этом акцент. Все там как-то вокруг да около. Имхо. Плюс читаю и в голове буквально мелькает: «Ну не тот это путь!», хоть и назвать себя экспертом в этой области я не могу. Вот такое мое мнение.

0

А что вы понимаете под «описанием именно интеллекта»? Как мне показалось, это довольно интересная попытка оценить функционирование мозга с точки зрения инженера. Ну а в связи с тем, что до конца люди еще не вполне понимают как же работает мозг, сдается, ждать точных выводов от автора не стоит. :)

0

Я не о том, что мало написано именно про устройство работы интеллекта, я про то, что мало информации о самом интеллекте в книге. Проще говоря на 1 предложение по теме 10 примеров. Я не испытываю неприязни к автору, но у меня иллюзия, что он выдает конфету в 20 обертках. Честно, возникает чувство, что он не описывает свое наблюдение, а хвалит, мол, вот посмотрите вот эта функция мозга прекрасно коррелирует с десятком моих наблюдений из жизни и поэтому я считаю, что это ОНО. Хотя может другим будет интересно, не спорю, книга, как я уже сказал, интересная.

0

Сразу извиняюсь за резкость, но… Зачем же Вы, уважаемая, не зная математики лезете в область нейронных сетей, которые являются (если заниматься ими серьезно, а не кидать случайный взгляд) крайне сложной математической моделью?

А теперь конструктивно. Во-первых, пространство вариантов, как Вы его называете, в общем случае бесконечно велико и ограничить его таким примитивным способом Вы просто не сможете. Во-вторых, любая нейронная сеть должна обучаться на выборке, в которой присутствуют и положительные образцы, причем с инвариантами, и отрицательные. Только так можно ограничить ошибки ложного срабатывания. В-третьих, Ваши рассуждения о методах обучения людей крайне наивны. Недостаточно дать несколько прямых линий обучаемому и сказать «повтори». Он должен видеть весь процесс, обязательно включая установку точек начала, конца и способ движения карандаша. А вы строите теорию исходя из подачи целостных примеров, завершенных образцов. Ознакомьтесь с соответствующей литературой по психологии. А про нейронные сети лучше просто забудьте.

А теперь конструктивно. Во-первых, пространство вариантов, как Вы его называете, в общем случае бесконечно велико и ограничить его таким примитивным способом Вы просто не сможете. Во-вторых, любая нейронная сеть должна обучаться на выборке, в которой присутствуют и положительные образцы, причем с инвариантами, и отрицательные. Только так можно ограничить ошибки ложного срабатывания. В-третьих, Ваши рассуждения о методах обучения людей крайне наивны. Недостаточно дать несколько прямых линий обучаемому и сказать «повтори». Он должен видеть весь процесс, обязательно включая установку точек начала, конца и способ движения карандаша. А вы строите теорию исходя из подачи целостных примеров, завершенных образцов. Ознакомьтесь с соответствующей литературой по психологии. А про нейронные сети лучше просто забудьте.

+3

Не всё настолько плохо у меня с математикой. Тут несколько уважаемых человек обращали мое внимание на некоторые моменты моего повествования и я постаралась точнее выразить то, что хотела сказать данной статьей. Не сочтите за труд ознакомиться и с ними для более полной картины повествования.

-1

Не счел и ознакомился. Моих аргументов это не отменило. А у Вас что-то не так с логикой. Я даю Вам задачу: «Решите уравнение 80=5*x. Даю подсказку. Это не 2». Каким образом это Вам поможет? А если я Вам дам серию таких примеров, даже с общей сигнатурой a=b*x и к каждому приложу кучу неверных ответов (а их, если у Вас не все плохо с математикой, бесконечное множество), это как-то поможет Вам уловить закономерность? Бред. Вы не научите таким образом сеть определять доверительный интервал истинного ответа. Вы научите ее только генерировать шум.

+5

Вообще, даже интересно. Как Вы собираетесь обучать сеть? Обратным распространением ошибки? Так ведь ошибка — цель обучения. То есть, в сущности, Ваше предложение сводится к образованию полного множества неверных значений и «запихивания» его каким-то образом в нейронку. Даже для единичного примера это невозможно.

+2

Нет, обратное распространение ошибки тут совершенно ни при чем.

По поводу примеров, в данном случае, ежели пытаться решить пример с помощью предложенной концепции, получится что-то вроде попытки есть суп вилкой. Для решения подобных уравнений есть прекрасные пакеты программ с обычной логикой. Мое же предложение скорее ориентировано на задачи, в которых нет 1 правильного ответа и множества неправильных.

Тем более, кстати сказать, математическая корректность — это далеко не самый ключевой момент. Взять, например, эвристический алгоритм. :)

По поводу примеров, в данном случае, ежели пытаться решить пример с помощью предложенной концепции, получится что-то вроде попытки есть суп вилкой. Для решения подобных уравнений есть прекрасные пакеты программ с обычной логикой. Мое же предложение скорее ориентировано на задачи, в которых нет 1 правильного ответа и множества неправильных.

Тем более, кстати сказать, математическая корректность — это далеко не самый ключевой момент. Взять, например, эвристический алгоритм. :)

0

> предложение скорее ориентировано на задачи, в которых нет 1 правильного ответа и множества неправильных

например?

> Взять, например, эвристический алгоритм

Какой? и в чем его математическая некорректность?

например?

> Взять, например, эвристический алгоритм

Какой? и в чем его математическая некорректность?

0

Ну, вообще эвристический алгоритм может генерировать такое решение, правильность которого для всех возможных случаев не доказана. Более того, алгоритм может быть формально неверен. В общем, для более полной информации рекомендую поискать в сети.

0

Приведите мне пример такого алгоритма. Формально неверного алгоритма, которым кто-то пользуется. Смешно, в самом деле. Есть вероятностные алгоритмы, но для них известен доверительный интервал. Чтобы формально неверный алгоритм…

0

Это не моя область специализации, так что рекомендую ознакомиться с соответствующей литературой по этому поводу. В предыдущем комментарии я не изобретала ничего нового, просто процитировала то, что говорят об этом источники.

0

Это моя область специализации. И я говорю Вам — математически некорректные алгоритмы никем и никогда не используются. Есть эвристические (мат. корректные) алгоритмы, неверные в силу необоснованности используемых предположений, но дающие удовлетворительное решение узкого класса задач. Если даете подобные заявления — приводите ссылки на источники.

+3

Тогда как Вы собираетесь обучать сеть?

0

Примерно так. Для сети задается коридор значений, ограниченный неверными решениями, который может быть самой изощренной формы. В зависимости от этого коридора (или, ежели так можно выразиться, он начальных условий) НС будет в соответствии с определенным алгоритмом генерировать решение. В связи с тем, что для разных задач коридор будет разным, решения НС (отмечу, что алгоритм будет тот же) будут отличаться.

0

Чушь какая-то. Как Вы себе представляете «коридор изощренной формы». Вы обучаете сеть на конечном множестве примеров, там никакими формами даже не пахнет. Дальше. «НС в соответствии с определенным алгоритмом будет генерировать решение». НС — сеть распространяющегося воздействия, она реализует один алгоритм. Вы его не задаете. Вы задаете свободные параметры сети, все остальное определяется только ее структурой.

Я все еще жду примера задачи «в которых нет 1 правильного ответа и множества неправильных». Потому что совсем не понимаю направление Ваших мыслей.

Я все еще жду примера задачи «в которых нет 1 правильного ответа и множества неправильных». Потому что совсем не понимаю направление Ваших мыслей.

+1

Скажем так, под таким коридором я подразумеваю то, что области подобных неверных решений могут пересекаться, образовывая, грубо говоря, не прямой коридор, а угловатый. Кстати о «формах», я просто представляю эти самые значения в визуальной форме, ну как на картинках выше.

Я и не говорю, что я задаю алгоритм. Именно что сеть реализует алгоритм. Они его и будет реализовать. Непосредственно учитель будет обучать, к алгоритму он никакого отношения иметь не будет. Алгоритм (который я вам на данном этапе пока точно предоставить не могу) реализуется какой-то структурой сети. Вот именно он и будет работать над генерированием решения. Повторюсь, что учитель ничего с алгоритмом делать не будет.

На счет задач. Для себя я представляю задачи в совокупности значений «если… то ...», но вам, как я вижу, удобней в четких математических аналогиях. Постараюсь ответить в подобной форме. О, кстати, в качестве просто примера с не одним решением можно даже упомянуть выражения, которые решаются интервальной арифметикой. В подобных случаях решение не одно, а целый интервал.

Я и не говорю, что я задаю алгоритм. Именно что сеть реализует алгоритм. Они его и будет реализовать. Непосредственно учитель будет обучать, к алгоритму он никакого отношения иметь не будет. Алгоритм (который я вам на данном этапе пока точно предоставить не могу) реализуется какой-то структурой сети. Вот именно он и будет работать над генерированием решения. Повторюсь, что учитель ничего с алгоритмом делать не будет.

На счет задач. Для себя я представляю задачи в совокупности значений «если… то ...», но вам, как я вижу, удобней в четких математических аналогиях. Постараюсь ответить в подобной форме. О, кстати, в качестве просто примера с не одним решением можно даже упомянуть выражения, которые решаются интервальной арифметикой. В подобных случаях решение не одно, а целый интервал.

0

На картинках выше представлена классическая задача линейного программирования.

Представьте задачу хотя бы в форме «если… то...», меня это, поверьте, не смутит.

Давайте еще вспомним вариационное исчисление, где ответов множество. Или уравнения с несколькими решениями. Пусть решений интервал. Неверных решений бесконечно много. Задайте сколько угодно неверных интервалов — это ни на йоту не приблизит Вас к верному решению.

Представьте задачу хотя бы в форме «если… то...», меня это, поверьте, не смутит.

Давайте еще вспомним вариационное исчисление, где ответов множество. Или уравнения с несколькими решениями. Пусть решений интервал. Неверных решений бесконечно много. Задайте сколько угодно неверных интервалов — это ни на йоту не приблизит Вас к верному решению.

0

Вот, где-то чуть ниже я уже привела что-то вроде примера: habrahabr.ru/blogs/artificial_intelligence/131135/#comment_4352828

0

UFO just landed and posted this here

Как-то грубо вы выразились, «мусор». Я все-таки считаю, что правильней будет сказать именно «не правильное значение», то есть такое значение, которое не интересует нас в данный момент, скажем так. Так вот, на вход подаем неверное значение для данного случая, а на выход — соответствующее ему (но опять не неверное в данный момент) выходное. То есть эти две структуры не просто так не верны, а с каким-то определенным смыслом.

0

У меня такая аналогия возникает: вы говорите человеку, чтобы он нарисовал прямую, при этом не объяснив, что такое эта самая прямая. Рисуй что угодно, а я буду говорить, прямая это или нет. По моему ничего не получится.

+4

Ну как что угодно, что угодно было бы, если бы мы вообще ничего не сказали, а просто выдали бы лист бумаги. А тут задумывается нечто такое: пространство вариантов ограничивается, так что у НС меньше пространства для маневра и она заведомо не может выбрать те значения, которые находятся вне коридора «разрешенных» значений. Отмечу, что коридор этот может быть довольно сложной формы. Так вот, применяя определенную функцию активации (пока затрудняюсь сказать какую) или универсальный алгоритм (об этом в комментариях чуть выше), НС сама должна прийти к верному значению.

0

Есть одна маленькая, но большая проблема. Обучаясь с учителем, ИНС обязана сойтись к правильному результату. Для каждого входа есть всего лишь один правильный результат, к которому мы последовательно приближаемся, например, распространяя ошибку назад. В то же время у ИНС, в общем случае, есть бесконечное множество неправильных результатов. Это множество может быть ограничено до определенного числа, если сеть работает с дискретными значениями, однако, число будет по-прежнему велико, поскольку маленькие нейросети почти никогда не нужны. Для нахождения хоть какого-то результата вам придется перебрать, в пределе, все пары (вход, выход), среди которых правильные и неправильные. Но откуда вам знать, какая пара правильная, а какая — нет? Вот пусть у нас будет бинарная нейросеть с двумя входами и двумя выходами. Я подаю (1, 0) и получаю (0, 1). Что это — правильный результат или нет?

+5

Понятное дело, что в общем случае число вариантов бесконечно. Для того и вводятся ограничения по выбору, но эти самые ограничения не обязательно только пара X-Y, можно же оптом ограничить всё пространство ниже (и/или выше) представленной пары ограничений.

На примере бинарной матрицы. Допустим, у нас есть бинарная сеть с 2 входами и 2 выходами, значения соответствующие могут приниматься в соответствии с таблицей истинности. Мы говорим, что всё, что выше (1, 0) — неверно. Остается буквально один вариант (1, 1), который, теоретически, нам и нужен. Тут не затрагивается вопрос об алгоритме выбора или функции активации, конечно, но основную идею понять можно.

На примере бинарной матрицы. Допустим, у нас есть бинарная сеть с 2 входами и 2 выходами, значения соответствующие могут приниматься в соответствии с таблицей истинности. Мы говорим, что всё, что выше (1, 0) — неверно. Остается буквально один вариант (1, 1), который, теоретически, нам и нужен. Тут не затрагивается вопрос об алгоритме выбора или функции активации, конечно, но основную идею понять можно.

0

У вас, мягко говоря, странные рассуждения. Что значит «не просто так не верны, а с каким-то определенным смыслом», сказанное вами выше? Зачем нам искать пару (X, Y), где X — неправильный вход, а Y — неправильный выход? Ваша цель — обучить нейросеть, чтобы она решала конкретную задачу правильно, то есть, подстроить веса так, чтобы определенный вход обрабатывался с определенным алгоритмом и давал определенный выход. Вы этого не добьетесь, если не будете знать, что хотите получить. Вам в любом случае либо нужна пара-учитель, либо функция оценки «правильный ли результат». Вы поймите, что сравнивая неправильный результат с неправильным, вы никогда не узнаете, какой должен быть правильный. Вам нужно на что-то опираться.

Нейросеть может прийти от X к Y потенциально бесконечным числом способов, поскольку подстраивать веса можно многими комбинациями. Вот представьте себе число 4: его можно получить через входы и выходы (2, 2), а можно (1, 3), а также (0.5, 3.5) и так далее до бесконечности. Но зачем мы будем его искать, если нам нужно число 12?

Я интуитивно понимаю, что вы хотели сказать, но также интуитивно понимаю, что без математики все эти ваши рассуждения не имеют смысла и ошибочны.

Нейросеть может прийти от X к Y потенциально бесконечным числом способов, поскольку подстраивать веса можно многими комбинациями. Вот представьте себе число 4: его можно получить через входы и выходы (2, 2), а можно (1, 3), а также (0.5, 3.5) и так далее до бесконечности. Но зачем мы будем его искать, если нам нужно число 12?

Я интуитивно понимаю, что вы хотели сказать, но также интуитивно понимаю, что без математики все эти ваши рассуждения не имеют смысла и ошибочны.

0

Когда мы обучаем НС, мы именно что подстраиваем веса таким образом, чтобы определенный вход обрабатывался так, чтобы на выходе получать выходное значение, соответствующее системе, которую эта НС уловила из примеров. Я же говорю о том, чтобы НС сама принимала решение, основываясь на том, чего она сделать не может (то бишь основываясь на ограничениях, которые мы ей зададим). То бишь в таком случае НС не имитировала бы готовое решение, а генерировала свое.

0

> То бишь в таком случае НС не имитировала бы готовое решение, а генерировала свое.

Позвольте, я расскажу, как работают ИНС.

Ставится задача, которую нужно решить с помощью ИНС. Исходя из задачи придумывается конфигурация сети: количество нейронов в слое, количество слоев, как слои между собой связаны. Все эти параметры придумываются интуитивно, исходя из положений задачи. Например, пусть мы неким образом хотим преобразовывать русские тексты одной и той же длины. Мы должны подумать, что, может быть, стоит сделать n нейронов в слое и (33 + 1 + количество пунктуационных знаков) слоя, где n — количество букв тексте. Мы придумываем, как закодировать буквы; положим, это числа ASCII-таблицы. Затем мы пытаемся понять, что у нас получится на выходах. Если это те же буквы, то мы должны задать активационную функцию, которая по сигналу NET из сумматора возвращает сигнал OUT, где OUT — ASCII-коды букв.

Далее мы пытаемся понять, как можно обучить нейросеть, чтобы она делала для нас необходимое преобразование. То есть, нам нужно получить определенные весовые коэффициенты, которые на данной конфигурации ИНС будут приводить к нужному результату. На первых порах мы решили присвоить весовым коэффициентам случайные величины, — именно так делается во многих случаях, когда разрабатывается новая ИНС. (Случаи с ИНС Хопфилда и Хэмминга — исключение. Там первоначальные весовые коэффициенты задаются исходя из начальных данных.) Теперь нам необходимо обучать нейросеть. На пустом месте обучать ее нельзя, — надо обязательно что-то подавать на вход. Пусть мы подаем некий текст X и видим результат первой итерации — текст Y, а именно, бессмысленное сочетание букв.

Внимание, два вопроса.

1. Решила ли нейросеть на случайных весовых коэффициентах нашу задачу?

2. И если не решила, как нужно изменить весовые коэффициенты, чтобы она все-таки решила?

Вы не сможете ответить на эти два вопроса, поскольку вы не знаете, как должен выглядеть Y-результат обработки X-текста. У вас нет пары-учителя (X, Y'). Вы не можете получить Delta — ошибку от разницы между Y' и Y, потому что Y' у вас нет. Соответственно, метод обратного распространения ошибки для обучения нейросети уже не подходит. Хорошо, пусть так. Вы все еще можете подстроить веса другими способами, — например, случайным перебором. Однако, вы не можете сделать вывод, что необходимо продолжить итерации, потому что у вас нет оценочной функции. Откуда вы знаете, что полученный вами Y — верный или неверный? Откуда вы знаете, что подав следующий текст U, при тех же весах вы получите нужный результат V? Ведь вам неизвестно, как должен выглядеть этот V.

> Когда мы обучаем НС, мы именно что подстраиваем веса таким образом, чтобы определенный вход обрабатывался так, чтобы на выходе получать выходное значение, соответствующее системе, которую эта НС уловила из примеров

Здесь у вас и кроется логическая ошибка, можно сказать, рекурсия. ИНС «улавливает» из примеров во время обучения на этих самых примерах (учителях). Однако, вы хотите уже иметь обученную нейросеть, чтобы ее обучать снова.

> Я же говорю о том, чтобы НС сама принимала решение, основываясь на том, чего она сделать не может (то бишь основываясь на ограничениях, которые мы ей зададим).

Какие ограничения вы хотите задать? Такие: «Для некоторого текста X нельзя получать следующие выходы: Y1, Y2, Y3,...,Yn»? Во-первых, откуда вы знаете, что Y3 — это неверный результат, если у вас нет ни учителя с Y3, ни оценочной функции? Во-вторых, каким, по-вашему, будет n? Да даже для текста «Мама мыла раму» сколько вам придется задать неверных значений?

1 — «Мыла мама раму»

2 — «Раму мыла мама»

3 — «Лоончод шго щ „

4 — “с ЛДОА АОЖ ашп»

…

Легко увидеть, что для такого маленького задания этих результатов будет огромное количество, посчитайте сами с помощью комбинаторики. И кто поручится, что 2 — это неверный результат? Я повторяю еще раз: не зная, что правильно (не имея учителя или, на худой конец, оценочной функции), вы никогда не узнаете, что неправильно.

Я рекомендую вам не «доказать», как это вы сделали сейчас, а построить математический аппарат, который бы отвечал вашим положениям. И тогда вы увидите все ваши логические ошибки и пробелы в знаниях.

Я, кстати, уже второй год преподаю ИИС на кафедре ПИМ. И еще у меня есть пара работ на ИНС, включая текстовый анализатор для распознавания авторства текста. Может, стоит прислушаться?

Позвольте, я расскажу, как работают ИНС.

Ставится задача, которую нужно решить с помощью ИНС. Исходя из задачи придумывается конфигурация сети: количество нейронов в слое, количество слоев, как слои между собой связаны. Все эти параметры придумываются интуитивно, исходя из положений задачи. Например, пусть мы неким образом хотим преобразовывать русские тексты одной и той же длины. Мы должны подумать, что, может быть, стоит сделать n нейронов в слое и (33 + 1 + количество пунктуационных знаков) слоя, где n — количество букв тексте. Мы придумываем, как закодировать буквы; положим, это числа ASCII-таблицы. Затем мы пытаемся понять, что у нас получится на выходах. Если это те же буквы, то мы должны задать активационную функцию, которая по сигналу NET из сумматора возвращает сигнал OUT, где OUT — ASCII-коды букв.

Далее мы пытаемся понять, как можно обучить нейросеть, чтобы она делала для нас необходимое преобразование. То есть, нам нужно получить определенные весовые коэффициенты, которые на данной конфигурации ИНС будут приводить к нужному результату. На первых порах мы решили присвоить весовым коэффициентам случайные величины, — именно так делается во многих случаях, когда разрабатывается новая ИНС. (Случаи с ИНС Хопфилда и Хэмминга — исключение. Там первоначальные весовые коэффициенты задаются исходя из начальных данных.) Теперь нам необходимо обучать нейросеть. На пустом месте обучать ее нельзя, — надо обязательно что-то подавать на вход. Пусть мы подаем некий текст X и видим результат первой итерации — текст Y, а именно, бессмысленное сочетание букв.

Внимание, два вопроса.

1. Решила ли нейросеть на случайных весовых коэффициентах нашу задачу?

2. И если не решила, как нужно изменить весовые коэффициенты, чтобы она все-таки решила?

Вы не сможете ответить на эти два вопроса, поскольку вы не знаете, как должен выглядеть Y-результат обработки X-текста. У вас нет пары-учителя (X, Y'). Вы не можете получить Delta — ошибку от разницы между Y' и Y, потому что Y' у вас нет. Соответственно, метод обратного распространения ошибки для обучения нейросети уже не подходит. Хорошо, пусть так. Вы все еще можете подстроить веса другими способами, — например, случайным перебором. Однако, вы не можете сделать вывод, что необходимо продолжить итерации, потому что у вас нет оценочной функции. Откуда вы знаете, что полученный вами Y — верный или неверный? Откуда вы знаете, что подав следующий текст U, при тех же весах вы получите нужный результат V? Ведь вам неизвестно, как должен выглядеть этот V.

> Когда мы обучаем НС, мы именно что подстраиваем веса таким образом, чтобы определенный вход обрабатывался так, чтобы на выходе получать выходное значение, соответствующее системе, которую эта НС уловила из примеров

Здесь у вас и кроется логическая ошибка, можно сказать, рекурсия. ИНС «улавливает» из примеров во время обучения на этих самых примерах (учителях). Однако, вы хотите уже иметь обученную нейросеть, чтобы ее обучать снова.

> Я же говорю о том, чтобы НС сама принимала решение, основываясь на том, чего она сделать не может (то бишь основываясь на ограничениях, которые мы ей зададим).

Какие ограничения вы хотите задать? Такие: «Для некоторого текста X нельзя получать следующие выходы: Y1, Y2, Y3,...,Yn»? Во-первых, откуда вы знаете, что Y3 — это неверный результат, если у вас нет ни учителя с Y3, ни оценочной функции? Во-вторых, каким, по-вашему, будет n? Да даже для текста «Мама мыла раму» сколько вам придется задать неверных значений?

1 — «Мыла мама раму»

2 — «Раму мыла мама»

3 — «Лоончод шго щ „

4 — “с ЛДОА АОЖ ашп»

…

Легко увидеть, что для такого маленького задания этих результатов будет огромное количество, посчитайте сами с помощью комбинаторики. И кто поручится, что 2 — это неверный результат? Я повторяю еще раз: не зная, что правильно (не имея учителя или, на худой конец, оценочной функции), вы никогда не узнаете, что неправильно.

Я рекомендую вам не «доказать», как это вы сделали сейчас, а построить математический аппарат, который бы отвечал вашим положениям. И тогда вы увидите все ваши логические ошибки и пробелы в знаниях.

Я, кстати, уже второй год преподаю ИИС на кафедре ПИМ. И еще у меня есть пара работ на ИНС, включая текстовый анализатор для распознавания авторства текста. Может, стоит прислушаться?

+1

Я прекрасно понимаю о чем вы хотите мне сказать, более того, уважаю ваше профессиональное мнение.

Конечно, спасибо за дополнительное описание работы ИНС, но прочитав это в вашем изложении, нового ничего не обнаружила. Просто, как мне кажется, мне не вполне удалось донести то, что я хочу рассказать. Все вами вышенаписанное бесспорно верно, но. Но так будет, ежели открыть тот же матлаб, смоделировать сеть и начать давать на вход её неверные решения и не менее неверные результаты на выход. Да, такой финт конечно не сработает. В таком случае, о чем я? О некотором (возможно) пересмотре работы ИНС. В статье я лишь хочу обозначить от чего, по моему мнению, следовало бы отталкиваться. Попробую изложить свою идею еще раз. Не обязательно перебирать все неверные значения (ведь даже в математике есть интервальные вычисления), можно указать коридор разрешенных значений путем обозначения граничного и указания на то, что все значения выше(ниже/правее/левее) также не входят в разрешенную область. Пусть нейрон будет обучен универсальному алгоритму вычисления выходного сигнала. Иными словами, все нейроны, все зависимости от задачи, будут делать одно и то же. Но в зависимости от коридора (можно еще сказать, начальных условий) решение будет получаться разным в зависимости от задачи.

Конечно, мне не хватает точных математических выкладок, но ведь вначале нужна идея. Как говорится, для того, что сделать стол, его нужно сначала придумать.

Конечно, спасибо за дополнительное описание работы ИНС, но прочитав это в вашем изложении, нового ничего не обнаружила. Просто, как мне кажется, мне не вполне удалось донести то, что я хочу рассказать. Все вами вышенаписанное бесспорно верно, но. Но так будет, ежели открыть тот же матлаб, смоделировать сеть и начать давать на вход её неверные решения и не менее неверные результаты на выход. Да, такой финт конечно не сработает. В таком случае, о чем я? О некотором (возможно) пересмотре работы ИНС. В статье я лишь хочу обозначить от чего, по моему мнению, следовало бы отталкиваться. Попробую изложить свою идею еще раз. Не обязательно перебирать все неверные значения (ведь даже в математике есть интервальные вычисления), можно указать коридор разрешенных значений путем обозначения граничного и указания на то, что все значения выше(ниже/правее/левее) также не входят в разрешенную область. Пусть нейрон будет обучен универсальному алгоритму вычисления выходного сигнала. Иными словами, все нейроны, все зависимости от задачи, будут делать одно и то же. Но в зависимости от коридора (можно еще сказать, начальных условий) решение будет получаться разным в зависимости от задачи.

Конечно, мне не хватает точных математических выкладок, но ведь вначале нужна идея. Как говорится, для того, что сделать стол, его нужно сначала придумать.

0

Именно это я вам и советую — доказать свою идею математически, а не выносить ее на Хабр.

По поводу коридора… Задам вам простую задачку. Я загадал некоторое вещественное число. Ограничу вам поиск: оно больше нуля, но меньше 10. Даже пусть так, сузим «коридор»: больше нуля, но меньше пяти. Вы должны каким-то образом отгадать это число.

Могу заранее сказать, у вас ничего не получится. Потому что неважно какой у вас «коридор». Пространство вещественных чисел непрерывно, и их бесконечное множество на любом отрезке, даже на интервале (0, 5). То, что вы знаете граничные условия, никак вам не поможет найти верный результат, никак! Потому что вы не знаете, где находится верный результат. Вы не можете сузить коридор, не зная это число. Потому что любое число на интервале (0, 5) может оказаться тем, что я загадал. Я-то могу сузить коридор, потому что знаю верный результат, а вы — нет. Вам необходимо знать что-то еще: например, целое ли это число (и тогда вы можете перебрать все целые варианты 1, 2, 3, 4), делится ли оно без остатка на какое-то другое число, и так далее. Для каждого конкретного вещественного числа этих «наводок» может быть бесконечное множество, и вы не в состоянии ими воспользоваться, чтобы сузить ваш «коридор».

Ситуация с нейросетями, в общем случае, в точности та же самая.

Вам нужно изучать теорию ИНС, математику и строить матаппарат. Только в этом случае возможен конструктивный диалог.

P.S. Я загадал 0.007.

По поводу коридора… Задам вам простую задачку. Я загадал некоторое вещественное число. Ограничу вам поиск: оно больше нуля, но меньше 10. Даже пусть так, сузим «коридор»: больше нуля, но меньше пяти. Вы должны каким-то образом отгадать это число.

Могу заранее сказать, у вас ничего не получится. Потому что неважно какой у вас «коридор». Пространство вещественных чисел непрерывно, и их бесконечное множество на любом отрезке, даже на интервале (0, 5). То, что вы знаете граничные условия, никак вам не поможет найти верный результат, никак! Потому что вы не знаете, где находится верный результат. Вы не можете сузить коридор, не зная это число. Потому что любое число на интервале (0, 5) может оказаться тем, что я загадал. Я-то могу сузить коридор, потому что знаю верный результат, а вы — нет. Вам необходимо знать что-то еще: например, целое ли это число (и тогда вы можете перебрать все целые варианты 1, 2, 3, 4), делится ли оно без остатка на какое-то другое число, и так далее. Для каждого конкретного вещественного числа этих «наводок» может быть бесконечное множество, и вы не в состоянии ими воспользоваться, чтобы сузить ваш «коридор».

Ситуация с нейросетями, в общем случае, в точности та же самая.

Вам нужно изучать теорию ИНС, математику и строить матаппарат. Только в этом случае возможен конструктивный диалог.

P.S. Я загадал 0.007.

0

Да, я абсолютно согласна, что на данном этапе рассуждений подобную задачу я решить не смогу. Потому что я просто не знаю каким образом нужно преобразовать сигнал, проще говоря, по какому именно алгоритму должен работать антинейрон.

Более того, я не утверждаю, что во всем права. Ибо в моих размышлениях присутствовал и такой вариант: связка нейрон-антинейрон. Ну или наоборот антинейрон-нейрон. В таком тандеме нейрон будет работать по всеми любимому, математически корректному, программно зафиксированному алгоритму. Но тут область в которой сможет аппроксимировать значение нейрон будет ограничиваться со стороны антинейрона.

Может быть я и не права, но, возможно, что-то в этой идее есть. Вы хотите от меня уже готовой теории, увы.

Как сказал один мой хороший друг: «С одной стороны они конечно правы, „нечего писать о чем досконально не знаешь“, а с другой получается, что любой пост будет либо перепечаткой учебника, либо с „реально новой темой“ как бы не на хабр пойдет человек, а в патентный отдел. А уж потом это появится в учебниках и перепечатают на хабре».

Раньше люди считали, что Земля плоская, и всякий, кто не поддерживал эту идею, отправлялся на казнь.

Нет, я не утверждаю, что я права. Просто мне бы хотелось, чтоб люди задумались и над подобной возможностью.

Более того, я не утверждаю, что во всем права. Ибо в моих размышлениях присутствовал и такой вариант: связка нейрон-антинейрон. Ну или наоборот антинейрон-нейрон. В таком тандеме нейрон будет работать по всеми любимому, математически корректному, программно зафиксированному алгоритму. Но тут область в которой сможет аппроксимировать значение нейрон будет ограничиваться со стороны антинейрона.

Может быть я и не права, но, возможно, что-то в этой идее есть. Вы хотите от меня уже готовой теории, увы.

Как сказал один мой хороший друг: «С одной стороны они конечно правы, „нечего писать о чем досконально не знаешь“, а с другой получается, что любой пост будет либо перепечаткой учебника, либо с „реально новой темой“ как бы не на хабр пойдет человек, а в патентный отдел. А уж потом это появится в учебниках и перепечатают на хабре».

Раньше люди считали, что Земля плоская, и всякий, кто не поддерживал эту идею, отправлялся на казнь.

Нет, я не утверждаю, что я права. Просто мне бы хотелось, чтоб люди задумались и над подобной возможностью.

-1

у меня такое ощущение, что вы «переизобрели» генетические алгоритмы.

-2

Вы хотите конкретики, а сами написали что-то совсем не конкретное.

При этом создается впечатление, что вы не особо знаете, как работают нейронные сети ибо:

А ИИ Алгоритмы без математики не понять, к сожалению.

Замечу что нейронные сети в ИИ сейчас не особо актуальны, их изучили еще лет 20 назад, свою нишу они заняли, и теперь надо сказать их забросили, тк существуют более мощьные алгоритмы ИИ: SVM, Genetics ну и конечно Decision_tree . Последние кстати делают то что вы и предложили:

тут на русском:

Дерево_принятия_решений

Вобщем если вам интересно ИИ учите математику, можно даже поверхностно (не углублясь в доказательство теорем), но тогда вы будете понимать что стоит за таким красивыми метафорами как «Нейронные Сети» или «Генетические Алгоритмы»

При этом создается впечатление, что вы не особо знаете, как работают нейронные сети ибо:

Увы, с математикой у меня всегда было туго,

А ИИ Алгоритмы без математики не понять, к сожалению.

Замечу что нейронные сети в ИИ сейчас не особо актуальны, их изучили еще лет 20 назад, свою нишу они заняли, и теперь надо сказать их забросили, тк существуют более мощьные алгоритмы ИИ: SVM, Genetics ну и конечно Decision_tree . Последние кстати делают то что вы и предложили:

По хорошему говоря, НС должна работать с тремя видами данных:

правила (они же — верные данные, они же — факты);

ограничения (они же — неверные данные);

исключения (ведь из каждого правила есть исключения, да?)

тут на русском:

Дерево_принятия_решений

Вобщем если вам интересно ИИ учите математику, можно даже поверхностно (не углублясь в доказательство теорем), но тогда вы будете понимать что стоит за таким красивыми метафорами как «Нейронные Сети» или «Генетические Алгоритмы»

+5

Статья конечно эта ни о чем, так как автор даже не потрудился взять и поставить эксперимент. По сути описанное ни чем не отличается от обычного обучения на примерах. Какая разница что примеры только из одно области решений.

А по вашим примерам. SVM — какашка, так как слишком грубо обсекает на подобласти пространство выборок. То что через нейросеть делается автоматически, через SVM предлагается сначала каким-то образом смаппировать пространство признаков, чтобы можно было более-менее точно посечь его векторами на подходящие классы. В общем случае неройсеть более точно построит сечение чем SVM, так как не ограничена прямыми.

Дерево принятия решений для большого количества признаков становится громоздким и неуправляемым. Не говоря уже о том, что неизвестные комбинации признаков классифицироваться не будут.

А по вашим примерам. SVM — какашка, так как слишком грубо обсекает на подобласти пространство выборок. То что через нейросеть делается автоматически, через SVM предлагается сначала каким-то образом смаппировать пространство признаков, чтобы можно было более-менее точно посечь его векторами на подходящие классы. В общем случае неройсеть более точно построит сечение чем SVM, так как не ограничена прямыми.

Дерево принятия решений для большого количества признаков становится громоздким и неуправляемым. Не говоря уже о том, что неизвестные комбинации признаков классифицироваться не будут.

+5

А как же мысленный эксперимент?) Это очень распространенный способ экспериментирования среди теоретиков. Тем более, что логические структуры можно моделировать прямо в голове. На данном этапе рассчитывать на что большее, увы, я не могу, в связи с определенными пробелами в картине.

0

Я считаю, что Хабр — не черновик, чтобы расписывать здесь ваши домыслы о том, как это работает. За октябрь-месяц это уже второй топик, не несущий в себе правды (первый был «про компиляторы»). Вам стоит сначала доказать правильность идеи самой себе, и если это вдруг удастся, можете поделиться с сообществом. В противном случае вы только внесете еще больше путаницы в головы тех, кто и так ничего не знает, а я полагаю, цели у вас вовсе — не навредить.

+2

Самой себе я уже, как вы выразились, доказала. Другой вопрос, что, возможно, мне не удается в полной мере выразить свою мысль. Тем более предложенная концепция, опять же возможно, натолкнет кого-то на соответствующее математическое решение. Так что черновиком я вышеизложенное никак не считаю. И даже вон, вы сетуете на отсутствие доказательства, но даже в той же математике много недоказанных теорем, которые лишь ждут, чтобы их кто-то доказал.

-2

> Самой себе я уже, как вы выразились, доказала

Это из разряда «Этого не может быть потому, что этого не может быть никогда». Если Вы убедили себя в истинности вашей идеи, это не делает ее автоматически действительно истинной.

> даже в той же математике много недоказанных теорем, которые лишь ждут, чтобы их кто-то доказал

В математике не строят рассуждения на недоказанных теоремах. Мне как математику такие высказывания слух режут.

Это из разряда «Этого не может быть потому, что этого не может быть никогда». Если Вы убедили себя в истинности вашей идеи, это не делает ее автоматически действительно истинной.

> даже в той же математике много недоказанных теорем, которые лишь ждут, чтобы их кто-то доказал

В математике не строят рассуждения на недоказанных теоремах. Мне как математику такие высказывания слух режут.

0

> В математике не строят рассуждения на недоказанных теоремах.

А как же теорема Ферма? Она вон сколько времени никак не доказывалась.

А как же теорема Ферма? Она вон сколько времени никак не доказывалась.

0

Вы о математике что-нибудь кроме названий знаете? Есть недоказанные теоремы в рамках любой теории. Но никто не строит рассуждений, не делает выводов и не утверждает об истинности идеи на основании того, что какая-то теорема может быть верна. Это в редких случаях, с ограничениями и оговорками, допустимо, если теория проверена на огромном количестве частных примеров. А Вы рассуждаете так: «Я думаю, что положение A верно. Исходя их этого сделаем выводы B1, B2 и B3, которые, очевидно, тоже верны. Давайте пока придумаем как сделать B1, B2 и B3 — а A как-нибудь само решится». И если уж мы заговорили о теореме Ферма, Ваши рассуждения как раз напомнили мне рассуждения толпы ферминистов, не имевших элементарного представления о базовых положениях теории чисел и заваливавщих ученых «доказательствами» теоремы. Ну не знаете Вы математики, это очевидно из Ваших комментариев. Так не лезьте в математические модели типа нейронных сетей.

0

Знаете, у вас очень грубая форма ведения диалога. Основываясь на вашем же высказывании, могу рекомендовать вам не делать подобных вещей впредь.

То, что вы чего-то (по вашем же собственным соображениям) не видите, еще не значит, что этого нет. Я уже не говорю о правомерности того высказыванию, что только досконально разбирающиеся в предметной области могут что-то в ней делать. Даже просто из истории пример: Сэмюэль Морзе. Он вообще был художником. А у меня все-таки техническое образование.

Из ваших же комментариев очевидно, что для вас есть лишь два мнения: ваше и неверное.

Я не буду углубляться в психологический анализ вашего же поведения, скажу лишь вот что. Мы с вами вряд ли придем к консенсусу.

То, что вы чего-то (по вашем же собственным соображениям) не видите, еще не значит, что этого нет. Я уже не говорю о правомерности того высказыванию, что только досконально разбирающиеся в предметной области могут что-то в ней делать. Даже просто из истории пример: Сэмюэль Морзе. Он вообще был художником. А у меня все-таки техническое образование.

Из ваших же комментариев очевидно, что для вас есть лишь два мнения: ваше и неверное.

Я не буду углубляться в психологический анализ вашего же поведения, скажу лишь вот что. Мы с вами вряд ли придем к консенсусу.

0

Морзе, если Вы знаете историю, годы провел в изучении математики и физики прежде чем построить телеграф. Он точно знал, что собирается делать, знал как и знал зачем. Он ставил задачи, а не выдвигал безосновательных утверждений. Поэтому его можно считать ученым. Вы взялись за узкую область, не поняв основ стали выдвигать дикие гипотезы, поэтому не льстите себе сравнением с этим человеком.

0

Спорить не буду, а спрошу что есть лучше SVM?

А насчет деревьев — ну да большие, ну так и мощьности уже есть, зато всегда можно понять как ИИ пришел к конкретному решению (в отличие от SVM)

Для обработки комбинаций сущетвуют разные решения.

Впрочем был бы рад узнать про более мощные алгоритмы.

А насчет деревьев — ну да большие, ну так и мощьности уже есть, зато всегда можно понять как ИИ пришел к конкретному решению (в отличие от SVM)

Для обработки комбинаций сущетвуют разные решения.

Впрочем был бы рад узнать про более мощные алгоритмы.

+2

Ну с математикой у меня все-таки не настолько туго. Но готовое новое решение я сгенерировать не смогу, во всяком случае не сейчас.

А вот то, что НС изучили, возможно. Но я читала много разнообразных книжек, где на них смотрели с новой стороны и/или применяли новый подход. Возможно, это направление и получит очередное развитие.

А на счет дерева — не вполне согласна. Оно все-таки также работает со статистическими данными. Я же предлагаю обозначить коридор и по универсальному алгоритму (или определенной функцией активации) сгенерировать новое решение.

А вот то, что НС изучили, возможно. Но я читала много разнообразных книжек, где на них смотрели с новой стороны и/или применяли новый подход. Возможно, это направление и получит очередное развитие.

А на счет дерева — не вполне согласна. Оно все-таки также работает со статистическими данными. Я же предлагаю обозначить коридор и по универсальному алгоритму (или определенной функцией активации) сгенерировать новое решение.

0

"(или определенной функцией активации)"

Загляните в учебники по ИНС. Функция активации нужна для двух вещей:

1. Выходной сигнал с сумматора преобразует к нужному диапазону. Например, после сумматора у нас любые положительные числа, но они нам не нужны, — нам нужен 0 или 1.

2. Позволяет создавать многослойные нейросети, внося нелинейность. Если бы функции активации не было, слои не были бы нужны: они все «сливались» бы в один путем перемножения матриц коэффициентов (W1, W2...).

Функция активации ничего не генерирует, тем более решений.

Загляните в учебники по ИНС. Функция активации нужна для двух вещей:

1. Выходной сигнал с сумматора преобразует к нужному диапазону. Например, после сумматора у нас любые положительные числа, но они нам не нужны, — нам нужен 0 или 1.

2. Позволяет создавать многослойные нейросети, внося нелинейность. Если бы функции активации не было, слои не были бы нужны: они все «сливались» бы в один путем перемножения матриц коэффициентов (W1, W2...).

Функция активации ничего не генерирует, тем более решений.

+1

Собственно, в этом вопросе вы правы, но данная фраза не просто так заключена в скобки. Вы посмотрите на то, что находится за этими самыми скобками — из коридора возможных значений по определенному алгоритму генерируется новое.

0

Откуда у вас возьмется этот коридор? Очевидно, что он должен быть построен вокруг правильного значения. Но вы не знаете, что является правильным или неправильным. У вас нет информации, чтобы строить ограничения. У вас есть только гадание на кофейной гуще.

0

Ну это как сказать. Ежели рассматривать на эмпирическом примере, попробуем проследить ход решения проблемы. Допустим, мне нужно добраться из пункта А в пункт Б. Как это сделать? Во-первых, я не могу летать (ограничение раз). Во-вторых, пешком я не могу идти более 6км/ч (ограничение два)… Ну и так далее. В данном случае ограничения берутся из так называемого «здравого смысла». Откуда подобные данные возьмутся у НС? Из обучения с учителем. Откуда у учителя? Из здравого смысла/физики/математики. Примером применения подобной идеи я привела прогнозирование из желаемого Y необходимый X. Во многих случаях человеку не под силу удержать в голове и точно сопоставить какие-то данные. Вот именно в таком случае такой подход будет подспорьем.

0

Вам понятие математического программирования знакомо? Как раз оптимизация в ограничениях. Для случаев, где присутствует определенного рода неопределенность, также есть соответствующий математический аппарат — теория вероятностей, теория возможностей, нечеткая логика и др. Вы предлагаете весь опыт эксперта выразить в конечном множестве примеров обучающей выборки НС? Причем так, что примеры будут давать информацию о том, чего делать нельзя? ИНС нельзя «скормить» условие «нельзя двигаться быстрее 6 км/ч». Можно дать пример (6 км/ч, нулевой отклик) и кучу аналогичных «ложных» примеров. Но это ничего не даст. Вы суп, например, готовить умеете? Представьте, Вас учат «нельзя класть одну ложку соли», «и две нельзя», «и пять», «и десять». Какой вывод можно сделать? Логически — никакой. Потому что если это котел супа для роты солдат, правильный ответ будет больше, чем максимальный из выборки. А если маленькую кастрюльку для себя — то правильный ответ меньше, чем в любом из этих ложных примеров. Или правильный ответ где-то посередине — шесть ложек. Никакой информации для аппроксимации. Ноль. Для бесконечного множества вариантов такой способ заведомо негоден — если, конечно, все варианты не являются верными. А для конечных множеств единственный выход — обучить (уж не знаю как) всем ложным примерам. Что эквивалентно обучению одному истинному. То есть снова ерунда — если известен верный ответ, не нужна сеть чтобы его искать.

0

Вы упорно не хотите на минутку уйти от фиксированной, реализованной в том же матлабе, схемы работы, построения и использования НС. На вашем упоминании о супе, коридор: нельзя класть больше 3 ложек, нельзя класть меньше 1, даем условие целочисленного исчисления и что остается? Решение.

Я не предлагаю открыть матлаб и начинать пичкать его единичными ограничениями, чтобы потом ждать у моря погоды. Я предлагаю используя принцип НС сделать нечто иное, с другим алгоритмом работы. Иными словами, для хода «от противного».

Все эти примеры, да, простые, но лучше иллюстрируют принцип идеи.

Я не предлагаю открыть матлаб и начинать пичкать его единичными ограничениями, чтобы потом ждать у моря погоды. Я предлагаю используя принцип НС сделать нечто иное, с другим алгоритмом работы. Иными словами, для хода «от противного».

Все эти примеры, да, простые, но лучше иллюстрируют принцип идеи.

-1

> нельзя класть больше 3 ложек, нельзя класть меньше 1, даем условие целочисленного исчисления

Девушка, это задача целочисленного программирования. Для ее решения нейронные сети нафиг не нужны.

Вы упорно не хотите замечать очевидного. Если у Вас и так есть условия «больше 1» и «меньше 3» — Вам не нужна нейронная сеть для поиска решений. У меня складывается впечатление, что Вы элементарно не понимаете, что такое нейронная сеть и как она работает. Вы не сделаете НС с другим алгоритмом работы, НС — сама по себе в некотором смысле алгоритм. Можете предложить альтернативную архитектуру НС? Или неизвестный алгоритм ее обучения? Я весь внимание. Потому что пока я слышу только туманные высказывания, не имеющие никаких обоснований.

То, что Вы называете коридором, а конкретно, интервал допустимых значений, определяется двумя параметрами — его левой и правой границей. Если размерность пространства больше — соответственно, границ больше. Но их должно быть фиксированное число. Тогда задача сводится к определению этих границ по заданному вектору воздействия. Задача, в лучшем случае, для обычной нейронной сети, обученной на выборке примеров (объект, левая граница, правая граница). А если у Вас заранее известны эти границы — тогда о чем вообще речь? Что определять сетью?

Что Вы пытаетесь сделать? Добавить неопределенность? Для этого уже есть нейро-нечеткие сети, они имеют строгое математическое описание и вполне успешно решают свою задачу. Решать задачи в ограничениях? Для этого разработан великолепный математический аппарат. Что? Вы не формализовали задачу, не дали четких определений и претендуете на новизну и жизнеспособность идеи.

Девушка, это задача целочисленного программирования. Для ее решения нейронные сети нафиг не нужны.

Вы упорно не хотите замечать очевидного. Если у Вас и так есть условия «больше 1» и «меньше 3» — Вам не нужна нейронная сеть для поиска решений. У меня складывается впечатление, что Вы элементарно не понимаете, что такое нейронная сеть и как она работает. Вы не сделаете НС с другим алгоритмом работы, НС — сама по себе в некотором смысле алгоритм. Можете предложить альтернативную архитектуру НС? Или неизвестный алгоритм ее обучения? Я весь внимание. Потому что пока я слышу только туманные высказывания, не имеющие никаких обоснований.

То, что Вы называете коридором, а конкретно, интервал допустимых значений, определяется двумя параметрами — его левой и правой границей. Если размерность пространства больше — соответственно, границ больше. Но их должно быть фиксированное число. Тогда задача сводится к определению этих границ по заданному вектору воздействия. Задача, в лучшем случае, для обычной нейронной сети, обученной на выборке примеров (объект, левая граница, правая граница). А если у Вас заранее известны эти границы — тогда о чем вообще речь? Что определять сетью?

Что Вы пытаетесь сделать? Добавить неопределенность? Для этого уже есть нейро-нечеткие сети, они имеют строгое математическое описание и вполне успешно решают свою задачу. Решать задачи в ограничениях? Для этого разработан великолепный математический аппарат. Что? Вы не формализовали задачу, не дали четких определений и претендуете на новизну и жизнеспособность идеи.

0

> Девушка, это задача целочисленного программирования. Для ее решения нейронные сети нафиг не нужны.

Каков пример, таков и ответ. Я снова повторяю, что все предложенные примеры очень простые эмпирические наблюдения. Естественно, для их решения нет смысла примерять НС, но они хотя бы примерно могут иллюстрировать ход моей мысли.

У меня складывается впечатление, что за деревьями вы не видите леса.

> Можете предложить альтернативную архитектуру НС? Или неизвестный алгоритм ее обучения?

Именно это я и пытаюсь делать. Вы хотите от меня уже готовой теории, но увы, на данном этапе рассуждений привести вам выкладку математических формул я не могу. И Москва не сразу строилась.

> То, что Вы называете коридором, а конкретно, интервал допустимых значений, определяется двумя параметрами — его левой и правой границей.

Нет, в данном случае весь указанный вами интервал — верные решения. В моем же предложении в указанном коридоре как правильные, так и неправильные значения. Но, по сравнению с областью, в которой принимает решение обычная НС, в данном случае область будет гораздо более компактна

> Вы не формализовали задачу, не дали четких определений и претендуете на новизну и жизнеспособность идеи.

Я не утверждаю, что Земля круглая, зачем вы так усиленно хотите сжечь за это на костре? Я выдвигаю идею. Возможно, она будет кому-то полезна и кто-то разработает то, чего вам так хочется увидеть. Возможно, это буду даже я. Вы хотите получить все и сразу. Рекомендую развивать терпеливость.

Каков пример, таков и ответ. Я снова повторяю, что все предложенные примеры очень простые эмпирические наблюдения. Естественно, для их решения нет смысла примерять НС, но они хотя бы примерно могут иллюстрировать ход моей мысли.

У меня складывается впечатление, что за деревьями вы не видите леса.

> Можете предложить альтернативную архитектуру НС? Или неизвестный алгоритм ее обучения?

Именно это я и пытаюсь делать. Вы хотите от меня уже готовой теории, но увы, на данном этапе рассуждений привести вам выкладку математических формул я не могу. И Москва не сразу строилась.

> То, что Вы называете коридором, а конкретно, интервал допустимых значений, определяется двумя параметрами — его левой и правой границей.

Нет, в данном случае весь указанный вами интервал — верные решения. В моем же предложении в указанном коридоре как правильные, так и неправильные значения. Но, по сравнению с областью, в которой принимает решение обычная НС, в данном случае область будет гораздо более компактна

> Вы не формализовали задачу, не дали четких определений и претендуете на новизну и жизнеспособность идеи.

Я не утверждаю, что Земля круглая, зачем вы так усиленно хотите сжечь за это на костре? Я выдвигаю идею. Возможно, она будет кому-то полезна и кто-то разработает то, чего вам так хочется увидеть. Возможно, это буду даже я. Вы хотите получить все и сразу. Рекомендую развивать терпеливость.

0

Ваши рассуждения — откровенный бред. В нем нет ни грамма математики, логики или хотя бы элементарного здравого смысла.

Вы думаете, что выдвинули идею?

> Я снова повторяю, что все предложенные примеры очень простые эмпирические наблюдения

Я не услышал ни одного примера задачи, где Ваша «идея» поможет ее решить.

>… И Москва не сразу строилась

Вы даже не удосужились дать постановку задачи.

> Рекомендую развивать терпеливость

Вам я рекомендую развивать логику и критичное отношение к себе. Если Вы публикуете что-то, то должны четко представлять себе то, что хотите сказать. У Вас должна быть хотя бы постановка задачи и хоть какое-то обоснование. Ничего этого в статье нет. И, как следует из обсуждения, в голове у Вас тоже ничего кроме бардака нет.

Не хотел «трясти медалями», но нейронные сети — это одна из вещей, которыми вплотную я занимаюсь. Прикладная математика — моя профессия. И могу Вам совершенно точно сказать, то, что Вы говорите в статье и под ней — полная чушь с математической точки зрения. Если Вы этого не понимаете — Вам не место в технической профессии.

Вы думаете, что выдвинули идею?

> Я снова повторяю, что все предложенные примеры очень простые эмпирические наблюдения

Я не услышал ни одного примера задачи, где Ваша «идея» поможет ее решить.

>… И Москва не сразу строилась

Вы даже не удосужились дать постановку задачи.

> Рекомендую развивать терпеливость

Вам я рекомендую развивать логику и критичное отношение к себе. Если Вы публикуете что-то, то должны четко представлять себе то, что хотите сказать. У Вас должна быть хотя бы постановка задачи и хоть какое-то обоснование. Ничего этого в статье нет. И, как следует из обсуждения, в голове у Вас тоже ничего кроме бардака нет.

Не хотел «трясти медалями», но нейронные сети — это одна из вещей, которыми вплотную я занимаюсь. Прикладная математика — моя профессия. И могу Вам совершенно точно сказать, то, что Вы говорите в статье и под ней — полная чушь с математической точки зрения. Если Вы этого не понимаете — Вам не место в технической профессии.

+1

Не подскажете, почему «экспансия» нейросетей остановилась? всегда интересовал этот вопрос, но ответ толком не нашел (да и, откровенно говоря, особо и не искал).

+2

Я не эксперт, но погуглив и включив здравый смысл, пришел к выводу, что по той же причине остановилась экспансия газовых фонарей — электрические удобней и практичнее.

Ну а в гугле нашел такое:

и такое:

Вобщем стали заниматься более обещающими интсрументами.

Ну а в гугле нашел такое:

What is a disadvantage of an Artificial Neural Network?

local minima

generalization/overfitting

hard to interpret

и такое:

Neural nets perform very well on difficult, non-linear domains, where it becomes more and more difficult to use Decision trees, or Rule induction systems, which cut the space of examples parallel to attribute axes. They also perform slightly better on noisy domains.

One of disadvantages in using Neural nets for data mining, is a slow learning process, compared top for example Decision trees. This difference can very easily be several orders of magnitude (100-10000).

Another disadvantage is that neural networks do not give explicit knowledge

representation in the form of rules, or some other easily interpretable form. The model is implicit, hidden in the network structure and optimized weights, between the nodes.

Вобщем стали заниматься более обещающими интсрументами.

+2

Спасибо за ответ.

+1

Как это все уже изучено? Читая новости в этой области за последние несколько лет видно, что математики теперь следят за открытиями нейрофизиолгов и других групп ученых, занимающихся изучением поведения, мышления, сознания живых существ и пытаются строить новые матмодели.

Пару ссылок по теме:

habrahabr.ru/blogs/artificial_intelligence/101926/

theoryandpractice.ru/videos/80-konstantin-anokhin-kody-mozga

Пару ссылок по теме:

habrahabr.ru/blogs/artificial_intelligence/101926/

theoryandpractice.ru/videos/80-konstantin-anokhin-kody-mozga

0

А она не остановилась. Исследования ведутся. Сами сети успешно применяются в задачах управления, оптимизации, классификации, распознавания образов и других областях. Если вопрос, почему о них не так часто говорят как раньше, ответ прост — они сложны. Что можно было сказать о них на бытовом уровне уже сказали. Остальное — вотчина ученых и широкой общественности не интересно.

0

Я не утверждаю, что они совсем забыты. Безусловно, работы ведуться. Но за 5-6 лет я как-то не помню, что бы нейросети были успешно применены при решении новых(!) задач. В быту, как вы выразились, они все так же решают крайне узкий круг задач. Именно это я спрашивал выше.)

0

А какие новые задачи Вы припоминаете за последние 5-6 лет?

0

Новых задач, увы, я назвать не смогу, сказал для красного словца. Но, например, насколько мне известно, в распознавании образов сейчас приоритеты отнюдь не у нейросетей. Упомянутые выше деревья принятия решений пользуются ощутимо большей популярностью.

0

Распознавание образов — это очень широкий класс задач, там нет однозначно приоритетных методов и нейронные сети также применяются. Деревья решений предпочтительны ввиду того, что нейросети не универсальны, каждой задаче — своя нейронная сеть, построить которую задача нетривиальная. Это не значит, что они там вообще не применяются. В сущности, основная проблема в сложности адаптации аппарата НС к конкретной прикладной задаче.

0

А я и не говорю, что их не применяют. Я утверждаю, что они не столь популярны, как деревья или тот же SVM. Как раз по обозначенным вами причинам.)

0

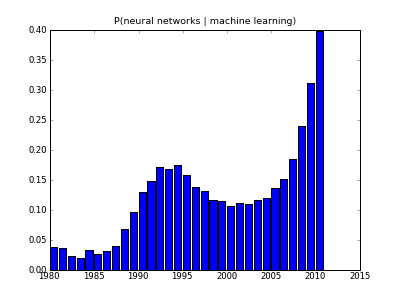

Некоторые уже ответили на этот вопрос. Но позволю себе добавить уточнение. Да экспансия нейросетей существенно замедлилась в 2000х, но есть более свежие данные о том что нейросети возвращаются. Вот данные о количестве публикаций на тему нейросетей в 90-е:

А вот более свежая статистика:

Информация взята из поста Ярослава Булатова: yaroslavvb.blogspot.com/2011/04/neural-networks-making-come-back.html

Кроме того, те кто записался на курсы Andrew Ng по Machine learning, на одной из последних лекций должны были слышать объяснение этого возродившегося интереса тем фактом, что нынешние вычислительные ресурсы (не в последнюю очередь CUDA) позволили применять нейросети на практике.

Еще одна причина спада интереса, это отсутствие эффективных алгоритмов для обучения «глубоких» нейронных сетей (3 и больше слоев). Алгоритм обратного распространения сам по себе не годится для этой задачи. Это мнение ряда авторитетных исследователей в этой области (Geofrey Hinton, Yann LeCun, Yoshua Bengio)

А вот более свежая статистика:

Информация взята из поста Ярослава Булатова: yaroslavvb.blogspot.com/2011/04/neural-networks-making-come-back.html

Кроме того, те кто записался на курсы Andrew Ng по Machine learning, на одной из последних лекций должны были слышать объяснение этого возродившегося интереса тем фактом, что нынешние вычислительные ресурсы (не в последнюю очередь CUDA) позволили применять нейросети на практике.

Еще одна причина спада интереса, это отсутствие эффективных алгоритмов для обучения «глубоких» нейронных сетей (3 и больше слоев). Алгоритм обратного распространения сам по себе не годится для этой задачи. Это мнение ряда авторитетных исследователей в этой области (Geofrey Hinton, Yann LeCun, Yoshua Bengio)

0

Ах, да удачи.

+2

Идея хорошая. Фактически, то, что вы называете «антинейроном», можно получить, тренируя нейрон на области (a+delta1,a+delta2) около исходного факта a, где delta1 задаёт радиус истинности факта, а delta2 — радиус… ну, допустим, важности, то есть пределы, в которых мы должны отличать этот факт от всяких других. Сгенерировав случайным образом достаточно много точек в указанной области, можно достичь нужного результата. Собственно, вопрос размеров delta1, delta2 и «достаточно много» как раз и стоит исследовать =)

0

Спасибо за комментарий! Он дал новую почву для размышлений.)

0

А в чем смысл, если известно a? Если фиксировать delta1 и delta2 при обучении на разных примерах — так они вообще не нужны. А если не фиксировать — то получится обычная нейронная сеть с тремя входами — a, delta1 и delta2. Но даже в этом, исходя из «Сгенерировав случайным образом достаточно много точек в указанной области» не имеет смысла. Если delta1 и delta2 не зависят от a — задача изначально бессмысленна. А если есть функциональная зависимость — тогда сеть работает как аппроксимация этой зависимости, выдавая delta1 и delta2 для каждого a на входе. То есть опять, обычная нейронная сеть.

0

Минус за пост, плюс в карму за попытку. Статья и правда ни о чем, займитесь поплотнее теорией, мне кажется, вы не вполне прониклись самой сутью обучения нейронных сетей. Сети обучают на правильной выборке, чтобы она научилась по аналогии определять правильные варианты, не входящие в эту выборку. Ваш пример с линией тоже не вполне корректен — мы можем научить сеть определять, прямая на входе линия или нет, а предложить сгенерировать ее самой — неудачная задача для НС.

Сам нейронные сети изучал уже давненько, в магистратуре, но это из того, что помню.

Сам нейронные сети изучал уже давненько, в магистратуре, но это из того, что помню.

+3

Просто мне не дает покоя тот факт, что, по сути, основная задача НС — аппроксимация решений. Все вышесказанное лишь попытка научить НС генерировать решения самостоятельно.

И еще вопрос. Вы вот сказали, что это неудачная задача для НС, можно поподробней?

И еще вопрос. Вы вот сказали, что это неудачная задача для НС, можно поподробней?

0

Да вы же сами ответили на свой вопрос) Нейронная сеть в основном используется для кластеризации значений, аппроксимаций, либо принятия решений. В любом случае, типичная задача для нейронной сети в том, чтобы выбрать правильное решение из множества доступных, а не сгенерировать его самой. Ну если вам так хочется заставить систему придумывать решения, прилепите к ней генератор случайных решений) В контекстве вашей задачки с линией — берем обученную сеть, умеющую с заданной точностью решать, прямая линия или нет и прикрепляем к ней генератор кривых. Пусть генератор выплевывает решения, а сеть выбирает из них прямые)

0

Конечно, как говорится, старого пса новым трюкам не обучишь, но мне представляется, что ежели несколько модифицировать подход, то можно решать и задачи, которые я приводила в пример. Скажем так, взять принцип нейронов и сделать с ними что-то другое, заточить под другие задачи. Собственно, об этом я и размышляю в статье.

0

сори, но надо читать хоть немного теории, а потом писать!!!

читайте Back Propagation системы обучения.

Как говорил мой проф, на спец курсе но НС:

— Есть мальчик Вася, которого вы хотите чему-то обучить. Если дал правильный ответ, выдайте ему конфету. Если ошибся, выдайте подзатыльник.

Вы пускаете самое главное. Процесс сходимости обучения может быть отображен, не линией, а неким пространством.

Как уже правильно заметили, выше.

Как только у вас будет нейронов больше одного, и сеть станет многослойной, все ваши выкладки рухнут.

читайте Back Propagation системы обучения.

Как говорил мой проф, на спец курсе но НС:

— Есть мальчик Вася, которого вы хотите чему-то обучить. Если дал правильный ответ, выдайте ему конфету. Если ошибся, выдайте подзатыльник.

Вы пускаете самое главное. Процесс сходимости обучения может быть отображен, не линией, а неким пространством.

Как уже правильно заметили, выше.

Как только у вас будет нейронов больше одного, и сеть станет многослойной, все ваши выкладки рухнут.

+2

Зачем же сразу настолько негодовать? С теорией я, как вы выразились, хоть немного ознакомилась и у меня появились подобные размышления.

Упоминание обратного распространения ошибки не совсем понятно. Ибо, грубо говоря, НС корректирует вес при неправильном решении. Это все хорошо, но здесь ключевым фактором является именно отклонение от эталона. Я тут говорю несколько о другом.

Про сходимость обучения. Я и не утверждаю, что это будет линия. Просто на простом примере легче все представить. Объективно говоря, и изображенное мною пространство вариантов далеко не двумерное…

Упоминание обратного распространения ошибки не совсем понятно. Ибо, грубо говоря, НС корректирует вес при неправильном решении. Это все хорошо, но здесь ключевым фактором является именно отклонение от эталона. Я тут говорю несколько о другом.

Про сходимость обучения. Я и не утверждаю, что это будет линия. Просто на простом примере легче все представить. Объективно говоря, и изображенное мною пространство вариантов далеко не двумерное…

-2

У вас в голове все смешано в одну кучу — сходимость обучения, распространение ошибки, отклонение от эталона… Нельзя с такими путанными знаниями что-либо рассказывать другим. Вы только навредите им.

0

ну давайте разбирать по цитатам

что вы описали?

При такой постановке, я не вижу смысла городить нейросеть.

Что собственно должна делать нейросеть?

Должна вывести ту «функцию» которую мы не видим (не можем формализировать, описать).

То есть при подаче некоторого набора данных должен получаться набор определенных результатов. а что предлагаете вы?

Если эталонная выборка не дает нужного эффекта, попробуем прямо противоположное — будем обучать НС на ошибках! Таким образом, на вход гипотетической сети будем подавать неверное значение X, а на выход — соответствующее ему значение Y. И что же в таком случае получится? А получится то, что мы самым грубым образом ограничим пространство вариантов.

позвольте спросить а откуда известно что вот этот «неправильный» набор Х` приведет к этому неправильному набору Y`? Где зависимость которую вы хотите построить? к набору Y` может привести наборы Х`1, Х`2, Х`3,...., Х`n

Вы меняете местами множества входных данных, причем идете вместо уменьшения к увеличению пространства возможных вариантов. Ваша гипотеза не может вести к сходимости обучения. Ибо мощность множества «неправильных» примеров, больше мощности множества «правильных» (топология).

- правила (они же — верные данные, они же — факты);

- ограничения (они же — неверные данные);

- исключения (ведь из каждого правила есть исключения, да?).

что вы описали?

При такой постановке, я не вижу смысла городить нейросеть.

Что собственно должна делать нейросеть?

Должна вывести ту «функцию» которую мы не видим (не можем формализировать, описать).

То есть при подаче некоторого набора данных должен получаться набор определенных результатов. а что предлагаете вы?

Если эталонная выборка не дает нужного эффекта, попробуем прямо противоположное — будем обучать НС на ошибках! Таким образом, на вход гипотетической сети будем подавать неверное значение X, а на выход — соответствующее ему значение Y. И что же в таком случае получится? А получится то, что мы самым грубым образом ограничим пространство вариантов.

позвольте спросить а откуда известно что вот этот «неправильный» набор Х` приведет к этому неправильному набору Y`? Где зависимость которую вы хотите построить? к набору Y` может привести наборы Х`1, Х`2, Х`3,...., Х`n

Вы меняете местами множества входных данных, причем идете вместо уменьшения к увеличению пространства возможных вариантов. Ваша гипотеза не может вести к сходимости обучения. Ибо мощность множества «неправильных» примеров, больше мощности множества «правильных» (топология).

+2

Я бы Вам рекомендовал ознакомиться с лекциями Стэнфордского университета:

ИИ — www.ai-class.com/home/

Машинное обучение — www.ml-class.org/course/class/index

Получите отличную базу и подтянете необходимую математику (благо, рассказывают ОЧЕНЬ доступно, особенно машинное обучение). Согласен с оратором выше — начинание хорошее, но пост сырой.

ИИ — www.ai-class.com/home/

Машинное обучение — www.ml-class.org/course/class/index

Получите отличную базу и подтянете необходимую математику (благо, рассказывают ОЧЕНЬ доступно, особенно машинное обучение). Согласен с оратором выше — начинание хорошее, но пост сырой.

+3

Очень надеюсь, что автор знает что такое backpropagation.

0

Смею успокоить, автор знает. К слову, несколько выше это уже упоминалось.

0

Ок, не заметил.

Мне кажется, что нейронная сеть по определению обучается и на отрицательных данных тоже, по крайней мере я в своей работе употреблял ее для классификации, где положительный пример 1, отрицательный 0, и т.п.

Мне кажется, что нейронная сеть по определению обучается и на отрицательных данных тоже, по крайней мере я в своей работе употреблял ее для классификации, где положительный пример 1, отрицательный 0, и т.п.

0

Нет таких понятий — «положительные» и «отрицательные» данные. Данные — это данные. Результат — это результат. Результатом может быть 1 или 0, но никакой дополнительной окраски (отрицание-неотрицание) он не несет. Это исключительно вопрос интерпретации.

0

Согласен!

0

Хмм, интересно, спасибо. Однако, в работе это несколько иное, что-то специфичное. А мы, вроде, говорим про общий случай.

0

ООО! а не знаете есть ли доступная реализация алгоритма в коде?

0

уже нашел — www.eagle.tamut.edu/faculty/igor/Downloads.htm

0

Поздравляю ;)

Реализация не настолько сложная насколько кажется.

Теория стройная.

MLMVN это обобщение многозначной логики.

Реализация не настолько сложная насколько кажется.

Теория стройная.

MLMVN это обобщение многозначной логики.

0

хм, а вы случаем к самому Айзенбергу не имеет отношение?

0

ну судя по сайту img-service.com, имею ;)

Многие вещи реализовывал в коде, для потверждения и развития теоретических выкладок.

Многие вещи реализовывал в коде, для потверждения и развития теоретических выкладок.

0

Вообще, в идеи есть здравое зерно. Успешно нами применялась для обучения нейронных сетей в распознавании букв при сегментации, которая могла быть выполнена неточно. Так вот на вход подавались «не-буквы», которые представляли из себя неверно сегментированные изображения. На выходе требовалось определить, что это «не-буква». Также такое обучение очень важно в системах, где лучше сказать, что мы не знаем что это за символ, чем сказать что это символ А с хоть и маленькой вероятностью. Как правильно замечено выше, определяется возможный разброс входных параметров, которые фактически могут быть поданы на вход нейронной сети. Из них определяются невалидные примеры, которым сеть обучается отдельно.

0

Ваша нейросеть решала другую задачу — найти такую функцию, которая бы определяла, что есть «буква», а что — «не-буква». Пара («не-буква», true) является самым обычным учителем, поскольку нейросети неважно, что стоит за входом X — буква там или «не-буква». Это вопрос интерпретации и условности.

0

Собственно это сужает пространство верных решений. Таким образом, сеть все-таки учится на ошибках. Как я понял — это основная идея этой статьи.

0

Это не «сужает пространство верных решений», — пара («не-буква», true), равно как и пара («буква», false) — это и есть верное решение для вашего случая.

Когда говорят, что «нейросеть учится на ошибках», подразумевают механизм, при котором нам достоверно известно, что выход Y является неверным, и исходя из этого знания мы можем перестроить веса, скорректировав их на величину g(Y' — Y), где Y' — верное решение для данного X; Y — полученное неверное решение, а g — некая функция подстройки весов. Функцией может быть как распространение ошибки назад, так и иной способ подстройки. Например, усиление связей к нейронам, которые выдали меньше, чем ожидалось, и ослабление связей к нейронам, которые выдали больше.

И это никак не соответствует том, что говорит автор, потому что ее слова антинаучны. Ей стоит изучить первоисточники и затем лучше формализовать свою идею, возможно, применив иные термины.

Когда говорят, что «нейросеть учится на ошибках», подразумевают механизм, при котором нам достоверно известно, что выход Y является неверным, и исходя из этого знания мы можем перестроить веса, скорректировав их на величину g(Y' — Y), где Y' — верное решение для данного X; Y — полученное неверное решение, а g — некая функция подстройки весов. Функцией может быть как распространение ошибки назад, так и иной способ подстройки. Например, усиление связей к нейронам, которые выдали меньше, чем ожидалось, и ослабление связей к нейронам, которые выдали больше.

И это никак не соответствует том, что говорит автор, потому что ее слова антинаучны. Ей стоит изучить первоисточники и затем лучше формализовать свою идею, возможно, применив иные термины.

0

Задача стоит не в определении буква это или не-буква, а в распознавании букв. И показывая также не-буквы, можно сформировать такую гиперплоскость, которая будет более эффективно определять буквы. Вообще это вопрос терминологии. Вы так полагаете обучение на ошибках, кто-то по-другому. Подавая на вход некорректный образец с точки зрения предметной области, мы как раз и учим сеть на «ошибочных» примерах. Степень свободы гиперплоскости уменьшается за счёт приобретения дополнительного знания о функции в целом. Кстати, часто идеи высказанные людьми, которые не являются профессионалами в этой области могут оказаться очень эффективными. Все-таки теория заимствована у природа. Это моё мнение.

0

Именно, это вопрос терминологии, которая устоялась и общепринята. Это не я так полагаю, это полагают первоисточники.

Ну как вам объяснить, что «некорректным» образец является лично для вас, а не для нейросети? Для нее образец («не-буква», true) корректен, поскольку она не работает с интерпретациями, она работает с чистыми данными. Если бы я подставил вместо знака препинания, который тоже «не-буква», какой-нибудь иероглив, — что изменилось бы? Ровным счетом ничего. Нейросеть учится классифицировать входной образ, и ей неважно, что вы его воспринимаете негативно по отношению к задаче.

И хотя в данном случае это все — мелочи, и они никак не повлияют на верность работы вашей ИНС, я призываю не путать технические понятия и интерпретацию.

Ну как вам объяснить, что «некорректным» образец является лично для вас, а не для нейросети? Для нее образец («не-буква», true) корректен, поскольку она не работает с интерпретациями, она работает с чистыми данными. Если бы я подставил вместо знака препинания, который тоже «не-буква», какой-нибудь иероглив, — что изменилось бы? Ровным счетом ничего. Нейросеть учится классифицировать входной образ, и ей неважно, что вы его воспринимаете негативно по отношению к задаче.

И хотя в данном случае это все — мелочи, и они никак не повлияют на верность работы вашей ИНС, я призываю не путать технические понятия и интерпретацию.

0

Если все сводить к концепции данных, которые не несут ровно никакой информации без семантического определения, не возможно решать практические задачи. Хотелось бы ссылку первоисточника увидеть. Вот в Хайкине такого определения не встречал.

0

Первоисточники ищите сами. На Рутрекере есть, по крайней мере, 2 Гб документов по ИИ.