Comments 32

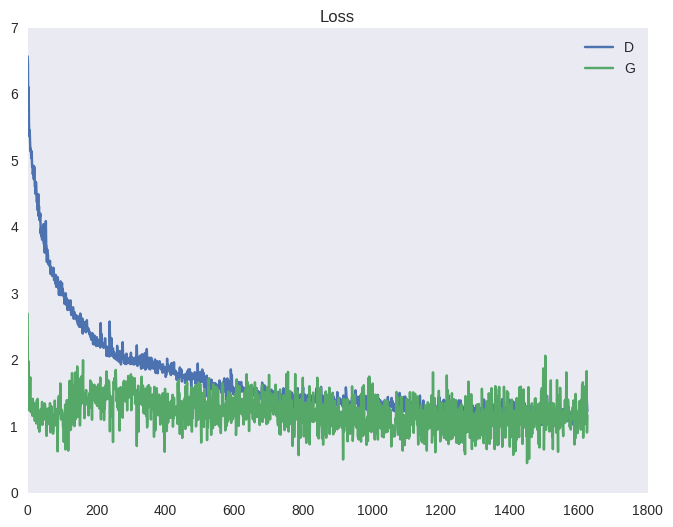

У меня получалось, что лосс дискриминатора всегда лучше лосса генератора.

100к картинок с японскими порномультиками, распознать там то, что называется лицом, и попробовать обучить). Результат вообще никакой, вероятно из-за того что «физика» лица в онеме совсем не реальная.Вроде бы серьёзная статья, и ваша неприязнь не вписывается.

Хотите узнать, к чему эта прохладная тут? Хотелось бы. Тем более лето.

Прежде чем заявлять о некой нейроной сети. Дайте сначало определение- нейрон. А потом хорошенько подумайте о том что вы тут написали. И может быть, когда дойдёт, вы не будите писать глупости и объясните "своим" западным айтишникам, что маркетология хороша в меру.

Я не против совершенства программирования, я против громких названий, которые не соответствуют действительности.

Когда людям нечего сказать по существу, они начинают философствовать на тему "что есть искуственный интеллект", "является ли искуственная нейронная сеть моделью реальной нейронной сети" и прочие темы, по поводу которых можно лить нескончаемые потоки псевдоумных изречений не несущих никакого смысла… в то время как практики не заморачиваются такой фигней и делают крутые штуки с использованием ИНС, независимо от того, являются они ИИ или нет ;-)

п.с. Я как то придумал перевод «порождающие конкурующие сети».

Интереснейшая работа, благодарность автору!

может вы знаете какие-то примеры применения GAN-ов в продакшне? субъективно то да, картинки вроде клевые, но если хорошенько присмотреться к тем же лицам, то вечно что-то не так. мне давно интересно, смог ли кто-нибудь вкрутить это все в какой-то продукт.

да пока не получается натренировать ганы делать лица без артефактов, но зато можно сделать сеть, которая убирает артефакты -)

теоретически можно соединить в одну модель ган, сеть убирающую артефакты и суперрезолюшн, тогда, в теории, все было бы ок, но так не пробовал пока никто вроде (имхо если натренировать каждую в отдельности, а потом соединить и дотюнить, то вполне могло бы заработать)

и обучать их перекрестно?

Есть несколько генераторов и несколько дискриминаторов служащих для одной и той же цели.

просто случайным образом выбираем кросскомбинации.

CycleGAN генераторы служат разным целям.

Дискриминаторы как и генераторы могут быть разными по сложности.

А в чем существенная разница с тем, если бы мы просто налепили dropout'ов в один генератор и один диксриминатор? (Dropout вроде как порождает ансамбль сетей).

Несколько дискриминаторов различной сложности были рассмотрены в статье Generative Multi-Adversarial Networks

We introduced multiple discriminators into the GAN framework and explored discriminator roles

ranging from a formidable adversary to a forgiving teacher [...] Introducing multiple

generators is conceptually an obvious next step, however, we expect difficulties to arise from more

complex game dynamics. For this reason, game theory and game design will likely be important.

статья очень суровая математически. суть — один дискриминатор (насколько я помню) и много генераторов, каждый обслуживает свой кусок данных, которые надо сгенерировать.

в ДНК были закодированы имена создателей, их электропочты

Это слово сделало мой день. Телеграфируйте по электропочте, прямо русским духом пахнет.

Спасибо за статью, подбор материала и ссылки на ресурсы.

Нейросетевая игра в имитацию